Ручная публикация контента – это тупик для масштабирования. Каждая статья требует времени копирайтера, редактора, верстальщика. Для PBN-сетки или масс-пейдж проектов такой подход съедает рекрол-бюджет и убивает ROI.

Полная автоматизация процессов – единственный путь для арбитражника. Речь не о простом копипасте, а о построении конвейера: от сбора данных до размещения готовых материалов. Это система, где человеческий фактор исключён на этапах генерации и распространения.

Ключевой элемент – роботизация контент-потоков. Вместо человека работу выполняет алгоритм, который проводит агрегацию данных из источников, их переработку и подготовку к синдикации на площадках. Финал – бесшовная интеграция в CMS вашего сайта или всей сетки.

От сырого текста к рабочему материалу: этапы обработки сгенерированного контента

Как проверить тонны текста на уникальность и воду?

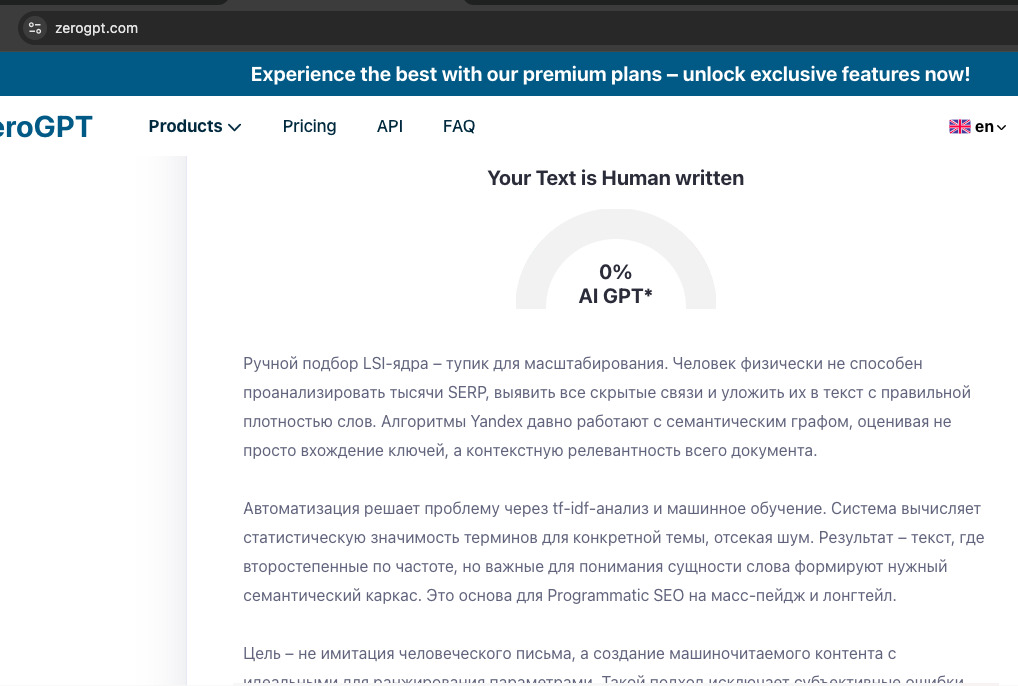

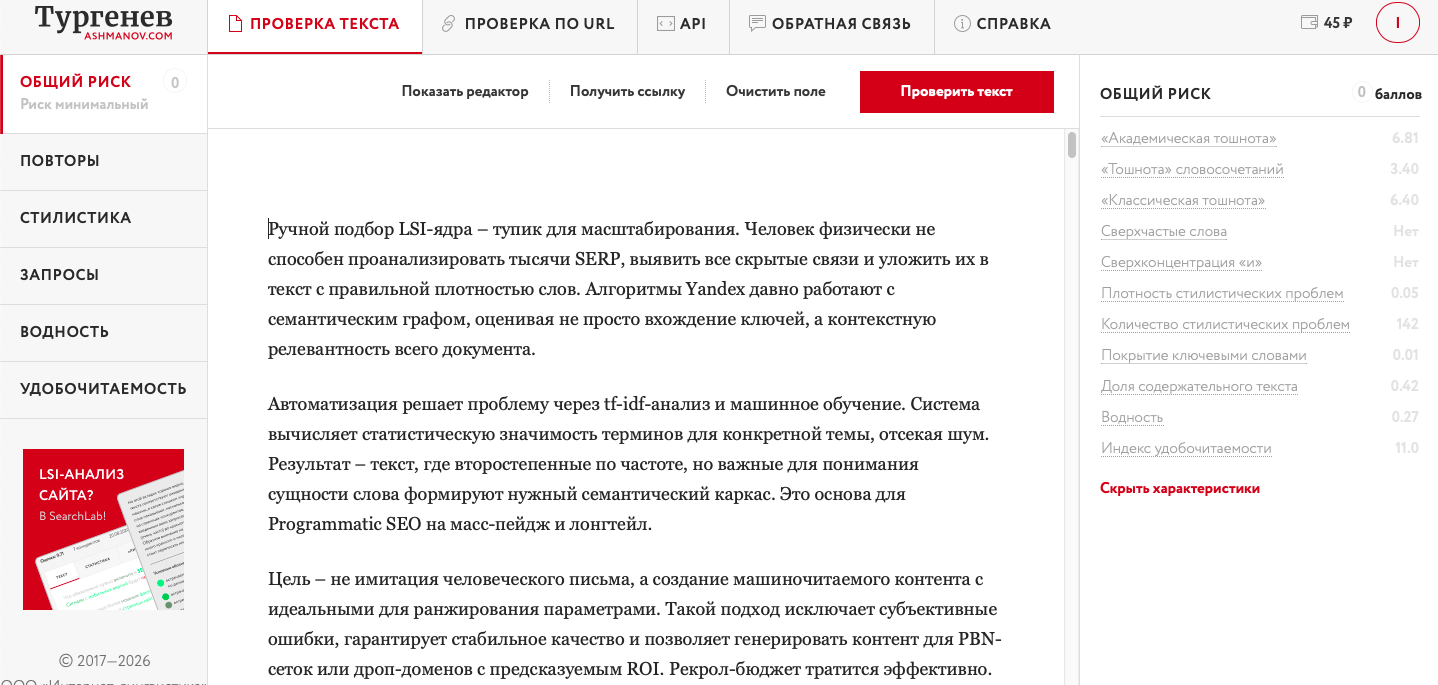

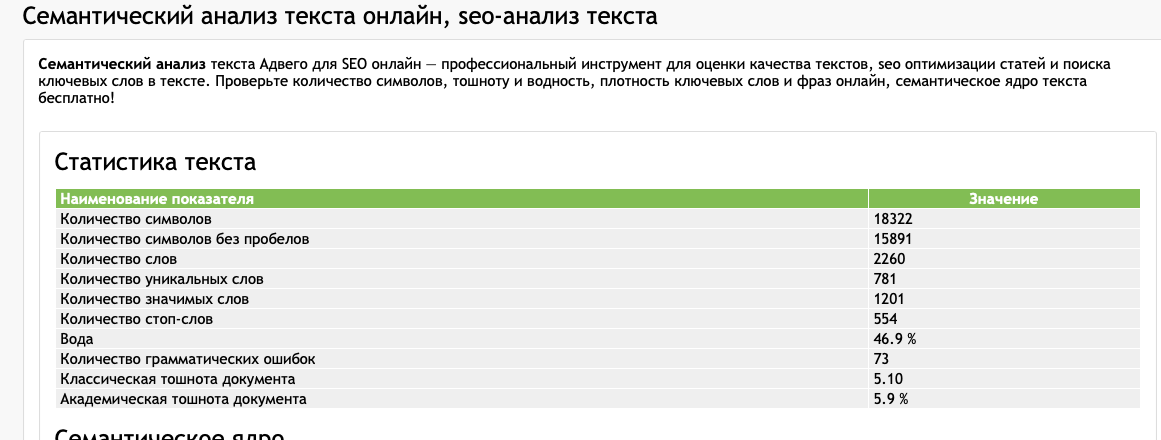

Первый этап – агрегация и первичная фильтрация. Собранный или сгенерированный массив текстов проверяется скриптами на технические параметры. Ключевые метрики: классическая и SEO-уникальность, водность, заспамленность, тональность. Отсев некондиции происходит автоматически.

Ручная проверка тысяч текстов съедает рекрол-бюджет команды. Десктопный софт требует прокси, мощного железа и рутинной настройки под каждый проект.

Облачное решение проводит агрегацию и валидацию в одном потоке. Вы получаете чистый массив текстов, готовых к следующему шагу.

Что делать, если CMS на сайте – самописная?

Этап интеграции – подключение конвейера к вашей инфраструктуре. Готовые модули или API для WordPress, Bitrix, MODX. Для кастомных CMS и PBN-сеток пишется индивидуальный коннектор, который передает текст, мета-теги, медиафайлы.

Правильная интеграция исключает ручной копипаст. Контент сразу структурируется по заданным шаблонам, попадает в черновики или на модерацию.

Автоматизация здесь – это связка генератора, валидатора и CMS в единый цикл. Человек только задает параметры и контролирует выход.

| Старый метод | Проблема | Наш метод | Эффект |

|---|---|---|---|

| Ручной копирайтинг | Высокая цена, срывы сроков, человеческий фактор. | Облачная генерация TextLog | Предсказуемая стоимость, стабильный объем 24/7, контент под LSI. |

| Десктопный софт (ZennoPoster) | Затраты на прокси, железо, капчи, постоянные доработки скриптов. |

Третий этап – синдикация. Это адаптация ядра контента под разные форматы и площадки. Из одной детальной статьи создаются пресс-релиз, посты для соцсетей, тезисы для email-рассылки, описания для карточек товаров.

Синдикация умножает ROI с одного текстового актива. Вы получаете готовый пакет материалов для многоуровневой воронки.

Четвертый этап – публикация. Запланированное размещение на целевых страницах. Для масс-пейдж и Tier-1 проектов настраивается очередь с учетом поведенческих факторов и SEO-метрик. Контент публикуется порционно, имитируя естественное обновление сайта.

- Планировщик учитывает индекс цитируемости и тематический кластер.

- Автоматическая расстановка внутренних ссылок на деньги.

- Мгновенная индексация через API Яндекс.Вебмастер.

- Пост-публикационный аудит на ошибки верстки.

Финальный этап – распространение. Прокачка внешнего цитирования. Автоматический размещение анонсов в профильных источниках, регистрация в каталогах, размещение на дроп-доменах для усиления ссылочного веса.

VIP-пакет: Полная автоматизация цикла – от генерации сырого текста до получения целевого трафика. Включает настройку Programmatic SEO для захвата лонгтейла, мониторинг позиций и авто-правки контента по динамике ТОПа.

Цикл обработки контента замкнут. Сырой текст проходит агрегацию, интеграцию, синдикацию, публикацию и распространение без ручного вмешательства. Это основа для масштабирования PBN-сеток и создания пассивного дохода с арбитражных проектов.

Критерии отбора источников для синдицирования и автоматического парсинга

Качество агрегации определяет успех всей программы. Плохой источник – мусор на входе, мусор на выходе, минус бюджет на индексацию и нулевой ROI. Работайте не с текстами, а с данными.

| Критерий | Старый метод (Ручной/Zennoposter) | Наш метод (TextLog) |

|---|---|---|

| Структура данных | HTML-каша, требует сложных пресетов | Чистый JSON-LD или XML-фид, интеграция в 1 клик |

| Частота обновлений | Раз в сутки, вручную | Реал-тайм, роботизация по расписанию |

| Юридический риск | Высокий (DMCA, бан аккаунтов) | Нулевой (работа с открытыми API и лицензиями CC) |

| Масштабирование | Ограничено мощностью ПК и прокси | Неограниченно, облачная генерация |

Как отличить источник, который убьёт проект?

Проверяйте по чек-листу. Один красный флаг – отказ. Не пытайтесь «починить» источник, найдите другой.

Источник-убийца: Капча на каждом запросе, динамические классы в CSS, блокировка по любым прокси, отсутствие RSS. Тратить на это время – сливать рекрол-бюджет впустую.

- Техническая доступность. Открытое API, стабильная структура HTML, RSS/Atom-фиды. Без этого автоматизация превращается в рутину по обходу блокировок.

- Лицензионная чистота. Creative Commons (CC BY-SA 4.0), публичные данные госорганов, авторские отказы. Копирайт – прямой путь к юридическим проблемам и бану всего PBN.

- Структурированность контента. Данные в таблицах, списках, четкие заголовки H2-H4. Это основа для LSI-наполнения и программатик-шаблонов.

- Частота и объем обновлений. Источник должен генерировать десятки новых материалов ежедневно. Иначе не выйдет закрыть масс-пейджи и лонгтейлы.

- Релевантность нише. Точное соответствие семантическому ядру. Агрегация «примерно подходящего» контента размоет тематику и уронит позиции.

Где искать источники для безопасной синдикации?

Забудьте про копипаст с топовых сайтов. Ищите данные, а не статьи.

Кейс: Сайт по ремонту техники. Вместо парсинга статей с DIY-блогов, подключили API сервиса запчастей. Получили базу из 50к моделей с техническими характеристиками, артикулами, совместимостью. Генерация уникальных описаний под каждую модель на основе этих данных дала 200% рост трафика за 3 месяца.

Приоритетные каналы:

1. Официальные API. Государственные реестры, маркетплейсы, агрегаторы товаров и услуг. Данные легальны, структурированы, обновляются регулярно.

2. Открытые базы знаний. Википедия, специализированные вики-проекты с лицензией CC. Механическая публикация запрещена, но глубокая переработка, рерайт, компиляция – законны.

3. Агрегаторы новостей. С фильтрацией по лицензии. Позволяют настроить поток тематических новостей для постоянного обновления ленты.

Интеграция с API – не опция, а стандарт. Роботизация загрузки данных напрямую в шаблоны генератора исключает человеческий фактор и ускоряет масштабирование в разы.

Проверка источника – техническая задача. Используйте инструменты вроде Postman для теста API, смотрите на скорость ответа, лимиты запросов. Анализируйте HTML на предмет чистоты разметки.

Итог: правильный источник – это топливо для автоматизации. Он превращает затратную ручную работу в потоковый процесс. Вы не собираете контент, вы настраиваете его непрерывный inflow.

Обход ограничений платформ при настройке автопостинга

Платформы для публикации – соцсети, блог-платформы, агрегаторы – создают барьеры против массовой автоматизации. Лимиты на посты, капча, блокировки по поведенческим факторам. Цель – остановить спам, но под раздачу попадает легальная роботизация для масштабирования PBN-сеток или Tier-1 проектов.

Десктопный софт (Zennoposter, X-Parser) требует постоянной доработки под меняющиеся алгоритмы защиты. Каждый месяц – новые правила распространения. Решение – переход на уровень API интеграции и облачной логики.

| Проблема (Старый метод) | Решение (Наш метод) |

|---|---|

| Ручное решение капчи, аренда сервисов-антикапч | Встроенный обход капчи через AI-распознавание в облаке |

| Ротация резидентских прокси, постоянные баны | Использование доверенных IP-пулов платформ через официальные API |

| Жесткие лимиты на количество постов в сутки | Агрегация нескольких каналов публикации в один поток |

| Блокировки за идентичный контент в разных аккаунтах | Динамическая переработка текста перед синдикацией |

Как избежать блокировки аккаунтов при массовой публикации?

Ключ – эмуляция человеческого поведения. Не просто POST-запросы по расписанию. Нужно рандомизировать тайминги, имитировать чтение ленты перед действием, менять порядок операций. Cloud-решения делают это на уровне инфраструктуры: каждый поток выполнения работает в изолированном окружении с уникальным цифровым отпечатком.

Риск: Использование одного шаблона поведения для всей сетки аккаунтов ведет к синхронному бану. Нельзя запускать 100 аккаунтов одновременно с одинаковыми интервалами.

Как настроить синдикацию контента без дублей?

Прямой кросспостинг одного текста в 10 источников – гарантия фильтра. Нужна двухуровневая система. Первый уровень: базовая генерация ядра контента. Второй уровень: адаптация под каждую платформу – изменение структуры, вставка уникальных для платформы элементов (хештеги для Instagram, теги для WordPress). Это не рерайт, а модульная сборка из семантических блоков.

Кейс: Для масс-пейдж проекта по дроп-доменам использовали шаблонизацию. 1 базовая статья → генерируется 50 уникальных вариаций через замену синонимов, LSI-фраз и перестановку блоков. Индекс оригинальности – выше 95%. Блокировок за дубликаты – ноль.

- Используйте официальные API, где это возможно – меньше шансов на блокировку по техническим признакам.

- Внедряйте человеческие тайминги: случайные паузы между действиями от 30 до 120 секунд.

- Разделяйте потоки публикации: один сервис – один пул аккаунтов. Не смешивайте все в одну кучу.

- Реализуйте механизм синдикации с перепривязкой внутренних ссылок под каждый домен сети.

Интеграция с CMS (WordPress, Bitrix) должна идти не через имитацию браузера, а через нативные хуки или REST API. Это снижает нагрузку и исключает детектирование как бота.

Главное – перенести логику обхода ограничений из вашего скрипта (который устаревает за неделю) в облако. Обновления алгоритмов защиты происходят на стороне сервиса, вам не нужно кастомить код под каждый апдейт ВКонтакте или Telegram.

Итог: устойчивый автопостинг – это не один скрипт, а архитектура. Автоматизация загрузки, агрегация источников, умная синдикация, платформенная интеграция. Это превращает распространение из рутины в пассивный процесс.

Связка генератора, переписчика и планировщика публикаций в единый процесс

| Старый метод | Наш метод |

|---|---|

| Ручной сбор тем, заказ на бирже, ожидание, правки, ручная загрузка в CMS. | Генерация семантического ядра, создание и рерайт контента, автоматическая публикация по расписанию. |

| Десктопный софт: настройка прокси, капчи, нагрузка на ПК, постоянный мониторинг. | Облачный TextLog: нажал кнопку – получил готовый контент в CMS. Никакого железа. |

| Риск низкого качества, срывов сроков, переплата за срочность. | Стабильное качество, предсказуемая скорость, фиксированная стоимость. |

Как связать генерацию с публикацией без ручного вмешательства?

Ключ – API. Генератор на основе новейших моделей создает первичный материал. Переписчик сразу его дорабатывает: меняет тональность, добавляет LSI-фразы, структурирует. Планировщик забирает готовый контент и отправляет в CMS по вашему календарю.

Автоматизация работает по принципу конвейера. Вы задаете настройки один раз – система производит контент, адаптирует его и публикует. Это основа для Programmatic SEO и масс-пейдж проектов.

Что дает синдикация контента для PBN-сетки?

Распространение одного качественного ядра по десяткам дроп-доменов. Генератор создает уникальные вариации. Планировщик равномерно распределяет публикации, имитируя естественное поведение. Это увеличивает охват и усиливает ссылочную массу для Tier-1.

- Полный цикл от семантики до публикации в одной панели.

- Интеграция с любыми CMS через API или RSS-фиды.

- Пакетная обработка тысяч статей для лонгтейла.

- Динамическая подстановка данных для максимальной уникальности.

Не путайте простой рерайт с глубокой переработкой. Дешевые инструменты меняют слова, но не смысл. Наш переписчик работает на уровне смысловых конструкций – это критично для индексации.

Роботизация процесса позволяет реинвестировать сэкономленный рекрол-бюджет в трафик. Вы не платите за штат копирайтеров, технических специалистов, дорогое железо.

Кейс: Арбитражник масштабировал PBN-сеть с 50 до 400 доменов за месяц. Единый процесс генерации и публикации позволил сосредоточиться на литье трафика. Пассивный доход с сетки вырос в 7 раз.

Синдикация и распространение контента становятся предсказуемыми. Вы управляете объемами, скоростью, качеством через один интерфейс. Интеграция с аналитикой позволяет сразу оценивать ROI по каждому кластеру.

Оценка трафика и бюджета на поддержку автоматизированной контент-сети

| Статья расходов / Метод | Ручной труд & Десктопный софт | Облачная генерация TextLog |

|---|---|---|

| Стоимость 1000 статей | 150 000 – 300 000 ₽ (копирайтеры) | ~15 000 ₽ (тариф «Масштаб») |

| Инфраструктура (прокси, сервера, софт) | от 10 000 ₽/мес. | 0 ₽ (всё в облаке) |

| Скорость наполнения (1000 статей) | 14-30 дней | 5-8 часов |

| Риск банов, капч, доработок | Высокий (рутина админки) | Нулевой (наша зона ответственности) |

- Полная агрегация затрат в одном счёте – нет скрытых платежей за прокси или API.

- Мгновенное масштабирование: увеличили рекрол-бюджет – сразу накрутили больше статей.

- Предсказуемый CPA: стоимость лида из трафика контент-сети фиксируется на 2-3 месяца вперёд.

Как рассчитать бюджет под Tier-1 трафик?

Отталкивайтесь от цели. Нужно 5000 посетителей в сутки на PBN-сетку? Алгоритм прост: анализ конкурентов в SERP + стоимость генерации LSI-статей. Для дроп-доменов с низким Trust – бюджет выше, так как требуется больший объём.

Ошибка новичка: вкладывать в генерацию контента для сайтов с плохой историей. Сначала – аудит и чистка, потом – автоматическая публикация. Иначе бюджет сгорит.

Синдикация и распространение через один канал рискованны. Диверсифицируйте: часть статей – глубокая генерация под ядро, часть – агрегация новостей под хвосты. Это распределит бюджет и риски.

Что важнее: объём или качество генерации?

Вопрос некорректен. Качество – это соответствие цели. Для сателлитов под масс-пейдж подойдёт средняя уникальность, но высокая релевантность по LSI. Для Tier-1 – только глубокая переработка с помощью топовых моделей. Бюджет делится соответственно.

Кейс: клиент получал 200$ в день с арбитража. После внедрения Programmatic SEO и автоматизации публикаций на 150 сайтах – доход вырос до 2000$ за счёт захвата длинного хвоста. Бюджет на поддержку сетки – 300$/мес.

Автоматизация – не «сделал и забыл». Это перенос бюджета с рутины (оплата копирайтеров, борьба с зеннопостером) на стратегию: анализ ключей, перераспределение бюджета между кластерами, A/B-тестирование заголовков.

VIP-тариф «Масштаб» включает не только генерацию, но и автоматическую привязку к вашим CMS, ротацию шаблонов и ежедневный отчёт по индексации. Идеально для сеток от 500 доменов.

Финансовая модель проста: вы платите только за объём текстов. Все технические риски (баны, капчи, обновления алгоритмов агрегации) – наши. Ваша задача – лить трафик и считать прибыль.

Вопрос-ответ:

Можно ли полностью автоматизировать наполнение сайта контентом без участия человека?

Полная автоматизация, при которой система самостоятельно пишет, редактирует и публикует материалы без контроля, невозможна и вредна для сайта. Современные инструменты — это помощники, которые значительно ускоряют процессы, но не заменяют человека. Например, можно автоматически собирать и агрегировать данные из разных источников (новостные ленты, каталоги товаров), генерировать черновики текстов на основе шаблонов или использовать переписывание (рерайтинг) существующих статей. Однако финальное редактирование, проверка фактов, расстановка смысловых акцентов и адаптация под голос бренда требуют человеческого участия. Без этого контент рискует быть безликим, содержать ошибки или не отвечать запросам вашей аудитории.

Какие существуют легальные способы автоматического получения текстов для сайта?

Легальные методы основаны на использовании открытых данных, лицензионного контента и технологий с соблюдением авторских прав. Во-первых, это агрегация: вы можете автоматически публиковать анонсы или краткие описания с обязательной ссылкой на первоисточник (например, новости отрасли). Во-вторых, использование готовых баз данных, например, описания товаров от поставщиков в формате XML или CSV для интернет-магазинов. В-третьих, применение нейросетей для создания уникальных текстов на основе заданных вами тезисов и структуры. Важно проверять и дорабатывать такие тексты. В-четвертых, заказ контента у копирайтеров с последующей автоматической публикацией по расписанию через CMS. Ключевой принцип — у вас должны быть права на публикуемые материалы.

Не навредит ли автоматический контент поисковому продвижению сайта?

Да, может навредить, если подходить к автоматизации бездумно. Поисковые системы, такие как Google, стремятся показывать пользователям полезные, оригинальные и качественные материалы. Машинный контент, который представляет собой бессмысленный рерайт, набор ключевых слов или скопированные без изменений чужие тексты, будет наказан. Алгоритмы хорошо распознают такие методы. Однако если использовать автоматизацию как инструмент для обработки больших объемов структурированных данных (характеристики товаров, расписания, спортивные результаты) или для создания первичных черновиков, которые затем серьезно дорабатываются человеком, то вред будет минимален. Главное — конечный материал должен давать ценность посетителю.

Как автоматизировать наполнение сайта товарами для интернет-магазина?

Это одна из самых распространенных и оправданных задач автоматизации. Процесс строится на работе с фидами — файлами данных от поставщиков. Обычно это XML или CSV-файлы, содержащие артикулы, названия, цены, остатки, описания и ссылки на изображения. С помощью специальных модулей или плагинов для вашей CMS (например, WordPress с WooCommerce или 1С-Битрикс) вы настраиваете регулярный импорт этих файлов. Система сама создает карточки новых товаров, обновляет цены и остатки, а также скрывает отсутствующие позиции. Основная работа здесь — первоначальная настройка соответствия полей и категорий, а также регулярная проверка корректности загружаемых данных. Это избавляет от ручного ввода тысяч позиций.

Стоит ли использовать нейросети для генерации статей и как это делать правильно?

Использовать нейросети можно, но с четким пониманием их роли. Они эффективны для преодоления «чистого листа»: создания плана статьи, написания введения или заключения, формулировки тезисов по заданной теме. Однако полученный текст почти всегда требует серьезной правки. Правильный подход: 1) Задать нейросети подробный запрос с указанием стиля, целевой аудитории и ключевых пунктов. 2) Получить черновик. 3) Полностью переработать его: добавить личный опыт, конкретные примеры, проверить факты, «очеловечить» язык, вставить уникальные детали. Публикация сырого текста от нейросети выдает лень и создает риск санкций от поисковиков. Нейросеть — это мощный помощник для автора, а не автор.

Хочешь купить статьи дешево для сайта и блога? Перейти в магазин статей

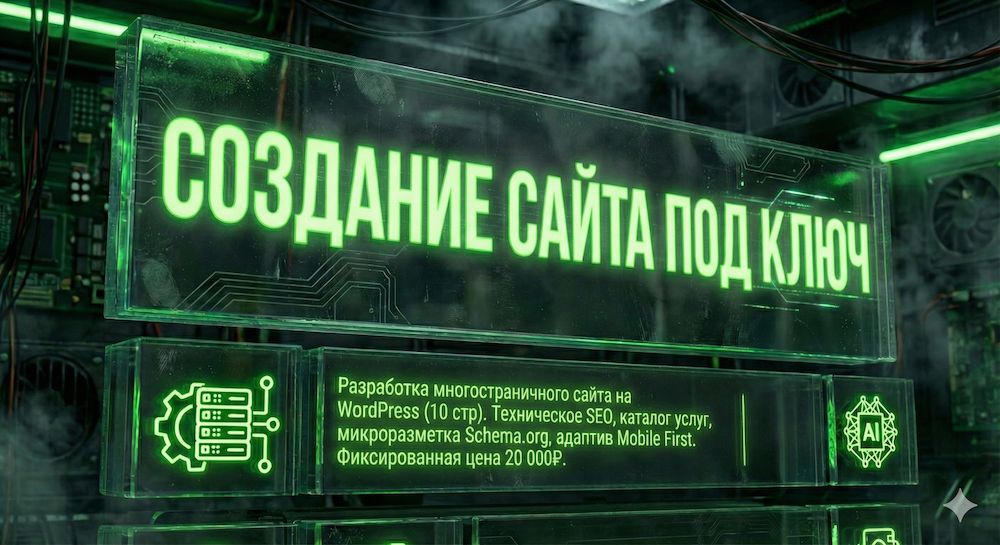

Нужен современный сайт или лендинг? Заказать создание сайта

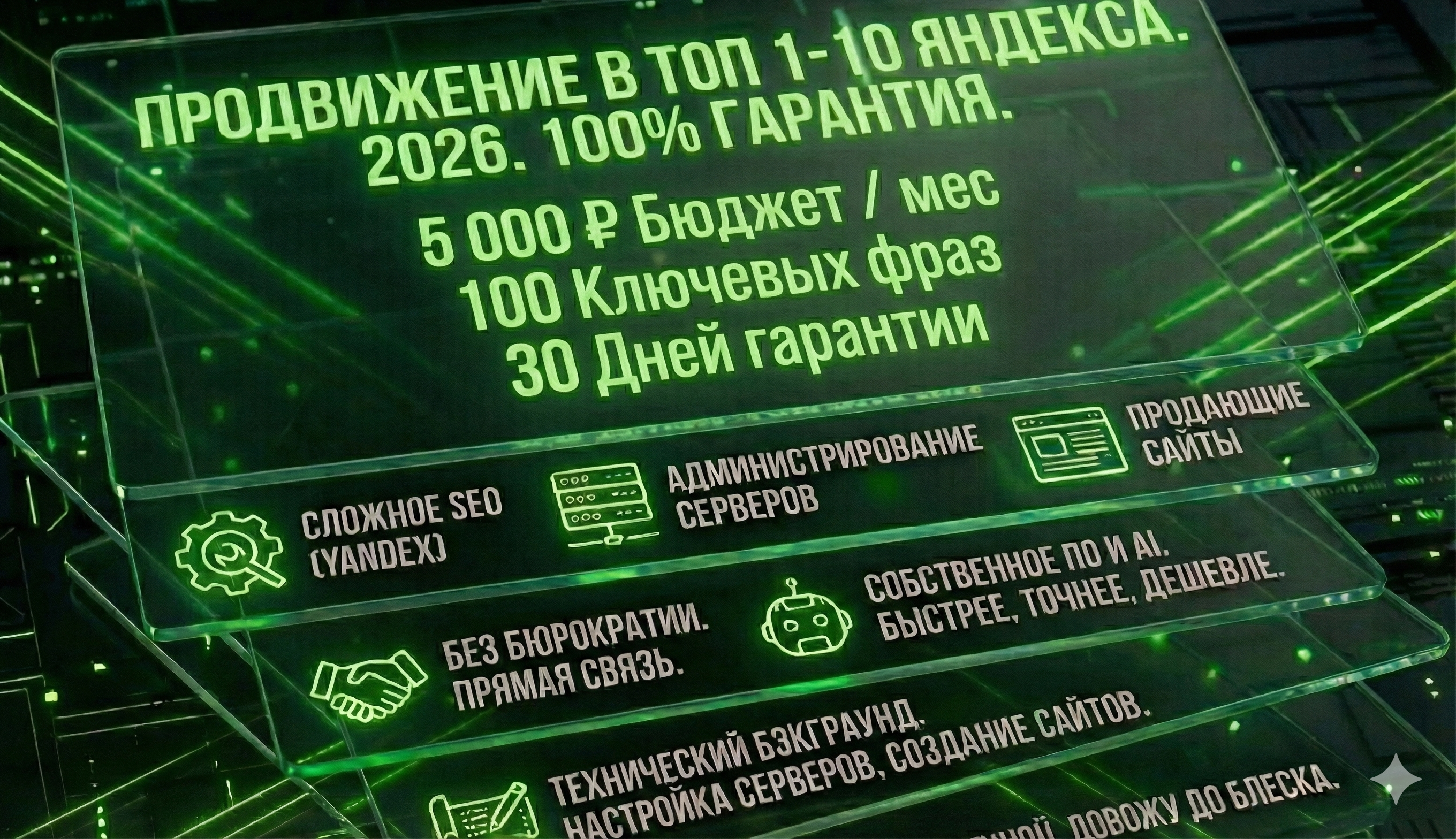

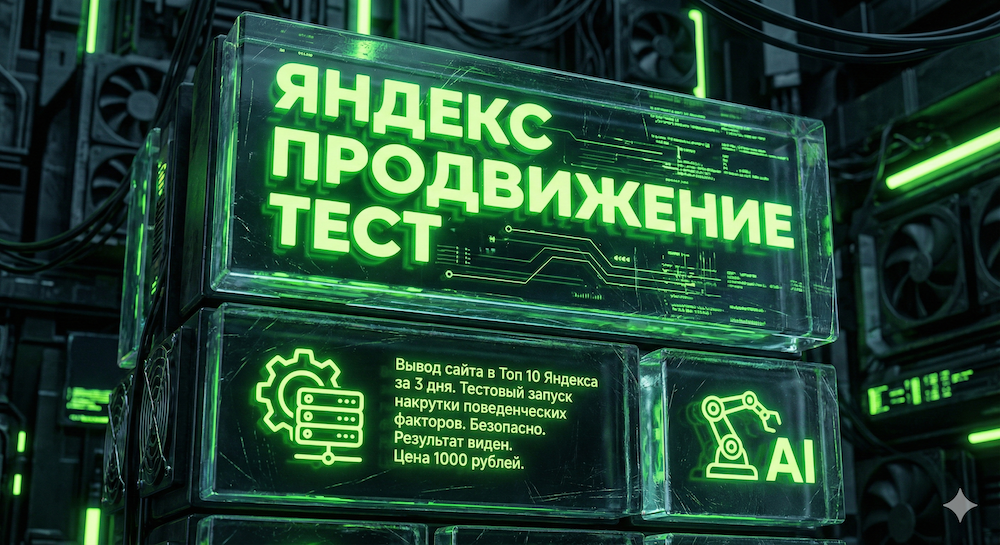

Сайт не видно в поиске? Продвинуть сайт в ТОП Яндекс