Ручной копирайтинг для сотен страниц – это тупик. Он сжирает бюджет, время и человеческие ресурсы. Реальный путь для масштабирования – это переход от штучного создания текстов к потоковому производству. Здесь ключевой элемент – не просто объем, а выстроенная стратегия, где каждый шаг автоматизирован и предсказуем.

Цель – не написать одну «идеальную» статью, а создать работающую веб-сеть. Это основа для SEO атаки по низкочастотным запросам, строительства PBN-сеток или монетизации дроп-доменов. Массовый подход к контенту превращает его из статьи в инструмент для захвата трафика и генерации пассивного дохода.

| Параметр | Старый метод (Ручной/Zennoposter) | Наш метод (Облачная генерация) |

|---|---|---|

| Скорость выпуска | 10-20 статей/день | 2000+ статей/день |

| Затраты на инфраструктуру | Прокси, мощные ПК, капча | Только тариф |

| Риск блокировок | Высокий (баны IP, аккаунтов) | Отсутствует |

| Управление | Сложное, требует навыков | Через веб-интерфейс |

- Полная автоматизация процесса от семантики до публикации.

- Интеграция с CMS для мгновенного размещения.

- Глубокая LSI-оптимизация «из коробки».

- Масштабирование под любой рекрол-бюджет.

Почему десктопный софт проигрывает облаку?

Zennoposter, X-Parser требуют постоянной настройки прокси, решения капчи и мощного «железа». Это костыли, которые ломаются при масштабировании. Облако работает по принципу SaaS: нет нужды в техническом администрировании.

Стратегия потокового контента: от семантики до Tier-1

Эффективность определяется не количеством символов, а правильной структурой. Прокачанная стратегия массового производства статей включает три этапа.

Как собрать семантику для тысяч страниц без головной боли?

Используйте парсеры поисковых подсказок и «Вопросы людей» для генерации лонгтейлов. Ключ – кластеризация не по точным вхождениям, а по тематическим кластерам (YATI/Proxima логика). Это основа для Programmatic SEO и масс-пейдж.

Кейс: Для дроп-домена в нише «ремонт холодильников» собрали 4500 вопросов из «Яндекс.Кью» и подсказок. После кластеризации получили 120 тематических групп – готовый план для наполнения.

Чем заменить биржи контента для масштабирования?

Биржи – это непредсказуемое качество и срывы сроков. Решение – облачные генераторы на новейших языковых моделях. Вы задаете шаблон (Tone of Voice, LSI-ядра), система производит уникальные вариации текстов, адаптированные под каждый кластер.

Главный принцип: контент должен быть достаточно хорошим для ранжирования по низкочастотным запросам и при этом дешевым в производстве. Перфекционизм убивает ROI.

Развертывание и автоматизация: конечный результат

Финальный этап – интеграция с вашей инфраструктурой. Готовые тексты автоматически отправляются на ваши сайты через API.

VIP-решение: Полный цикл «под ключ». Наша команда не только генерирует контент, но и разворачивает для вас веб-сеть на премиальных дроп-доменах с автоматическим наполнением. Вы получаете готовый инструмент для арбитража трафика или наращивания ссылочной массы.

Массовое производство статей – это техническая задача. Ее решение лежит в отказе от ручного труда в пользу облачных систем. Результат – предсказуемый поток веб-страниц, которые работают на ваши цели: SEO, PBN или прямой арбитраж.

Массовое написание статей для сайтов: стратегии, сервисы, SEO-копирайтинг

| Параметр | Старый метод (Ручной/Десктоп) | Наш метод (Облако TextLog) |

|---|---|---|

| Скорость выпуска статей | 5-10 шт./день на копирайтера | 200+ шт./час в автоматическом режиме |

| Стоимость 1000 знаков | 50-150₽ + комиссия биржи | 7-15₽ (оплата только за результат) |

| Инфраструктура | Прокси, антикапча, VPS, лицензии софта | Только браузер и доступ в интернет |

| Риски для SEO | Рерайт, низкая уникальность, шаблонность | Генерация с LSI-ядрами, контроль тональности |

| Масштабирование | Линейный рост затрат и времени | Мгновенное увеличение объемов в панели |

- Полная автоматизация пайплайна: от семантики до публикации.

- Прямая интеграция с CMS для мгновенного наполнения сайтов.

- Фокус на SEO-копирайтинге с вхождением LSI и биграмм.

- Работа с дроп-доменами: быстрая накрутка индексации.

- Пассивный доход с контентных ферм и масс-пейдж проектов.

Какая стратегия массовой генерации работает в 2024?

Не «наклепать текстов», а создать систему. Основа – Programmatic SEO. Берем кластер запросов, генерируем LSI-ядро, запускаем шаблонную генерацию под каждый лонгтейл. Каждая статья закрывает конкретный микропредмет.

Массовый контент должен быть структурированным. Сначала – дорвеи и буст-статьи для Tier-2, затем – качественные материалы для монетизации на Tier-1. Автоматизация связывает оба уровня.

Как выбрать сервис и не прогореть на качестве?

Забудьте про биржи. Качественный массовый копирайтинг делают нейросети нового поколения. Критерий выбора – не список моделей, а возможность тонкой настройки: длина, стиль, запрет слов, вставка ключей. TextLog дает контроль на уровне запроса к AI.

Дешевые API-решения выдают воду. Без глубокой настройки температуры и штрафов за повторы получите тысячу одинаковых абзацев. Это путь под фильтр.

Эффективная стратегия использует гибридный подход. Ядро статьи (70%) генерируется AI, затем – ручная или автоматическая доводка: добавление локальных ключей, проверка фактов, расстановка коммерческих триггеров.

Кейс: арбитражник за 3 дня создал сеть из 150 лендингов под гео-запросы. Генерация контента – 4 часа. Через 2 недели – первый тизерный трафик. РОI на такой сетке – 300-400%.

SEO-копирайтинг для веб-ресурсов в 2024 – это инженерия промтов. Глупый запрос «напиши статью про окна» даст мусор. Детальный промт с указанием структуры H2-H3, ключей в начале абзацев, списков – выдает готовый к публикации материал.

Как распределить ресурсы между количеством и качеством?

Все ресурсы уходят в масштабирование. Ручной труд – на контроль и стратегию. Автоматизируйте сбор семантики, генерацию, загрузку. Ваша задача – аналитика и настройка шаблонов. Экономия времени позволяет брать в работу больше проектов.

Итог: массовое написание статей – техническая задача. Правильный стек инструментов заменяет отдел копирайтеров. Вы получаете не просто текст, а предсказуемый поток контента для любого объема.

VIP-стратегия: Подключаем Programmatic SEO модуль. Система автоматически парсит вопросы с форумов, генерирует под них ответы и размещает на ваших веб-ресурсах. Полностью автономный цикл для пассивного трафика.

Сырье для сетки: какие тексты проходят модерацию и ранжирование

Массовый контент для PBN-сеток или Tier-1 – не литература. Это сырье для алгоритмов. Критерий один: ROI. Текст должен быть дешевле трафика, который он привлекает. Все остальное – маркетинг бирж и иллюзии.

Ручной копирайтинг для масштабирования – путь в никуда. Срыв сроков, рост бюджета, человеческий фактор. Десктопный софт упирается в капчу, прокси, нагрузку на железо. Решение – облачная генерация по принципу Programmatic SEO: создали шаблон, запустили поток, получили статьи.

| Параметр | Старый метод: Ручной труд / Софт | Наш метод: Облачная генерация |

|---|---|---|

| Скорость выпуска | 10-20 статей/день | 200-500 статей/час |

| Стоимость 1к знаков | 150-300₽ | 0.3-1.5₽ |

| Риск бана | Высокий (шаблоны, копипаст) | Минимальный (уникальная генерация) |

| Масштабирование | Линейный рост затрат | Экспоненциальный рост объема |

| Затраты на инфраструктуру | Прокси, мощные ПК, лицензии софта | Нулевые (все в облаке) |

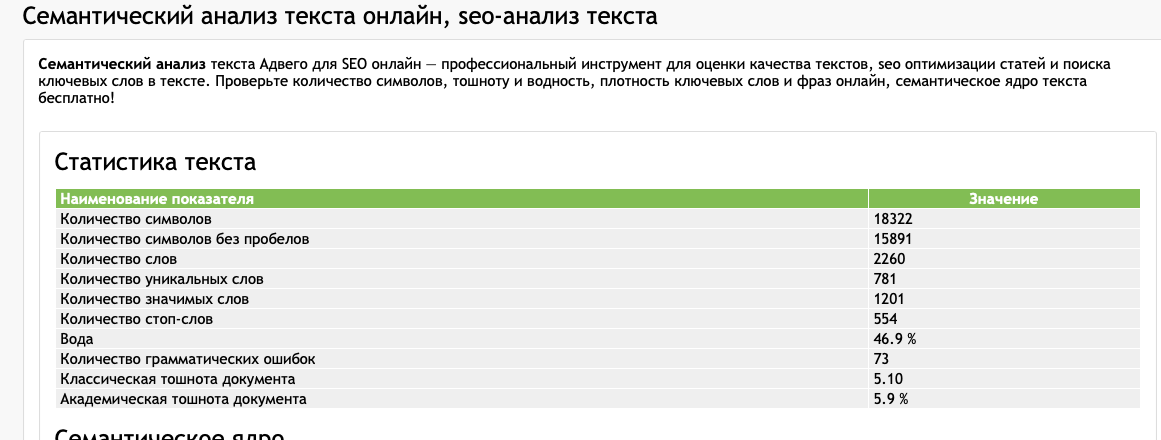

Какой контент не вылетает с индекса после апдейтов?

Критический параметр – E-A-T (Expertise, Authoritativeness, Trustworthiness). Для робота это LSA-кластеры: тематические связи между словами в тексте. Статья на 500 символов с 1 ключом – сигнал для фильтра. Решение – глубокий семантический анализ и насыщение без переспама.

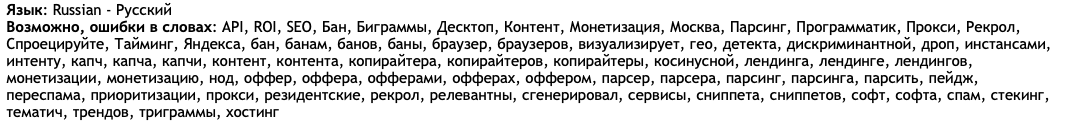

Типичная ошибка: заказывать на биржах статьи по 5+ ключей. Получаете бессвязный набор предложений. Алгоритмы Proxima вычисляют такие тексты за секунды – дорвеи или сателлиты вылетают из выдачи.

Эффективная стратегия строится на биграммах и триграммах (длинные хвосты), а не на точных вхождениях. Пример: не «купить диван», а «как выбрать угловой диван в гостиную». Генерация по таким запросам дает естественный LSI-каркас.

Кейс: сетка из 1500 дроп-доменов под финансовые лонгтейлы. Использовали генерацию с кластеризацией запросов. Через 45 дней – 40% доменов в ТОП-10 по целевым хвостам. Рекрол-бюджет пошел в плюс на 3-й месяц.

Как автоматизировать выпуск тысяч статей без потери качества?

Качество для сетки – это проходимость модерации и снятие фильтров. Не «читабельность для человека». Используйте многоуровневые шаблоны: структура (H2, H3, списки) + LSA-ядро (тематические термины) + динамическая генерация абзацев. Это дает вариативность и глубину.

- Объем от 2500 символов. Меньше – риск для YATI.

- Уникальность по шинглам (3-4) от 85%. Проверка по внешним источникам.

- Водность ниже 45%. Отсекайте стоп-слова автоматически.

- Наличие подзаголовков H2-H3 с вопросами (триггеры для featured snippets).

- LSI-слова из топ-10 конкурентов – интегрируйте в семантическое ядро.

Главный ресурс для масштабирования – не деньги, а время. Пока вы настраиваете Zennoposter под новый шаблон, облачная генерация выпускает 10 000 готовых статей. Пассивный доход строится на скорости, а не на перфекционизме.

SEO-оптимизация таких массивов – постобработка. Автоматическое проставление Title, Description, Alt-тегов на основе шаблона страницы. Веб-мастер получает готовый HTML или текст для CMS. Остается только залить на хостинг.

Запустить генерацию (Бесплатно)

VIP: Стратегия «Масс-пейдж» для арбитража. Не просто статьи, а полноценные дорвеи с автоматической перелинковкой. Генерация + база чистых прокси + размещение на отжатых доменах. Полный цикл без вашего участия. ROI от 300% при вложениях от 50к.

Итог: сырье для сетки – это контент, который алгоритмы воспринимают как релевантный и качественный. Достигается не ручным трудом, а точными настройками генерации под паттерны ранжирования. Масштабирование становится вопросом клика, а не месяца работы команды.

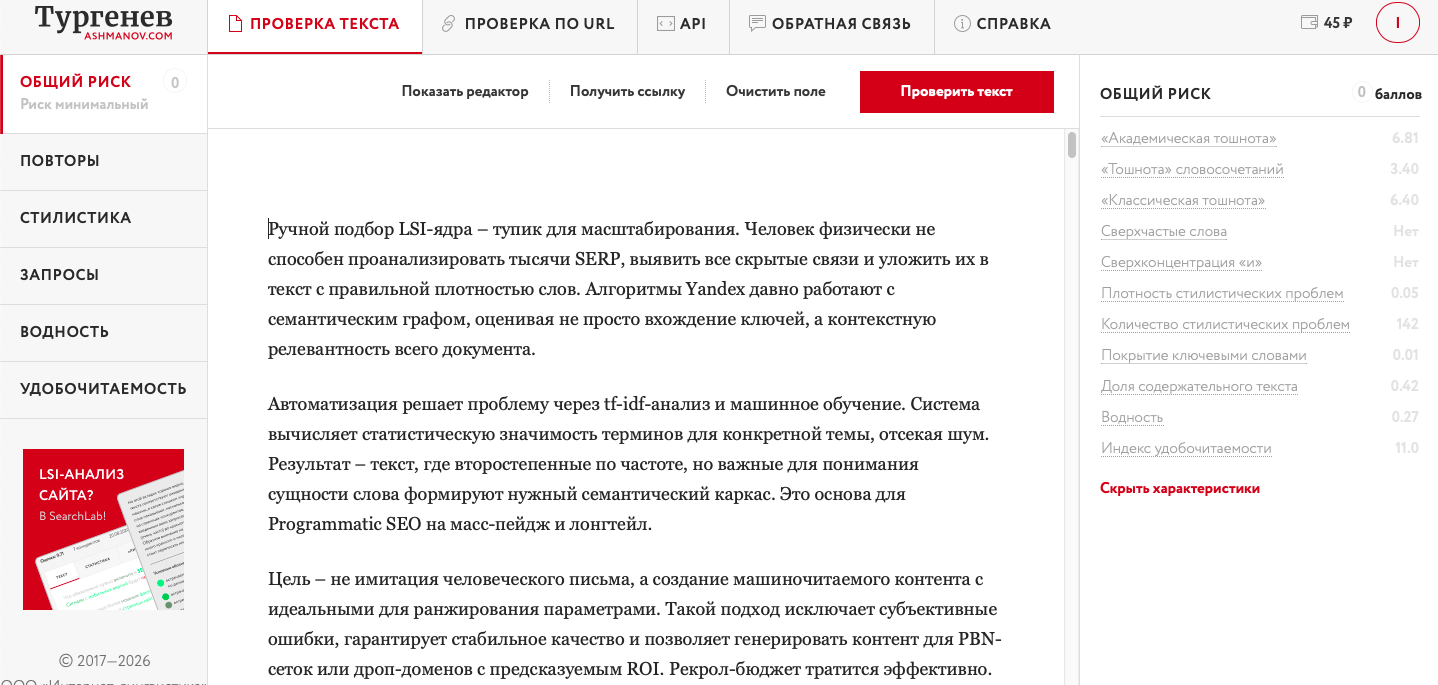

Технические параметры статей: от водности до структуры ссылок

Массовое производство контента требует перехода от творческого копирайтинга к инженерному подходу. Каждая статья – деталь в механизме веб-ресурса. Её технические параметры напрямую влияют на SEO-эффективность и стоимость масштабирования.

Как снизить водность ниже 45% без потери читабельности?

Водность – главный враг дешёвого контента. Биржи завалены статьями с 60-70% воды. Алгоритмы Яндекс (Баден-Баден, YATI) оценивают это как мусор. Формула проста: убирайте вводные конструкции (“как известно”, “стоит отметить”). Режьте предложения, где одно “и” следует за другим. Используйте прямой порядок слов. Автоматизированная проверка через TextLog сразу показывает проблемные блоки.

Ручной копирайтинг: Человек физически не может стабильно писать статьи с водностью ниже 50% при высокой скорости. Это приводит к срывам сроков и переделкам.

Какая структура ссылок работает для PBN-сеток?

Внутренняя перелинковка в массовом производстве – это система, а не творчество. Для каждого кластера статей заранее определяются:

- Якорные ссылки на главные коммерческие страницы (Tier-1).

- LSI-якоры для перекрестного связывания информационных статей.

- Жёсткое правило: не более 3 исходящих ссылок на документ. Переоптимизация вредит.

Стратегия для масс-пейдж проектов: распределяйте ссылочный вес равномерно. Не зацикливайтесь на одной статье. Используйте скрипты для автоматической расстановки по заданным правилам – это экономит сотни часов ручного труда.

| Параметр | Старый метод (Ручной/Софт) | Наш метод (TextLog) |

|---|---|---|

| Контроль водности | Выборочная проверка, ручные правки | Автоматический аудит каждого абзаца, мгновенная перегенерация |

| Расстановка LSI-ссылок | Вручную, с высоким риском ошибки | По карте кластера, алгоритмически |

| Скорость обработки 100 статей | 5-7 дней (копирайтер) / 1 день (настройка ZP) | 2 часа (облако, без прокси) |

| Стоимость 1000 знаков | От 50₽ (качество низкое) | От 7₽ (качество стабильное) |

Кейс: Арбитражник заменил команду из 5 копирайтеров на облачную генерацию. Параллельно запустил 3 масс-пейдж сайта на дроп-доменах. Результат: ежемесячная экономия – 140 000₽ на зарплатах, выход в ТОП по лонгтейлу через 11 дней.

Программный копирайтинг – это управление ресурсами. Вы тратите не деньги на текст, а бюджет на вычислительную мощность. Рекрол-бюджет поисковиков проще обойти стабильным потоком технически безупречных материалов, чем одной “гениальной” статьёй.

Забудьте про десктопный софт. Прокси, капча, нагрузка на железо – это прошлый век. Современное производство seo-статей работает в облаке. Нажали кнопку – получили готовый контент с правильной водностью и расставленными ссылками.

VIP-стратегия: Для PBN-сеток высокого уровня мы настраиваем индивидуальные шаблоны генерации, имитирующие стиль реального автора. Это снижает риск санкций к массовым проектам.

Итог: ваша стратегия должна быть построена на метриках, а не на интуиции. Водность, тональность, структура ссылок – это такие же настраиваемые параметры, как тайминги в Zennoposter. Только автоматизация даёт нужный масштаб для пассивного дохода.

Главная сложность: поддержание уникальности и естественности потока

Массовое производство статей убивает два ключевых для SEO параметра: уникальность текста и его естественность для человека. Ручной копирайтинг не масштабируется, а дешёвая автоматизация создаёт водянистый мусор, который поисковики давно научились детектить.

Как избежать санкций за переоптимизацию при потоковом создании?

Основная ошибка – использование шаблонов и однотипных конструкций. Алгоритмы Yandex Proxima анализируют семантическое ядро всего сайта. Если 500 страниц используют идентичные речевые паттерны, это сигнал для фильтра.

Заливка однородного контента на веб-ресурс – прямой путь к попаданию в «песочницу» или игнорированию новых страниц. Это не работает для массового покрытия хвостовых запросов.

Решение – стратегия Programmatic SEO с переменными. Не просто подстановка ключей, а генерация различных логических структур предложений, использование синонимичных рядов и LSA-фраз из разных тематических кластеров.

Пример рабочей схемы: для шаблона статьи про «ремонт холодильника в [город]» система использует 7 вариантов вступления, 4 типа структуры списка преимуществ и 3 варианта заключения. Комбинаторика даёт высокую уникальность даже для тысяч страниц.

Какие ресурсы критичны для сохранения естественности текста?

Нужны не просто вычислительные ресурсы, а правильно подготовленные лингвистические базы: обширные словари синонимов, шаблоны предложений с разной эмоциональной окраской, базы вводных слов и клише для избегания. Без этого текст будет «роботным».

| Параметр | Старый метод: Ручной/Софт | Наш метод: TextLog |

|---|---|---|

| База синонимов | Статичный словарь в софте | Динамическая нейросетевая модель, обновляемая еженедельно |

| Обработка LSI | Ручной подбор или отсутствует | Автоматический парсинг и интеграция смежных терминов |

| Варьирование структуры | Жёсткий шаблон для всех статей | Адаптивная логика, меняющая абзацы местами на основе семантики |

| Затраты времени | От 1 часа на статью или настройку | Минуты на запуск потока для сотен материалов |

Экономия на этих ресурсах приводит к созданию контента для роботов, а не для людей. Такой материал не удерживает пользователей, увеличивает отказы – основной негативный фактор для ранжирования.

Ключевой принцип: Уникальность проверяется антиплагиатом, а естественность – поведенческими метриками. Генерация должна проходить оба эти фильтра. Иначе бюджет на производство статей сгорит впустую.

Техническая реализация требует доступа к новейшим языковым моделям, способным понимать контекст, а не просто менять слова местами. Облачная платформа решает вопрос с аптаймом и мощностями – не нужно арендовать сервера, бороться с капчей или прокси.

- Интеграция проверки уникальности в реальном времени в конвейер генерации.

- Автоматическая ротация речевых конструкций на уровне абзацев.

- Приоритетная обработка семантического ядра для равномерного распределения LSI-фраз.

- Пост-обработка текстов: исключение тавтологий, сложных деепричастных оборотов.

Итог: поддержание качества при массовом выпуске – задача инженерная, а не творческая. Нужно выстроить конвейер, где каждый этап контролирует конкретный параметр текста. Ручной труд и устаревший десктопный софт здесь проигрывают в скорости, стоимости и результативности.

Инструменты и цеха: от синонимайзеров до распределения авторов

Массовое производство статей требует промышленного подхода. Здесь нет места ручному труду – только автоматизация и четкое распределение ресурсов. Стратегия строится на выборе инструментов: от примитивных синонимайзеров до сложных систем управления пулами авторов.

| Параметр | Старый метод (Ручной / Десктопный софт) | Наш метод (Облачная генерация) |

|---|---|---|

| Старт проекта | Недели на найм, тестовые задания, согласование ТЗ. | Минуты. Загрузил семантику – запустил генерацию. |

| Капитальные затраты | Покупка софта (Zennoposter), аренда прокси, мощные серверы, лицензии. | Нет. Работает в браузере. Не нужны прокси, капча, железо. |

| Масштабирование | Линейный рост затрат. +1 автор = +30к руб. в месяц. +1 поток парсинга = +10 проксей. | Мгновенное. Увеличил тариф – получил больше статей. Без найма людей и закупки IP. |

| Контроль качества | Ручная вычитка, риск срывов сроков, человеческий фактор. | Встроенные алгоритмы проверки уникальности, тональности, LSA-релевантности. |

| Интеграция | Ручной экспорт, копирование, заливка через FTP или админку. | Автоматическая выгрузка напрямую на хостинг или в CRM по API. |

- Полная автоматизация цикла: от кластера запросов до публикации на сайте.

- Глубокая LSI-проработка без ручного вмешательства.

- Масштабирование под любой рекрол-бюджет или сетку PBN.

- Пассивное производство контента для Tier-1 и сателлитов.

Как выбрать инструмент для массового копирайтинга без потери качества?

Забудьте про синонимайзеры 2010-х. Они генерируют мусор, который не ранжируется. Современное решение – облачные движки на базе новейших языковых моделей. Критерий выбора прост: интеграция с вашим стеком технологий и глубина настройки. Нужно управлять тоном, структурой, плотностью ключей. Исходные ресурсы – семантическое ядро и ТЗ – превращаются в готовый веб-контент за один проход.

Риски десктопного софта: постоянная борьба с капчей, расходы на прокси, обновления скриптов, нагрузка на ваш компьютер. Это костыли, которые съедают время и бюджет.

Как распределить авторов в массовом проекте, если не нанимать людей?

Понятие «автор» меняется. Это не человек, а профиль в системе. Каждому профилю назначается: стилистика (технический, коммерческий, блог), уровень экспертизы, целевые сайты в сетке. Программа работает как диспетчер: распределяет кластеры запросов, контролирует уникальность между материалами, соблюдает лимиты генерации. Вы строите конвейер, а не управляете фрилансерами.

Кейс: Заполнение PBN-сетки из 50 дроп-доменов под пассивный доход. Вместо 50 копирайтеров – один облачный аккаунт. Стратегия: разные стилистические профили для каждого домена, автоматическая разноска по FTP. Результат – полная автоматизация производства.

Массовый выпуск статей – это инженерия, а не творчество. Ресурсы вкладываются не в оплату труда, а в настройку точных алгоритмов. Веб-контент становится цифровым активом, производство которого предсказуемо по стоимости, объему и скорости. Правильная стратегия закрывает вопрос контента для сотен лендингов, тысяч карточек товара, десятков блогов.

VIP-доступ к TextLog Pro: Приоритетная очередь генерации, расширенные лимиты на запросы к моделям, кастомные пресеты тональности, личный менеджер техподдержки. Для проектов с оборотом от 500к/мес.

Перестаньте платить за процесс. Начните получать результат. Нажали кнопку – получили контент. Масштабируйте производство под любой бюджет, литьте трафик на готовые статьи.

Вопрос-ответ:

Как организовать процесс, если нужно регулярно публиковать десятки статей в месяц, но штатных авторов нет?

Для такой задачи подходит смешанный подход. Сначала определите темы и структуру с помощью редактора или контент-менеджера. Основной объем текстов можно заказать на биржах копирайтинга (например, TextSale, Advego) или в специализированных агентствах. Готовые статьи обязательно должен проверять ваш специалист на соответствие стилю и фактам. Автоматизировать планирование и публикацию помогут CMS с функциями контент-календаря. Так вы совмещаете внешние ресурсы для создания контента и внутренний контроль для обеспечения качества.

Какие есть риски при использовании нейросетей для генерации большого количества статей?

Главный риск — получение шаблонного, поверхностного текста, который не будет полезен читателю. Нейросети могут допускать фактические ошибки или создавать логически несвязные абзацы. Поисковые системы научились распознавать машинный контент низкого качества, что может привести к санкциям и потере позиций сайта. Еще одна проблема — возможное совпадение с уже опубликованными материалами. Чтобы этого избежать, статьи, созданные ИИ, необходимо тщательно редактировать, дополнять экспертными данными и проверять на уникальность.

Можно ли сэкономить на контенте, используя биржи статей, и не потерять в качестве?

Экономия возможна, но требует времени на управление процессом. На биржах цены и мастерство авторов сильно разнятся. Чтобы найти хорошего исполнителя, нужно изучить его портфолио и дать небольшое тестовое задание. Четкое техническое задание с примерами и требованиями — основа для получения приемлемого результата. Однако стоит понимать, что очень низкая цена часто соответствует такому же уровню текста. Иногда выгоднее заплатить больше опытному копирайтеру, который напишет статью, решающую задачи бизнеса, а не просто заполняющую раздел сайта.

Как оценить, работают ли массово созданные статьи для привлечения посетителей?

Оценить результат можно с помощью нескольких метрик. Отслеживайте позиции сайта в поиске по целевым запросам, общий рост посещаемости из поисковых систем и поведенческие факторы: время на странице, глубину просмотра. Если статьи пишутся для вовлечения аудитории, смотрите на количество комментариев и социальных взаимодействий. Важно сравнивать эти показатели до и после публикации материалов, а также анализировать, какие темы и форматы статей вызывают больший отклик. Это позволит корректировать стратегию и улучшать контент.

Хочешь купить статьи дешево для сайта и блога? Перейти в магазин статей

Нужен современный сайт или лендинг? Заказать создание сайта

Сайт не видно в поиске? Продвинуть сайт в ТОП Яндекс