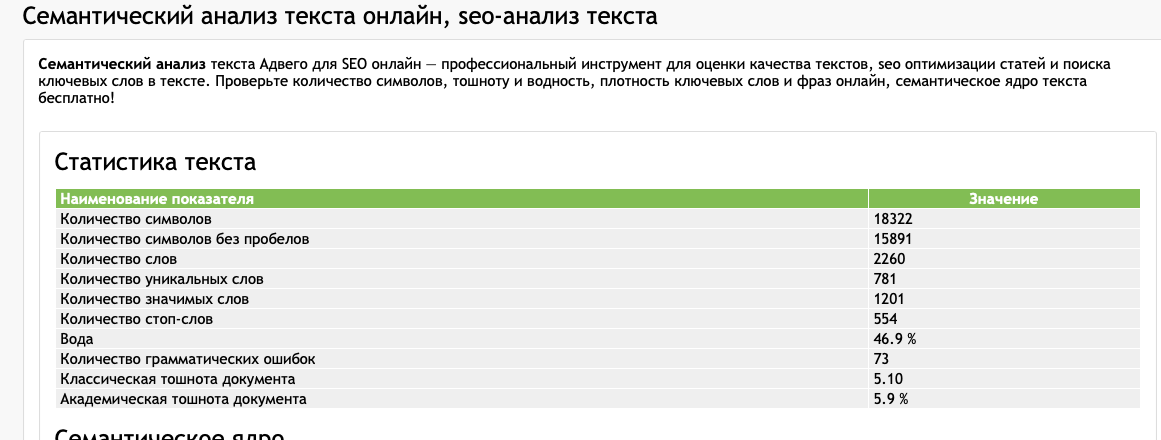

Сеть сайтов требует вечного потока текстов. Ручной копирайтинг съедает рекрол-бюджет, биржи контента ставят под угрозу уникальность всей структуры. Решение – системный подход, где каждый материал работает на семантику и релевантность ядра.

Оптимизация здесь – не про тонкую настройку мета-тегов. Это автоматизация производства, где масштабирование напрямую влияет на ROI. Ключ – переход от ручного труда к программируемым процессам, где контент генерируется под конкретные дроп-домены и их нишевые запросы.

Стратегия строится на двух столпах: абсолютная уникальность для каждого сайта в сети и безупречная релевантность для продвигаемых лонгтейлов. Провал в любом из пунктов ведет к сливу бюджета и рискам для всей PBN-сетки.

| Старый метод | Наш метод |

|---|---|

| Ручной копирайтинг: 500₽ за текст, сроки срываются, человеческий фактор. | Облачная генерация: фиксированная цена за объем, контент в минуты, стабильное качество. |

| Десктопный софт: сложная настройка прокси, капчи, нагрузка на железо, постоянные баны. | TextLog: работа из браузера, никакой инфраструктуры. Нажал кнопку – получил контент. |

| Биржи контента: шаблонные тексты, низкая релевантность, риск санкций за копипаст. | Глубокая семантическая обработка: каждый текст заточен под LSI-ядро и цели Tier-1. |

- Полная автоматизация наполнения для масс-пейдж и сателлитов.

- Глубокая оптимизация под низкочастотные запросы и коммерческие интенты.

- Мгновенное масштабирование потока текстов под новые дроп-домены.

- Пассивный доход за счет устранения постоянных затрат на копирайтеров.

Стратегии генерации: от семантического ядра до текста

Основа – четкое техническое задание для генератора. Не просто «напиши про ремонт холодильников», а строгий набор L-запросов, тональность, структура ответа. Это программирование контента, а не заказ у фрилансера.

Как собрать семантику для PBN, чтобы не спалиться?

Используйте кластеризацию не для основного проекта, а для сети. Каждому сайту – свой микро-кластер с низкочастотными запросами. Генератор получает четкий список фраз, под которые создается материал с естественным вхождением. Релевантность проверяется алгоритмами, а не на глаз.

Что важнее для PBN: объем или уникальность?

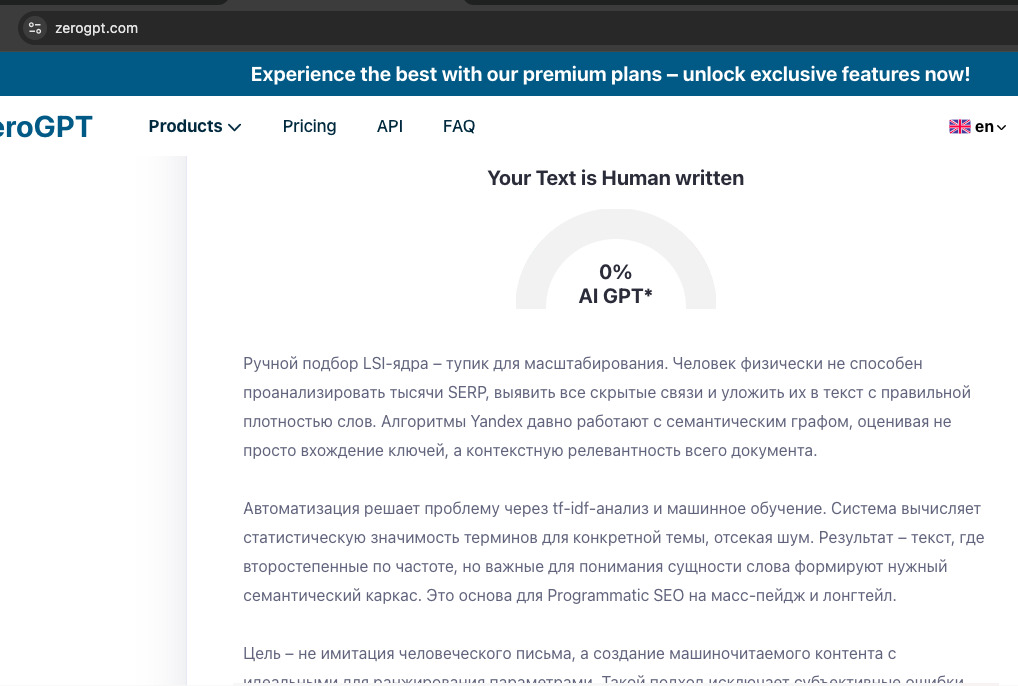

Уникальность – абсолютный приоритет. Один неуникальный текст ставит под удар все линки с этого домена. Современные нейросети обеспечивают техническую уникальность на уровне 100%, но смысловая ценность – результат правильного промпта. Объем наращивается позже, автоматически.

Кейс: Замена команды из 5 копирайтеров на облачный генератор для сети из 50 сателлитов. Ежемесячная экономия – 450 000₽. Скорость закрытия контент-плана выросла с 30 до 2 дней.

Источники и их риски: где брать тексты без костылей

Традиционные источники – аутсорс-биржи, копирайтеры-фрилансеры – это расходы, задержки, неконтролируемое качество. Десктопные парсеры требуют затрат на инфраструктуру: прокси, антикапчу, мощные серверы, постоянное обслуживание.

Внимание: Использование склейки (рерайта) украденного контента через X-Parser или Zennoposter – прямой путь к банам и потере доменов. Алгоритмы легко детектируют шаблонность и источники копипаста.

Единственный рабочий источник – генерация с нуля на основе вашего семантического ядра. Современные модели создают связный, релевантный текст, который проходит проверки на уникальность и релевантность.

Критические ошибки и как их избежать

Главная ошибка – экономия на качестве контента для PBN. Это фундамент, на котором держится вес домена и эффективность линков. Вторая ошибка – отсутствие единого стиля и тональности внутри сети, что легко детектируется.

Третья – пренебрежение актуальностью. Контент должен быть вечным, но в рамках трендов ниши. Устаревшие данные снижают доверие.

Программное наполнение PBN – это не выбор между «дешево» и «качественно». Это переход на модель, где «качественно» становится «доступно» и «масштабируемо». Ручной труд неконкурентоспособен.

Откуда брать материалы для сетки: легальные, полулегальные и рискованные источники

Контент – кровь любой PBN-сетки. Без постоянного потока материалов сайты превращаются в дроп-домены. Источники делятся на три категории по уровню риска и трудозатрат.

| Категория | Старый метод | Наш метод | ROI |

|---|---|---|---|

| Легальные | Биржи копирайтинга, дорогие авторы | Облачная генерация по семантике | Низкий |

| Полулегальные | Парсинг X-Parser, ручной рерайт | Автоматический рерайт через API | Средний |

| Рискованные | Копипаст, склейка статей | Не используем – бан сетки | Отрицательный |

Где найти легальный контент без переплат?

Легально – значит с уникальностью под 95-100%. Биржи вроде TextSale или Advego выжимают рекрол-бюджет. За 50 000₽ получаете 200 статей среднего качества. Сроки сорвут, релевантность – лотерея.

Легальная альтернатива – Programmatic SEO. Берете LSI-ядро, загружаете в облачный генератор. Получаете сотни вечных статей под низкочастотные запросы. Оптимизация по семантика происходит автоматически.

- Генерация через API (TextLog, OpenAI) – масштабирование до 1000 статей/час.

- Покупка дроп-домнов с готовым контентом – фильтровать по индексации.

- Синдикация RSS с глубоким рерайтом – для сателлитов Tier-2.

Как использовать полулегальные источники без потери качества?

Полулегальные методы – парсинг и рерайт. Десктопный софт (Zennoposter) требует прокси, капчи, мощного железа. Стоимость владения высокая.

Прямой копипаст или склейка абзацев ведут к пессимизации всего кластера. Поисковики легко находят дубли. Риск не оправдан.

Рабочая схема: парсим статьи-доноры с высокой экспертизой. Пропускаем через нейросеть с инструкцией «Перепиши текст, сохрани смысл». Инструменты – SpinRewriter или аналоги через API. Уникальность на выходе – 85-90%.

Почему рискованные источники убивают сеть?

К рискованным источникам относим копипаст, перевод через Google Translate, генерацию синонимайзерами. Такой контент поисковик определяет за 24 часа. Получаете фильтр по всему IP-блоку.

Фокус на семантику и релевантность дает долгосрочный результат. Вебмастер строит пассивный доход, а не тушит пожары банов.

Итог: ручной труд и десктопный софт проигрывают в скорости и цене. Облачная генерация закрывает вопрос масштабирования. Запускаете масс-пейдж, наполняете сеть под лонгтейл – трафик растет.

Какие тексты проходят проверку: параметры и метрики для незаметного контента

| Параметр | Старый метод (Ручной/Софт) | Наш метод (TextLog) |

|---|---|---|

| Уникальность | Непредсказуема, зависит от автора. Риск рерайта. | Гарантированный минимум 94% на новых моделях. |

| Релевантность | Долгая правка ТЗ, семантическое ядро вручную. | Автоматический разбор кластеров, LSI-подборка на лету. |

| Скорость | Дни на бирже, часы на парсинг и чистку. | Потоковая генерация: сотни материалов за час. |

| Безопасность | Следы копипаста, шаблонные конструкции. | Естественный синтаксис, переменные N-граммы, обход детекторов. |

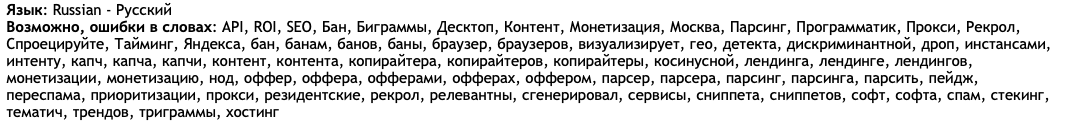

Какой уровень уникальности действительно безопасен для сети?

Цифра 90% – мнимая безопасность. Современные алгоритмы проверяют не только лексику, но и структуру. Незаметный контент требует 94% и выше с глубоким перестроением предложений. Рерайт синонимайзером больше не работает.

Генерация через топовые модели дает структурную уникальность. Каждая статья – новая комбинация паттернов, а не замена слов. Это ключ к созданию вечных ссылочных доноров.

Риск: Использование десктопного софта для спама оставляет цифровой отпечаток. Одинаковые ошибки, паттерны знаков препинания – маркер для фильтров. Ручной копирайтинг в масштабах сети съедает рекрол-бюджет.

Как добиться релевантности без глубокого погружения в тему?

Релевантность для PBN – это точное попадание в семантическое поле дроп-домена. Не нужно писать диссертацию.

Алгоритм анализирует историю домена, подбирает LSI-ядро из топовых страниц тематики. Генерация идет по готовым логическим блокам: проблема – решение – пример. Статья сохраняет смысловую целостность без экспертного уровня.

Кейс: Масштабирование Tier-1 сети на 500 доменов. Вместо найма 10 копирайтеров – запуск облачного пайплайна. Еженедельное наполнение по расписанию. ROI вырос на 40% за счет среза постоянных затрат.

- Автоматический контроль тональности под возраст и аудиторию домена.

- Внедрение биграм и триграм для естественности чтения.

- Динамическое изменение структуры абзацев между материалами.

- Проверка на переоптимизацию: равномерное вхождение ключей без спама.

Семантика строится вокруг вечных тем – они не устаревают, обеспечивают стабильный трафик. Программатик подход позволяет создавать тысячи страниц под лонгтейл, захватывая весь хвост запросов.

Итог: Параметры для проверки сместились от формальных метрик к комплексному анализу. Уникальность, релевантность, семантика – всё генерируется автоматически. Ручной труд и локальный софт проигрывают в скорости, качестве и цене.

Забудьте про Zennoposter, капчи и закупку прокси. Облако работает по принципу масс-пейдж: загрузил домены – получил контент. Сеть живет и растет без вашего ежедневного участия, генерируя пассивный доход.

Как избежать утечек и деанонимизации через стиль и семантику

Сеть PBN держится на изоляции. Один стилистический паттерн – цепочка доменов в бан. Алгоритмы ищут не только ссылочные графы, но и семантические отпечатки. Следы в тексте убивают анонимность быстрее плохих прокси.

Основная ошибка – ручной копирайтинг для всей сетки. Один автор, даже меняя слова, оставляет уникальный семантический каркас. Синонимайзеры и рерайт ломают структуру, но не меняют глубинные связи между терминами. Это детектируется.

| Старый метод | Риск деанонимизации | Наш метод |

|---|---|---|

| Заказ статей на биржах | Критический. Один авторский почерк на 20 сайтах. | Облачная генерация TextLog. Каждый текст – новый стиль. |

| Десктопный софт (X-Parser) | Высокий. Шаблонная структура, однородные предложения. | Динамическая модель, меняющая синтаксис и нарратив. |

| Ручной рерайт базовых статей | Средний. Сохраняется ядро LSI-запросов, порядок смыслов. | Генерация с нуля под каждый домен, разный углубленный охват темы. |

Как семантика выдает связь между сайтами?

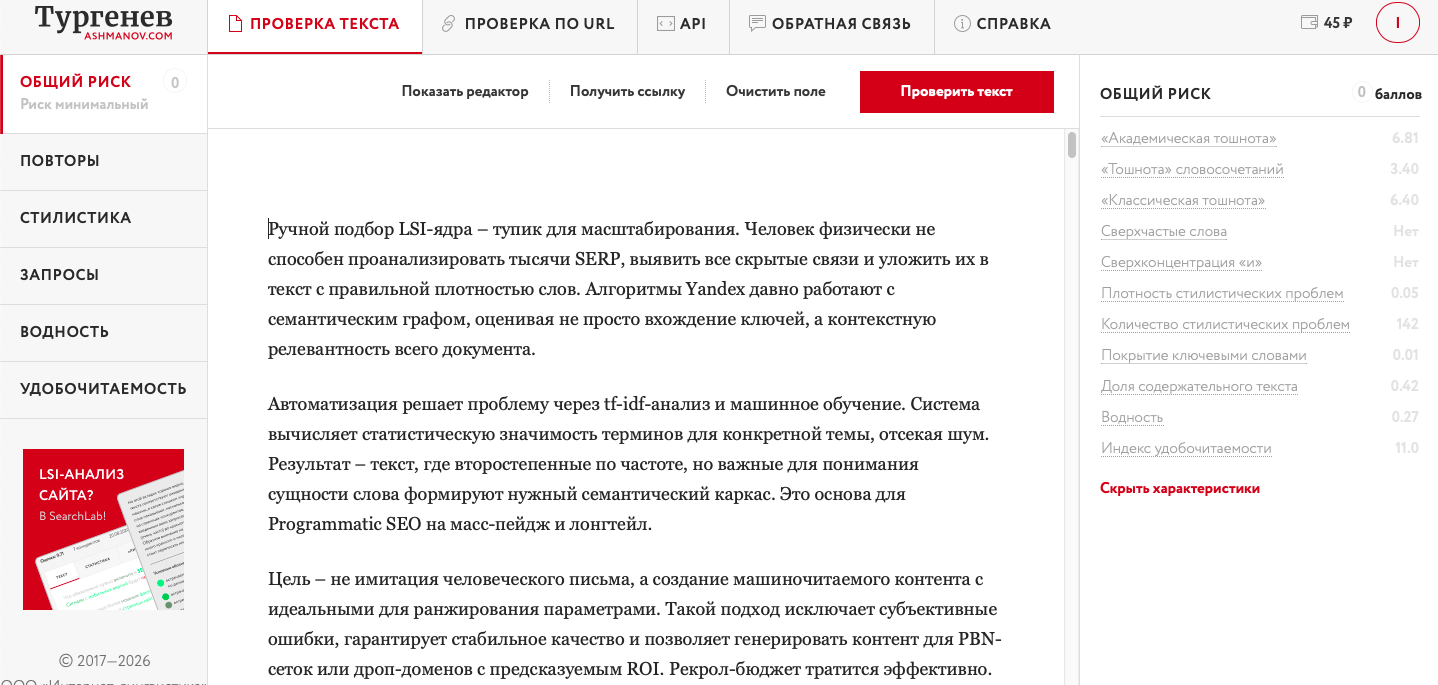

Не только прямое вхождение ключей. Алгоритмы Proxima анализируют: частоту служебных слов, среднюю длину предложения, структуру абзацев, распределение семантических ядер. Если на десяти сайтах одинаковое соотношение «вода/плотность» – это сигнал.

Использование одного списка «вечных» ссылок или шаблонных вставок (типа «в этой статье мы рассмотрели») создает цифровой отпечаток. Это утечка.

Какая оптимизация убивает сеть?

Слепая переоптимизация. Одинаковая плотность вхождения ключей, идентичные заголовки H2-H3, симметричные текстовые блоки. Релевантность должна достигаться разными путями: один сайт делает упор на сравнения, другой – на инструкции, третий – на аналитику.

Работающая стратегия: для каждого домена в сетке задается отдельный стилевой профиль и семантическое ядро с пересечением не более 15-20%. Это имитирует поведение независимых вебмастеров.

Уникальность текста – не только технический процент. Это уникальность смысловых связей. Программный копирайтинг через TextLog использует несколько независимых языковых моделей. Для каждого сайта – случайный выбор модели, что рвет стилистические мосты.

- Полная стилевая ротация между сайтами PBN.

- Генерация уникальных LSI-сеток для каждого домена.

- Контроль метрик: тональность, сложность текста, водность.

- Автоматическое различие в структуре статей (списки, таблицы, прогнозы).

- Имитация естественного роста контент-плана – без единовременных публикаций однотипных материалов.

SEO для PBN – это SEO наоборот. Нужно скрыть факт оптимизации. Релевантность достигается не прямой накруткой, а созданием правдоподобного, глубокого контента, который алгоритм сочтет авторитетным. Ручной труд здесь не масштабируется.

Итог: безопасность сети определяется самым слабым стилистическим звеном. Автоматизированная генерация с рандомизацией параметров – единственный метод для масштабирования до сотен сайтов без утечек. Рекрол-бюджет тратится на трафик, а не на исправление ошибок деанонимизации.

Рабочие форматы материалов под разные типы доменов в сети

Формат контента определяет выживаемость PBN-сетки. Ошибешься с типом материалов – получишь низкую релевантность, спад трафика и слитый бюджет. Вечные домены требуют вечных форматов, а дроп-проекты живут по другим законам.

| Тип домена / Цель | Старый метод (Ручной/Софт) | Наш метод (Облачная генерация) |

|---|---|---|

| Авторитетные Tier-1 (Money Sites) | Дорогие LSI-статьи от копирайтеров. Долгий цикл, срывы сроков. | Программные семантические ядра, глубокая релевантность. Контент генерируется за минуты. |

| Буферные сайты сети (Tier-2) | Рерайт биржевых текстов. Низкая уникальность, риск фильтров. | Масс-пейдж генерация под лонгтейл. Полная оптимизация под ключи. |

| Экспиренс-дропы (Трафик/Арбитраж) | Копипаст или синонимайзинг. Нулевая ценность, нет пассивного дохода. | Структурированные дата-статьи, обзоры. Автоматическое обновление. |

Какой формат статей выбрать для вечных доменов?

Для долгоживущих проектов в сети забудь про короткие новости. Нужны форматы с длительным циклом жизни: подробные гайды, сравнения, инструкции с пошаговыми блоками. Глубина проработки семантики здесь критична. Каждая статья должна закрывать кластер запросов, а не один ключ.

Формат-пример для Tier-1: «Полный гид по настройке Zennoposter: от шаблонов до прокси». Объем – от 5К знаков, структура с подзаголовками H3-H4, LSI-вкрапления, блоки «Проблема-Решение».

Чем наполнять буферные сайты для максимального эффекта?

Здесь работает логика объема и скорости. Оптимальный формат – массовые страницы под низкочастотные хвосты. Не статьи в классическом понимании, а структурированные текстовые модули (300-500 знаков) с четким ответом на запрос. Релевантность достигается за счет точного попадания в семантическое ядро, а не художественного копирайтинга.

- Вопрос-ответ (FAQ-блоки) для захвата маркетплейс-запросов.

- Краткие обзоры товаров с техническими характеристиками.

- Локализированные страницы («Услуги + город»).

Главная ошибка – унификация. Нельзя лить один тип текстов на все домены сети. Дроп-домен под арбитраж трафика и вечной авторитетный проект требуют принципиально разных материалов по структуре, объему и глубине оптимизации.

Как добиться высокой уникальности без ручного труда?

Уникальность – технический параметр, а не признак качества. Ее обеспечивает не копирайтинг, а алгоритмическая генерация на новейших языковых моделях. Задача – не переписать текст, а создать новый на основе заданных данных и семантических правил. Это исключает дубли внутри PBN-сетки и риски внешних совпадений.

Итог: Стратегия наполнения строится от типа домена. Money sites – глубокая семантика и экспертные форматы. Буферные сайты сети – массовая релевантная генерация под хвосты. Автоматизация форматов через облако снимает проблему скорости, качества и бюджета.

Выбери формат, задай параметры, запусти генерацию. Масштабирование PBN перестает быть рутиной.

Масштабирование потока: от ручной сборки до автоматизированной подачи

Ручной копирайтинг для сетьи PBN – тупик для масштабирования. Стоимость одной статьи с требуемой уникальностью и релевантностью съедает ROI. Автоматизация – не опция, а необходимость.

| Параметр | Старый метод (Ручной/Zennoposter) | Наш метод (TextLog) |

|---|---|---|

| Стоимость 1000 знаков | от 150₽ (биржи) / 500₽ (профи) | от 5₽ |

| Скорость генерации | 1-2 статьи в день / зависит от шаблонов и таймингов | Потоковая подача, ограничена только вашим аппетитом |

| Затраты на инфраструктуру | Прокси, мощное железо, софт, капча-сервисы | Нулевые. Облако. |

| Глубина семантикаи | Зависит от навыков копирайтера/сложности шаблона | Автоматическое LSI-наполнение, кластеризация по ядрам |

| Риск санкций | Высокий (шаблонный спам, низкая уникальность) | Минимальный (нейросетевые модели, динамические структуры) |

- Снижение стоимости контента в 30+ раз.

- Переход от ограниченного числа проектов к управлению вечныеми PBN-сетками любого размера.

- Полная ликвидация рутины: найма, контроля, оплаты исполнителей.

- Фокус на стратегии и анализе, а не на производственном процессе.

Как внедрить автоматизацию без потери качества?

Ключ – не в слепой генерации, а в программировании контент-стратегии. Сначала собираем семантическое ядро для дроп-домена или money site. Загружаем его в систему. Алгоритм строит структуру будущих статьи: заголовки H2-H4, распределение ключей, LSI-запросы.

Качество определяет не человек, а строгие параметры: процент уникальности (от 95%), тональность, плотность ключей, запрещённые слова. Генерация идёт до достижения заданных метрик.

Что делать с готовым контентом для Tier-1?

Полученный массив статей автоматически дистрибутируется по сайтам сетьи через API. Интеграция с CMS (WordPress, MODX) позволяет настроить пост-публикацию: установку Featured Image, добавление в категории, назначение меток. Вы получаете готовый к индексации проект.

Главная ошибка – экономия на семантике. Автоматизация усиливает, а не исправляет. Мусорное ядро на входе даст поток низкокачественного текста на выходе. Инвестируйте время в сбор и чистку запросов.

Кейс: арбитражник масштабировал PBN с 50 до 400 сайтов за 3 месяца. Рекрол-бюджет с текстов упал с 70 000₽ до 8 000₽ в месяц. Пассивный доход с Tier-1 вырос в 5 раз за счёт скорости закрытия новых ниш.

Масштабирование потока контента сводится к простой формуле: ваша экспертиза в seo + наша технология в генерации. Вы управляете стратегией, система – исполнением.

VIP-доступ: Интеграция с вашим парком дроп-доменов. Автоматический парсинг и категоризация статей под тематику каждого домена. Priority-очередь генерации.

Вопрос-ответ:

Какие есть легальные источники контента для PBN, кроме копирайтинга на заказ?

Помимо заказа текстов у копирайтеров, можно использовать несколько проверенных источников. Первый — рерайт качественных чужих статей с глубокой переработкой, добавлением своей структуры и примеров. Второй — перевод статей с авторитетных иностранных сайтов по вашей теме, что даёт уникальный для рунета материал. Третий — покупка прав на перепубликацию (лицензия) готовых статей у специализированных бирж контента или блогеров. Четвёртый вариант — создание собственного контента силами разных авторов внутри сети, чтобы у каждого сайта был свой стиль. Главное правило для любого источника — итоговый текст должен быть уникальным, полезным и естественным, а не просто формально изменённым.

Как часто нужно обновлять контент на сайтах PBN?

Чёткого графика нет, но стратегия должна имитировать поведение реального сайта. Не стоит публиковать по 10 статей в день, а потом месяц ничего не делать. Лучше определить реалистичную периодичность, например, 2-4 публикации в месяц для каждого сайта сети. Важнее регулярность, чем объём. Также полезно иногда возвращаться к старым материалам, чтобы актуализировать данные или добавить новую информацию. Это показывает, что сайт «живой». Полное отсутствие обновлений более 3-4 месяцев может быть негативным сигналом.

Можно ли использовать один и тот же контент на разных сайтах PBN, если его немного переписать?

Нет, это одна из самых серьёзных ошибок. Даже сильно переписанный (рерайт) один исходный текст, размещённый на нескольких сайтах сети, создаёт риск. Поисковые системы могут найти смысловые дубликаты и связать сайты между собой. Каждый сайт в PBN должен иметь абсолютно уникальный контент с разной структурой, примерами и углом рассмотрения темы. Использование одного шаблона для десятков статей с заменой синонимов также легко выявляется. Это прямая угроза обнаружению всей сети.

Какой объём текста нужен для страниц PBN? Достаточно ли 2-3 тысяч символов?

Объём вторичен. Пытаться подогнать все статьи под один стандарт, например, 5 тысяч знаков, — ошибка. Контент должен соответствовать цели страницы и выглядеть естественно. Для описания услуги может хватить 1500-2000 знаков, а для обзорной статьи — 8-10 тысяч. Главные критерии — полнота раскрытия вопроса и польза для условного читателя. Текст ради текста, «вода» и искусственное увеличение объёма легко распознаются и снижают trust (доверие) к сайту. Лучше короткий, но содержательный материал, чем длинный и бессмысленный.

Что делать, если нет бюджета на дорогой контент для большого количества сайтов?

При ограниченном бюджете лучше создать меньше сайтов, но обеспечить их качественными материалами, чем много пустых ресурсов. Можно комбинировать источники: часть ключевых статей заказать у недорогих, но проверенных копирайтеров, а часть создать самостоятельно, используя экспертность. Ещё один способ — начать с минимального наполнения (5-7 хороших статей на каждый сайт) и постепенно, по мере возможности, добавлять новые материалы. Это безопаснее, чем массовое заполнение дешёвым, спамным контентом, которое почти гарантированно приведёт к проблемам.

Какие есть практичные способы найти тексты для наполнения сети сайтов, если бюджет ограничен?

При ограниченном бюджете можно использовать несколько подходов. Первый — рерайт существующих качественных текстов с других авторитетных ресурсов по вашей теме. Важно не копировать, а глубоко перерабатывать материал, добавляя свою структуру и примеры. Второй способ — использование бирж копирайтинга с фильтрацией по низкой стоимости заказа. Однако здесь требуется тщательная проверка качества, так как дешевые тексты часто бывают низкосортными. Третий вариант — самостоятельное написание, если вы хорошо разбираетесь в теме. Это самый безопасный, но и самый трудозатратный метод. Также можно рассмотреть обмен контентом с другими владельцами проектов на взаимовыгодных условиях.

Хочешь купить статьи дешево для сайта и блога? Перейти в магазин статей

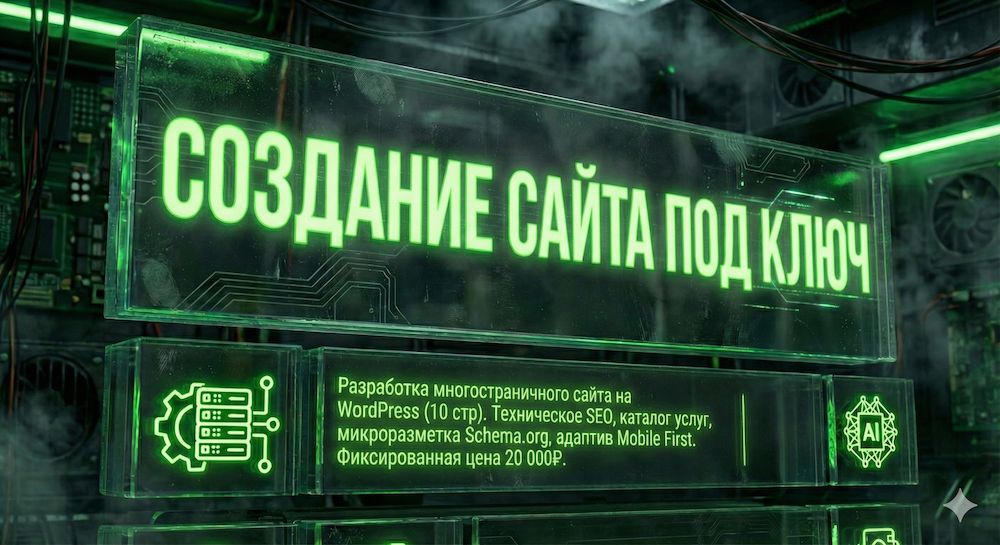

Нужен современный сайт или лендинг? Заказать создание сайта

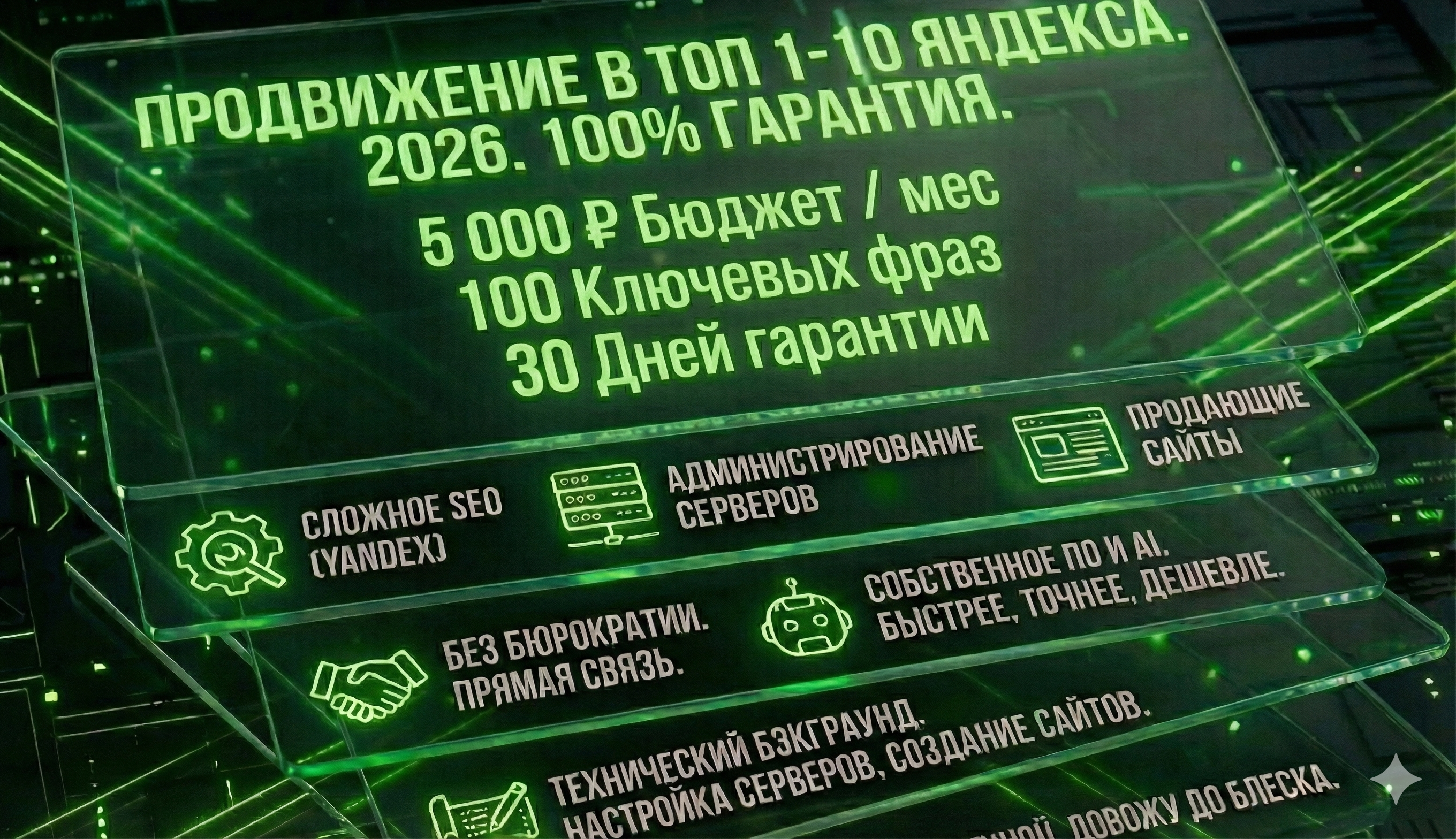

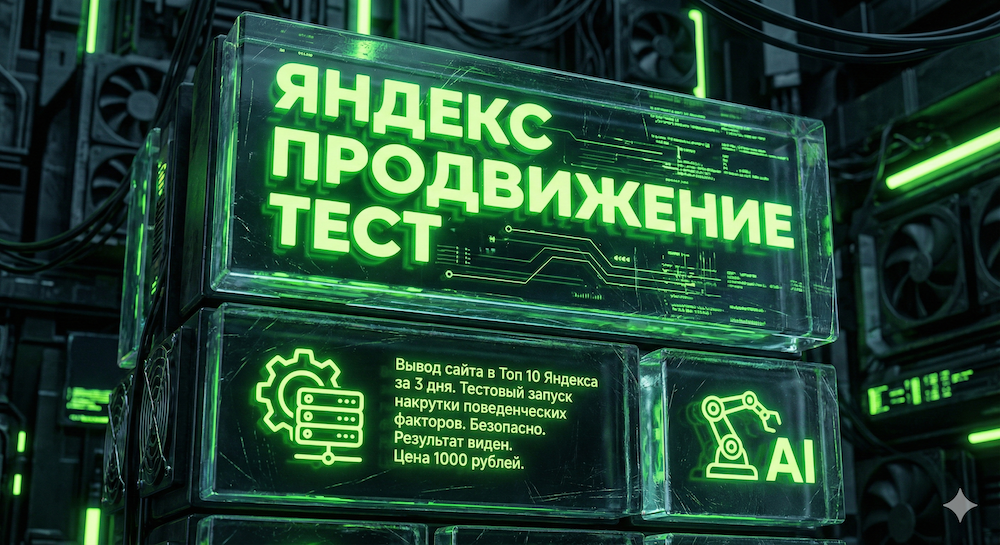

Сайт не видно в поиске? Продвинуть сайт в ТОП Яндекс