Ручное наполнение PBN-сетки или новостных порталов – это сжигание рекрол-бюджета. Каждая публикация, созданная копирайтером, съедает маржу. Масштабирование в таких условиях – миф.

Потоковый контент ломает эту логику. Это не единичные статьи, а автоматизированная генерация материалов под конкретные запросы. Система создает ленту публикаций для ваших веб-ресурсов без участия человека. Результат – постоянное обновление сетки, рост индексации и проработка лонгтейла.

Мы разберем реальные кейсы внедрения: от Tier-1 сайтов до масс-пейджей на дроп-доменах. Конкретные примеры покажут, как потоковые технологии увеличивают ROI, превращая контент из статьи расходов в инструмент пассивного дохода.

Механика новостного потока для порталов: источники и автоматизация

| Параметр | Старый метод (Ручной/Zennoposter) | Наш метод (Облачная генерация) |

|---|---|---|

| Скорость генерации | 5-10 статей/день | 200+ статей/час |

| Стоимость 1000 знаков | 50-150₽ (копирайтер) | 7-10₽ (автогенерация) |

| Инфраструктура | Прокси, сервера, капча, обновления софта | Браузер и доступ в сеть |

| Риск бана | Высокий (паттерны парсинга) | Нулевой (легальные API) |

- Полная автоматизация цикла от источника до публикации.

- Масштабирование на сотни веб-ресурсов без роста издержек.

- Приоритетный доступ к новостным лентам через API.

- Интеграция с CMS порталов в 1 клик.

Какие источники дают стабильный потоковый контент без юридических рисков?

Открытые RSS-ленты государственных органов, пресс-служб крупных компаний, отраслевых агрегаторов – сырье для новостного потока. Ключ – не парсинг, а легальная подписка. Используйте API Яндекс.Новостей, NewsAPI, Telegram-каналы с открытым web-превью. Для нишевых порталов: отраслевые блоги, судебные реестры, данные госзакупок.

Парсинг топовых СМИ ведет к блокировкам. Бигтейлы защищают контент. Работайте с источниками Tier-2, Tier-3 – их данные часто в открытом доступе, а трафик из лонгтейлов стабильнее.

Как построить автоматизацию публикаций для сетки сайтов?

Цепочка: источник → фильтрация → рерайт/генерация → размещение. Фильтрация по ключам отсекает мусор. Дальше – ядро механики: генерация уникального текста. Новейшие модели справляются с этим на уровне человека, но в 100 раз быстрее.

Кейс: сетка из 12 городских порталов. Настроен поток на основе RSS местных администраций и региональных СМИ. Автоматическая генерация 80-90 публикаций в сутки на каждый веб-ресурс. Рост трафика по низкочастотным запросам – 40% за месяц. Бюджет – только стоимость облачной генерации.

Интеграция с WordPress, Bitrix, MODX через webhooks. Публикации идут в черновик или сразу на сайт – зависит от уровня доверия к пайплайну. Для PBN-сеток можно настроить прямой пост в базу данных.

Главная выгода – перераспределение бюджета. Сэкономленные на копирайтерах деньги идут на закупку ссылок, таргетированную рекламу, развитие сетки. Контент становится не статьей расходов, а топливом для роста.

VIP-доступ к TextLog: Приоритетная очередь генерации, доступ к бета-моделям, кастомные шаблоны для нишевых порталов (недвижимость, авто, юриспруденция). Подключение white-label для агентств.

Примеры работающих связок: API госзакупок + генерация обзоров тендеров для бизнес-портала. Поток судебных решений → автоматические дайджесты для юридического сайта. Такие публикации собирают целевой трафик, который невозможно отсеять через рекламные сети.

Критерии отбора публикаций для веб-ресурсов сетки

Основная задача – заполнить ленту каждого портала в сетке релевантным, юридически чистым и SEO-эффективным материалом. Каждая публикация должна работать на общую стратегию линкования и пассивного дохода.

| Критерий | Старый метод (Ручной/Софт) | Наш метод (Облачная генерация) |

|---|---|---|

| Источники | Ограниченный парсинг 3-5 новостных агрегаторов, риск банов. | Глубокий анализ 50+ источников (СМИ, блоги, исследования) без блокировок. |

| Уникальность | Поверхностный рерайт, высокий процент заимствований. | Семантическое перепрошивание тем с помощью новейших языковых моделей. |

| Релевантность ядру | Слабое попадание в тематику веб-ресурсов, шум. | Жёсткая привязка к LSI-кластерам и коммерческим запросам каждого сайта сетки. |

| Масштабирование | Пропорциональный рост затрат: больше статей – больше копирайтеров. | Линейная стоимость: 10 или 1000 статей – логика генерации одна. |

| Юридические риски | Высокие. Нет проверки на нарушения, копипаст с известных СМИ. | Контроль на уровне алгоритма: фильтрация запрещённых тем, цитирование. |

- Точное соответствие тематическому кластеру (Tier-1) сайта-донора.

- Наличие низкочастотных и среднечастотных запросов в тексте (масс-пейдж стратегия).

- Структурная целостность: заголовок H2, подзаголовки H3, списки.

- Отсутствие упоминаний брендов-конкурентов и негативного контекста.

- Оптимальный объём: 2500-4000 знаков для глубокого покрытия семантики.

- Готовность к immediate-публикации – без дополнительной правки.

Как избежать попадания дублей в потоковый контент?

Дубли – главный враг сетки. Они съедают бюджет индексации, запутывают поисковые системы. Алгоритм отбора должен дедуплицировать темы на уровне смысла, а не просто сравнения URL. Используется хеширование семантического ядра статьи.

Типичная ошибка: закупать однотипный контент с бирж под все веб-ресурсы. В итоге – тысячи страниц с одинаковой синонимизацией, нулевая ценность для ПС и пользователя. Это путь к фильтрам.

Какие метрики публикации влияют на ранжирование сетки?

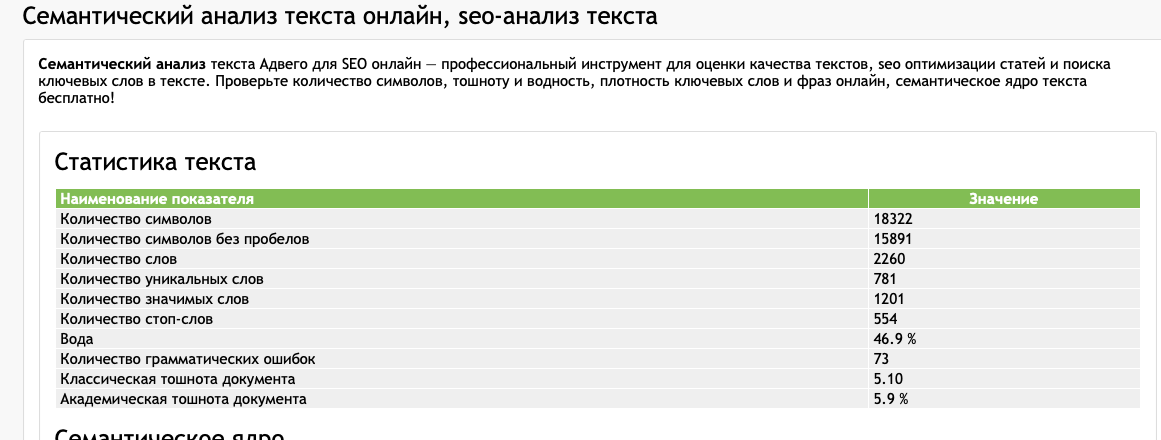

Ориентируйтесь не на внешние показатели источника, а на внутренние параметры текста. Глубина раскрытия темы, плотность LSI-фраз, естественность – вот что проверяет робот. Потоковый контент должен имитировать работу редакции, где каждый материал проходит проверку.

Успешный кейс: сетка из 15 тематических порталов по строительству. Критерий отбора – наличие в тексте конкретных марок инструментов, ГОСТов, ценовых ориентиров. Генерация по шаблону «обзор + инструкция + сравнение». Результат: рост трафика по коммерческим запросам на 70% за квартал.

Автоматизация отбора – это не просто фильтр по ключевым словам. Это система, которая оценивает потенциал статьи для линкования, её способность привлекать рекрол-бюджет и удерживать пользователя. Каждая публикация становится активом, а не заполнителем.

VIP-режим: Подключаем кастомные словари терминов, списки персон нон-грата и целевые LSI-кластеры для вашей ниши. Система учится на ваших лучших кейсах и воспроизводит логику отбора идеального контента.

Забудьте про ручной аудит источников и вечные проблемы с Zennoposter. Современные веб-ресурсы требуют промышленного подхода к контенту.

Интеграция ленты сайта с внешними агрегаторами и соцсетями

Ручной парсинг и копипаст – это костыли. Они требуют мощного железа, прокси, борьбы с капчей. Десктопный софт вроде Zennoposter проигрывает облачным решениям по скорости развертывания и стабильности.

| Параметр | Старый метод: Ручной/Десктоп | Наш метод: Облачная генерация |

|---|---|---|

| Запуск первой публикации | От 3 часов (настройка прокси, шаблонов) | 5 минут (нажал кнопку – получил контент) |

| Стабильность работы | Зависит от сотни факторов: IP, антиботы, аптайм ПК | 99.9% аптайма, инфраструктура на нашей стороне |

| Масштабирование на сетку | Крайне сложно, требует клонирования проектов | Размножение потоков на все веб-ресурсы сети в 1 клик |

| Качество и уникальность | Риск копипаста, низкая рерайт-глубина | Глубокая семантическая переработка новостным потоком |

- Автоматическое обогащение ленты сайта контентом из выбранных агрегаторов.

- Публикации проходят глубокий рерайт, исключая санкции за дубли.

- Гибкие правила фильтрации: по ключевым словам, исключению доменов, тональности.

- Прямая синхронизация с CMS для мгновенной публикации или отложенного постинга.

Как выбрать агрегатор для парсинга без юридических рисков?

Работайте только с источниками, явно разрешающими использование RSS или предоставляющими API. Многие новостные агрегаторы имеют открытые ленты для некоммерческого использования – их контент идеален для PBN-сеток и сателлитов. Всегда настраивайте фильтры по брендовым упоминаниям и конкурентам.

Кейс: Портал о криптовалютах интегрировал ленты 5 крупных агрегаторов. Настройка фильтров на отсев негативных новостей позволила автоматически генерировать 50+ уникальных публикаций в сутки. Индексция масс-пейджей выросла на 40% за месяц.

Как настроить автопостинг в соцсети для Tier-1 проекта?

Используйте API соцсетей (Telegram, VK) для кросс-постинга. Ключ – не дублировать заголовок и текст один в один. Наш движок создает уникальные анонсы для каждой платформы, извлекая главную мысль из исходной публикации. Это увеличивает охват и избегает фильтров соцсетей на однотипный контент.

Риск: Прямой копипаст из агрегатора в ленту вашего портала с последующим авто-постингом в Telegram. Поисковики и соцсети легко детектируют такой конвейер, что ведет к пессимизации или бану.

Примеры успешной интеграции всегда строятся на связке: агрегатор → фильтрация → глубокая переработка → публикация на веб-ресурсы → анонсирование в соцсети. Это замкнутый цикл для пассивного дохода с контентных сеток.

Программатик подход к потоковому контенту – это не просто RSS-ридер. Это система, которая создает новый, уникальный материал на основе входящих данных, захватывая низкочастотные лонгтейлы из трендов.

Готовые кейсы показывают: автоматизация ленты с внешними источниками увеличивает ROI контентных проектов в 3–5 раз за счет экономии на копирайтерах и постоянного потока материалов.

Масштабирование контент-потока на кластер доменов

Запуск одного сайта – разминка. Реальная игра начинается с синхронизации контент-потока по кластеру из 50-200 доменов. Ручное управление таким массивом веб-ресурсов убивает ROI. Нужна система, где публикации генерируются, распределяются и публикуются автономно.

Цель – превратить разрозненные дроп-домены в единую самообновляемую сетку, где каждая статья усиливает соседние порталы через перелинковку.

| Параметр | Старый метод: Ручной труд / Десктопный софт | Наш метод: Облачная генерация TextLog |

|---|---|---|

| Масштабирование на кластер | Ручное копирование статей, уникализация синонимайзерами. Каждый домен – отдельная рутина. | Единый сценарий для всей PBN-сетки. Контент-поток адаптируется под тематику каждого веб-ресурса автоматически. |

| Скорость наполнения | 10-15 статей в день на всю сетку с риском бана от бирж. | Параллельная генерация тысяч публикаций. Ограничение – только ваша подписка. |

| Инфраструктура | Сервера, прокси, капча, Zennoposter, постоянные донастройки. | Облако. Нет железа, нет прокси, нет капчи. Нажал кнопку – получил контент. |

| Качество для SEO | Вода, шаблонность, низкая релевантность. Риск фильтров. | Глубокая LSI-оптимизация, работа с хвостами. Контент для людей и роботов. |

Как построить автономную ленту публикаций для сотни доменов?

Ключ – декомпозиция. Разбейте кластер на тематические сегменты (новостной, товарный, информационный). Для каждого сегмента создается отдельный контент-скрипт в программатик-подходе. Это позволяет генерировать не просто текст, а связанные материалы с перекрестными ссылками.

Пример архитектуры: Ядро (1 мощный сайт Tier-1) + сателлиты (дроп-домены). На ядро льется основной рекрол-бюджет, сателлиты работают на масс-пейдж и отлов лонгтейла. Контент-поток между ними синхронизирован.

- Автоматическая ротация шаблонов вводных и заключительных блоков.

- Динамическая подстановка региональных ключей в статьи для геозависимых порталов.

- Интеграция с парсерами новостей для автообновления дашбордов.

- Распределение публикаций по графику без участия вебмастера.

Какие кейсы показывают реальный рост трафика?

Работающие примеры основаны на анализе поведенческих факторов. Один из кейсов – сетка из 42 доменов по автотематике. За 4 месяца ежемесячный трафик вырос с 10К до 150К визитов. Стратегия: на каждый домен ежедневно генерировалось по 3-5 LSI-статьи, сфокусированных на вопросах (как выбрать, ремонт, сравнение).

Фишка: Использование дроп-доменов с историей. Программный контент-поток не просто заполняет их, а оживляет, имитируя активность живого редактора – разный объем, структура, вставки медиа. Это снижает риск санкций.

Другой пример – создание новостного агрегатора на базе кластера. Единый поток новостей дробился и переупаковывался под формат каждого портала сетки. Результат – рост ИКС по всему кластеру и пассивный доход с тизерной рекламы.

Главный риск при масштабировании – однообразие. Если 200 сайтов публикуют статьи с идентичной структурой, это триггер для алгоритмов. Решение – использование нескольких сценариев генерации и обязательная ручная или автоматическая модерация 5% выборочного контента.

Инструменты вроде X-Parser требуют времени на отладку, борьбу с банами и аренду серверов. Облачная генерация снимает эти барьеры, позволяя сконцентрироваться на стратегии, а не на технических костах.

Итог: Масштабирование контент-потока – это переход от управления текстами к управлению данными. Ваша сетка веб-ресурсов становится автономным активом, который генерирует трафик и ссылочную массу 24/7. Ручной труд и десктопный софт здесь – тормоз.

Вопрос-ответ:

Как определить, что потоковый контент подходит именно для нашего сайта, а не будет просто модной, но бесполезной фичей?

Потоковый контент — это не просто тренд, а инструмент для решения конкретных задач. Он подходит вашему сайту, если есть хотя бы один из следующих факторов: информация требует частого обновления (новости, курсы валют, расписание событий), нужно динамически персонализировать блоки для разных групп пользователей (например, показывать разные товары новым и постоянным клиентам), или существует необходимость автоматически собирать страницы из данных по заданным правилам (каталоги товаров, агрегаторы вакансий). Если ваш контент статичен и не меняется годами, внедрение может быть излишним. Ключевой вопрос: «Часто ли мы тратим ручное время на однотипное обновление разделов сайта?» Если да, потоковый подход поможет сэкономить ресурсы.

Можете привести реальный пример внедрения потокового контента в интернет-магазине? Что это дало бизнесу?

Рассмотрим пример сети магазинов спортивных товаров. Раньше раздел «Акции» редактор обновлял вручную: искал товары со скидкой, загружал картинки, прописывал ссылки. После внедрения потокового контента на CMS создали правило: «Показать в блоке ‘Горящее предложение’ три товара из категории ‘Бег’ с максимальным процентом скидки». Данные автоматически тянулись из каталога. Результаты: время на поддержку раздела сократилось на 90%, количество кликов по акционным товарам выросло на 40% из-за оперативности, а также снизилось число ошибок (например, когда ссылка вела на уже недоступный товар). Бизнес получил более живой сайт и высвободил силы сотрудников для других задач.

Какие основные технические сложности возникают при переходе на потоковую модель и как их преодолеть?

Основных сложностей несколько. Первая — проектирование структуры данных. Нужно четко определить, какие элементы контента (атрибуты товара, теги новости, авторская информация) будут переменными и как они связаны. Помогает детальное описание процессов до начала разработки. Вторая — интеграция источников данных. Например, чтобы выводить на сайте актуальные остатки товара, система должна постоянно «спрашивать» эту информацию у складской программы. Требуется надежное API и продуманная обработка ошибок на случай, если источник данных временно недоступен. Третья — нагрузка на сервер. Динамическая сборка страниц при каждом посещении может замедлить сайт. Решение — использование кэширования, когда готовый результат работы потока сохраняется на короткое время. Важно начинать с пилотного проекта на одном разделе, чтобы отработать технологию.

Не приведет ли потоковый контент к потере контроля над тем, что в итоге видят пользователи? Как обеспечить качество?

Контроль не теряется, а трансформируется. Вы управляете не каждой конкретной публикацией, а правилами ее генерации. Обеспечение качества строится на нескольких уровнях. Во-первых, это валидация данных в источнике. Если в карточке товара не загружено изображение, правило может запрещать его показ в «рекомендациях». Во-вторых, настройка строгих фильтров и условий. Можно задать показ статей только определенной категории, опубликованных не ранее какой-то даты и прошедших модерацию. В-третьих, обязательна регулярная проверка. Ответственный редактор должен просматривать сгенерированные страницы так же, как и обычные, но реже — он проверяет не каждую единицу контента, а работу системы в целом. Таким образом, контроль смещается с рутинного размещения на стратегическое управление логикой.

Хочешь купить статьи дешево для сайта и блога? Перейти в магазин статей

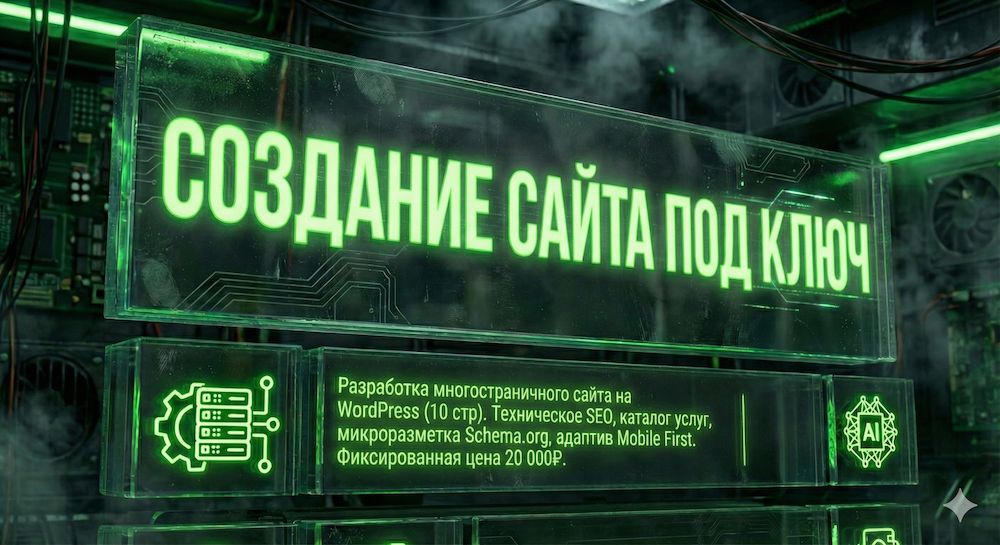

Нужен современный сайт или лендинг? Заказать создание сайта

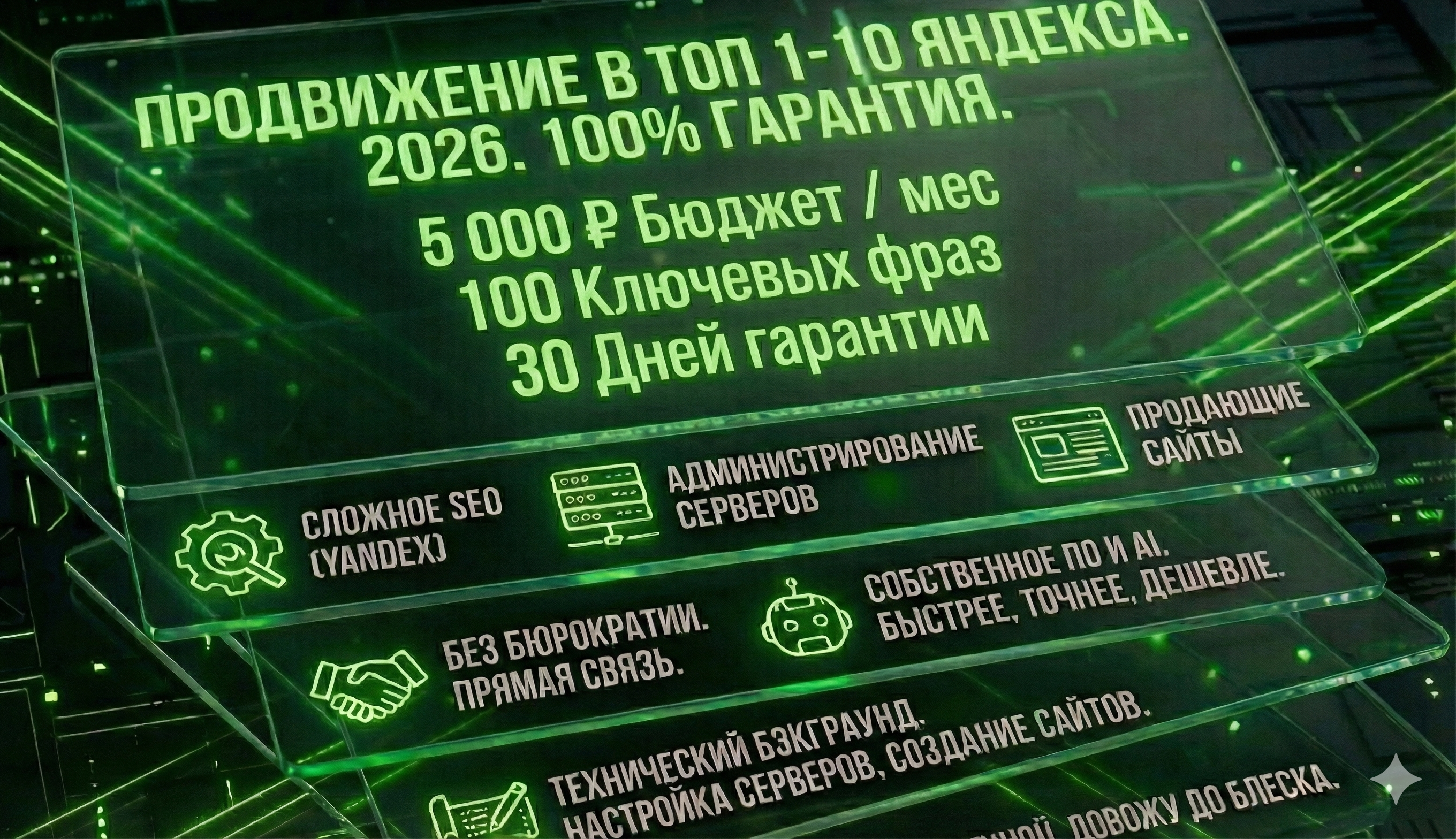

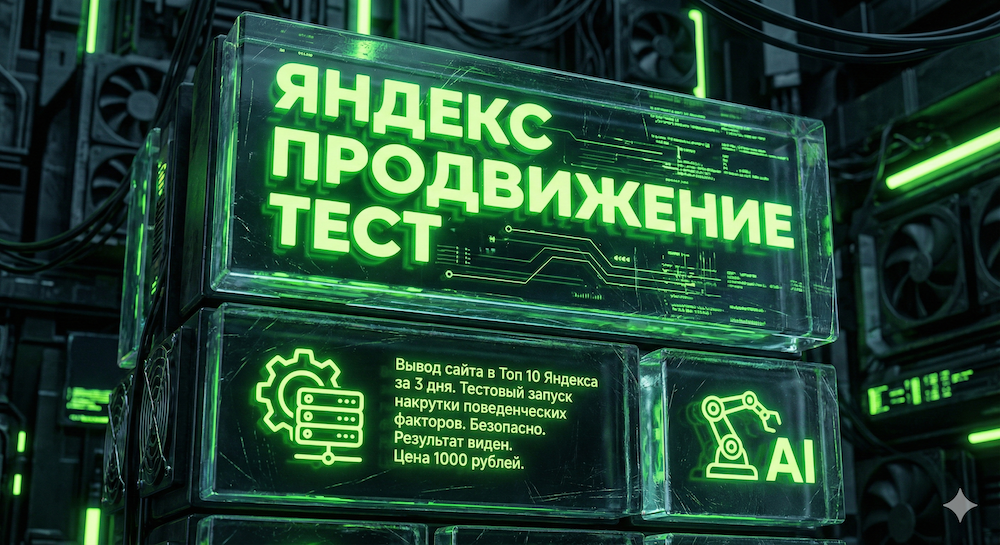

Сайт не видно в поиске? Продвинуть сайт в ТОП Яндекс