Контент для PBN – это не публикация ради публикации. Каждая статья в сети ссылочных сайтов решает техническую задачу: повысить вес донора для последующей перелинковки. Уникальность здесь – не абстрактный показатель, а обязательное условие выживания проекта. Стандартный рерайт или синонимайзинг биржевого уровня давно детектируются алгоритмами.

Для вебмастеров, строящих сетки, вопрос оптимизации затрат на контент стоит остро. Ручной копирайтинг под каждую площадку съедает рекрол-бюджет и не масштабируется. Глубокий рерайт требует времени. Решение – автоматизированная генерация, но не через десктопный софт, который создает проблемы с капчей и прокси.

Правильный текст для PBN должен имитировать рукописный материал, но создаваться массово. Его основа – LSI-ядро и релевантные вставки, которые убеждают не только поискового робота, но и потенциального модератора вручную. Это баланс между качеством и стоимостью, где цена одной статьи определяет ROI всей сетки.

Ссылки с таких площадок должны выглядеть естественно. Поэтому контент не может быть откровенной водой – требуется смысловая нагрузка, структура, хотя бы минимальная полезность. Задача – закрыть потребность сайта-донора в наполнении, чтобы он мог ранжироваться по своим низкочастотным запросам и наращивать статический вес.

Критерии отбора контента для PBN: что поисковики считают «естественным»

Почему простой рерайт первого абзаца больше не работает?

Алгоритмы определяют поверхностный рерайт по низкой плотности LSI-фраз и шаблонной структуре. Текст должен решать задачу пользователя: отвечать на вопрос, давать инструкцию, предоставлять обзор. Публикация ради публикации – верный путь к фильтру.

Критическая ошибка: использование одного шаблона для всех сайтов в сетке. Для условного «блога о ремонте» и «медицинского портала» должны радикально отличаться стиль, терминология и глубина проработки тем.

Ключевой параметр – уникальность. Проверка на стандартных биржах недостаточна. Нужен анализ на заимствования из нетоповых источников, которые также могут быть в индексе. Глубокий рерайт с перестройкой нарратива и добавлением экспертных блоков предпочтительнее.

Как вписать анкоры в текст, чтобы это не выглядело спамом?

Оптимизация под ключи должна быть контекстной. Анкор интегрируется в предложение как его логическая часть, а не вставка в скобках. Плотность: не более одного ключа на 700-1000 символов. Основной объем – это нейтральный, полезный контент, который удерживает внимание.

Рабочая схема: 80% текста – полезная информация по теме сайта (обзоры, мнения, инструкции). 20% – зона для аккуратного размещения ссылочной массы. Это создает естественный баланс и снижает риски.

Публикация должна имитировать поведение реального сайта. Это значит: разный объем постов (от 500 до 3000 символов), наличие мультимедиа (изображения с уникальными описаниями), структурирование через подзаголовки (H2-H3). Однотипные портянки текста – маркер для алгоритмов.

Для PBN не подходит дешевый копирайтинг с бирж. Нужен контент, который проходит проверку на «вдумчивое чтение». Это не обязательно дорого: можно использовать программатик-подход с глубокой семантической обработкой шаблонов.

Итог: поисковики считают естественным сайт с последовательной тематикой, ценным для гипотетического посетителя контентом и ненавязчивой коммерческой составляющей. Задача – не просто заполнить домены текстом, а создать правдоподобные веб-ресурсы.

Типичные провалы: почему статьи для сателлитов попадают под фильтры

Фильтры поисковых систем – прямой результат ошибок в стратегии. PBN-сеть не прощает хаоса. Разберем системные сбои, которые сливают бюджеты вебмастерам.

Как анкоры выдают сеть из 50 доменов?

Классическая ошибка – использование одного списка ключей для всех сайтов в сети. Публикация статей с идентичными анкорами создает четкий паттерн для алгоритмов. Система видит неестественную перелинковку и накладывает санкции на все домены разом.

Риск: Ручное распределение анкоров по сайтам не масштабируется. При росте сети до 100+ сателлитов контроль теряется, появляются дубли, которые фиксируют поисковые роботы.

Почему техническая уникальность текста не работает?

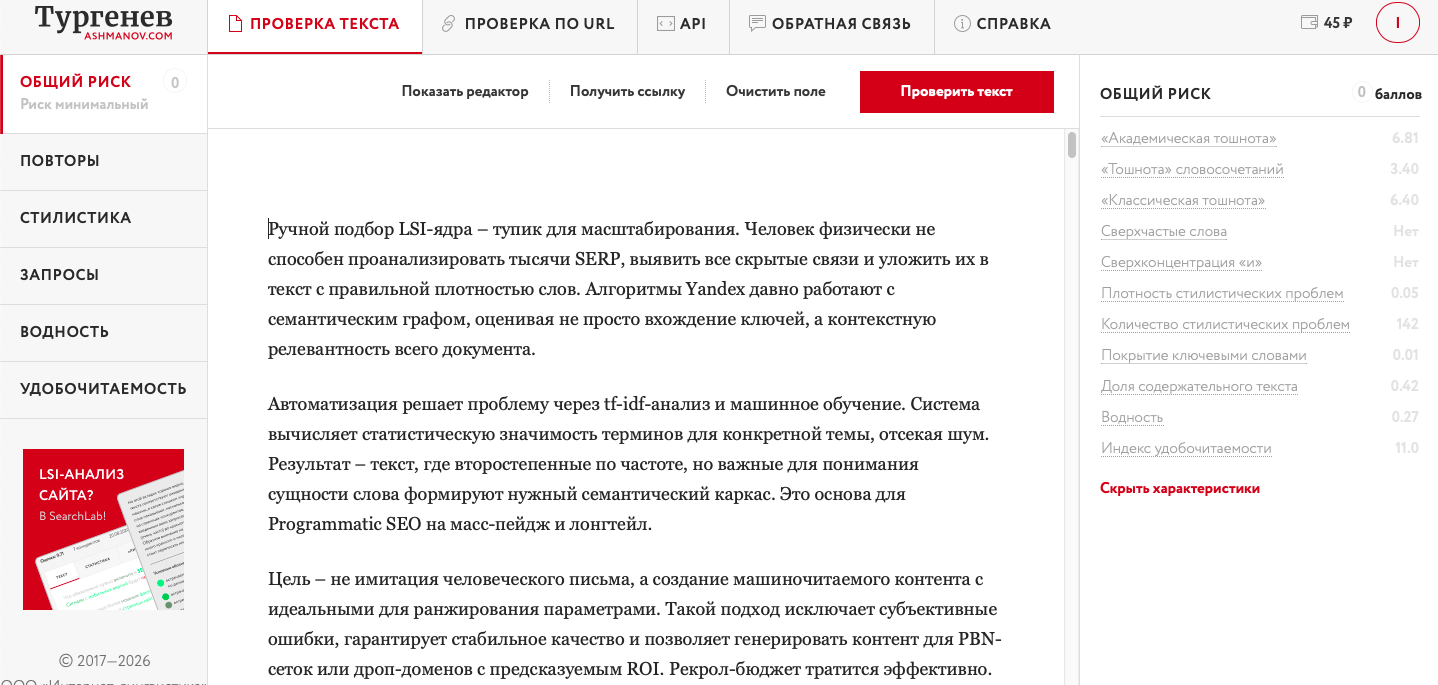

Многие вебмастера полагаются на поверхностную проверку. Синонимайзинг или рерайт низкого уровня создают текст, уникальный для программы-проверки, но не для нейросетевых моделей Яндекс. Алгоритмы Proxima анализируют смысловые конструкции, а не просто порядок слов.

Результат – публикация контента с формальной уникальностью 95%, но с нулевой семантической ценностью. Такой материал не вызывает доверия, не удерживает пользователя и получает поведенческий фильтр.

| Параметр | Старый метод (Ручной/Софт) | Наш метод (TextLog) |

|---|---|---|

| Уникальность для алгоритмов | Техническая, 90-95% | Смысловая, с LSA-ядром |

| Работа с анкор-листом | Ручное распределение, дубли | Автоматическая ротация по кластерам |

| Скорость подготовки контента | 10-15 статей/день | 200+ статей/час |

| Риск обнаружения сетки | Высокий (шаблоны) | Минимизирован (разнообразие) |

Где взять контент, если биржи копирайтинга не подходят?

Биржи – это человеческий фактор: срывы сроков, плавающее качество, рост цен. Для масштабирования PBN-сетки это тупик. Десктопный софт для парсинга и переработки требует прокси, капчи, мощного железа и постоянной настройки.

Решение: Programmatic SEO. Генерация контента по шаблонам на основе глубоких LSA-цепочек. Система создает масс-пейдж контент под лонгтейл, обеспечивая необходимое смысловое разнообразие для каждого сателлита.

- Автоматический подбор и кластеризация семантического ядра.

- Генерация уникальных текстовых структур для каждого домена.

- Интеллектуальная расстановка анкоров без пересечений внутри сети.

- Мгновенная публикация через API на хостинг или CMS.

Оптимизация ссылочной массы требует точности. Каждая статья на сателлите должна выполнять роль весов для основного проекта. Ошибки в копирайтинге или однообразные ссылки ломают всю конструкцию.

Ключ к безопасности – в отсутствии шаблонов. Алгоритмы ищут повторяющиеся элементы: структуру, анкоры, метаданные. Разорвите шаблон с помощью машинного разнообразия.

Переход на облачную генерацию снимает проблемы с железом, прокси и капчей. Фокус смещается с технического администрирования на стратегию построения сети и анализ рекрол-бюджета.

Создание материала с нуля: инструменты и тактики для быстрого наполнения

| Параметр | Старый метод (Ручной/Десктоп) | Наш метод (Облачная генерация) |

|---|---|---|

| Скорость наполнения | 5-10 статей в день | 200+ статей в час |

| Стоимость 1000 зн. | От 50₽ (биржи) + риски | От 1.5₽ (прогрессивные модели) |

| Затраты на инфраструктуру | Прокси, мощное железо, софт (Zennoposter), капча | Нет. Только браузер. |

| Риски для сети | Высокие (шаблонность, следы копирования) | Контролируемы (разные модели, настройка тона) |

| Масштабирование | Линейный рост затрат | Экспоненциальный рост объема |

- Полная автоматизация от семантики до публикации.

- Интеграция с CMS для масс-пейдж.

- Динамическая подмена синонимов и LSI-фраз.

- Приоритет в скорости, а не в литературном качестве.

Как генерировать тонны контента без потери в качестве для SEO?

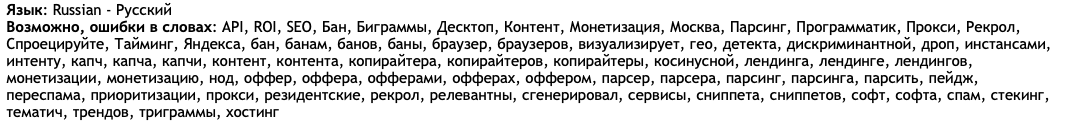

Забудьте про глубокий рерайт вручную. Ключ – программируемый подход (Programmatic SEO). Берется семантическое ядро для ниши дроп-домена. Система создает сотни вариаций текстов на основе шаблонов, куда подставляются ключевые слова из ядра. Это не тупой синонимайзинг, а генерация новейшими моделями с пониманием контекста.

Оптимизация под Яндекс требует не просто уникальной строки, а естественного потока LSI-триггеров. Качественная облачная генерация умеет встраивать их в текст, имитируя ручную работу.

Где брать исходники для генерации, чтобы избежать фильтров?

Используйте агрегаторы новостей по вашей тематике, нишевые форумы, каналы Telegram. Не копируйте, а давайте системе URL для анализа и создания нового текста на основе полученных данных. Это сложнее, чем простой рерайт, но безопаснее.

Публикация однотипных текстов, сгенерированных одной моделью без донастроек, – риск для всей сети. Чередуйте движки, настройки «температуры» генерации, добавляйте абзацы ручной правки для Tier-1 сайтов.

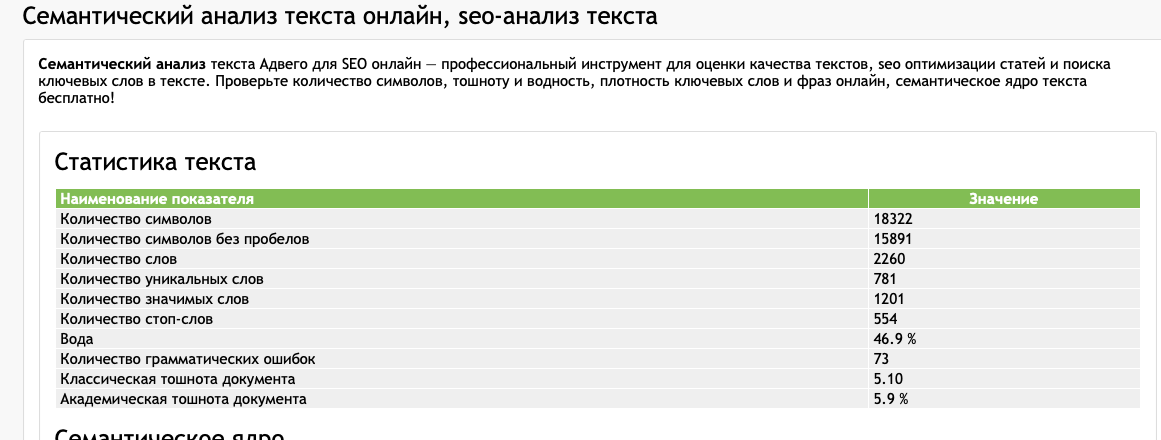

Для вебмастеров, работающих с большими сетками, критична интеграция генератора в пайплайн: сбор семантики → генерация → проверка уникальности → публикация. Ручные этапы убивают ROI.

Кейс: арбитражник масштабировал сеть с 50 до 300 доменов за месяц. Вручную – нереально. Использовал облачный генератор с API, подключил к парсеру для сбора исходных данных и скрипту автоматической публикации. Затраты на контент упали на 85%.

Финальный этап – техническая оптимизация перед публикацией. Даже сгенерированный текст нужно проверить на переспам, вставить ссылки по правилам, расчитать плотность. Часть этих задач также можно автоматизировать.

Итог: создание материала с нуля для PBN – инженерная задача. Выбирайте инструменты, которые сокращают время от идеи до размещения. Ручной труд, биржи контента и десктопный софт проигрывают в скорости и стоимости облачным решениям.

Репак и переработка: легальные методы использования чужого контента

Прямое копирование – путь к бану. Репак контента для PBN строится на глубокой переработке, а не на краже. Цель – создать новый уникальный материал с сохранением исходной смысловой структуры, но иным языковым оформлением. Это вопрос не только этики, но и технической оптимизации под алгоритмы.

| Параметр | Старый метод: Ручной рерайт / Десктопные парсеры | Наш метод: Облачная генерация |

|---|---|---|

| Скорость обработки | 2-3 статьи/час вручную; риски банов IP при парсинге | 200+ статей/час, без нагрузки на ваше железо |

| Затраты | Оплата копирайтеру или лицензии софта + прокси | Фиксированная цена за объем, без скрытых костов |

| Юридические риски | Высокие при поверхностном рерайте | Минимальные за счет семантического преобразования |

| Масштабирование | Сложное, требует найма людей или настройки зеннопостеров | Линейное: больший объем = пропорционально больше контента |

Как провести глубокий рерайт без потери смысла для SEO?

Поверхностная замена синонимов – недостаточно. Нужно менять структуру предложений, абзацев, добавлять новые примеры или данные. Используйте LSA-подход: анализируйте ядро темы и описывайте его другими словами. Это повышает уникальность для систем проверки и добавляет ценность.

Ключевое правило: Репак – это создание производного контента. Вы береч идею, факты, данные, но излагаете их заново. Добавляйте свою статистику, меняйте порядок блоков, трансформируйте списки в таблицы.

Какие инструменты дают легальный контент для переработки?

Источники – контент под свободными лицензиями (Creative Commons), отраслевые отчеты, правительственные сайты с открытыми данными, старые форумы. Избегайте свежих новостей с крупных медиа. Технически, парсинг возможен, но этичнее и безопаснее работать с уже открытыми для републикации материалами.

Публикация скачанного и слегка измененного текста с коммерческого сайта – прямое нарушение. Риски: от удаления страницы до санкций к основному проекту, на который ведут ссылки.

- Смена синтаксической структуры каждого предложения.

- Перегруппировка абзацев и смысловых блоков.

- Добавление релевантных данных или цитат из других источников.

- Полная замена анкоров в тексте на ваши ключевые фразы.

- Обновление мета-тегов (Title, Description) под свои задачи.

После переработки обязательна проверка уникальности специализированными сервисами. Цель – показатель выше 90%. Только после этого – публикация на сайтах PBN-сети.

Кейс: Замена ручного копирайтинга на автоматизированный репак для сети из 50 дроп-доменов. Бюджет сокращен с 75 000₽ до 22 000₽ в месяц. Скорость заполнения сайтов выросла в 12 раз. Индексация и ранжирование в топ-5 по целевым низкочастотникам – без изменений.

Автоматизация процесса через облачные решения исключает этапы работы с парсерами, капчей, прокси. Вы получаете готовый к размещению массив текстов, прошедший семантическую переработку. Это прямой путь к масштабированию PBN-сеток без роста операционных расходов.

Масштабирование без потерь: система для генерации тысяч уникальных текстов

Ручной копирайтинг для PBN-сеток – путь к банкротству. Дорого, медленно, непредсказуемо. Рерайт синонимайзерами убивает уникальность, а биржи контента срывают сроки. Нужна система, которая генерирует тысячи текстов с минимальными вложениями.

| Параметр | Старый метод (Ручной/Zennoposter) | Наш метод (Облачная генерация) |

|---|---|---|

| Затраты на 1000 текстов | От 30 000 ₽ + рекрол-бюджет | ~5 000 ₽ (фикс. цена) |

| Сроки выполнения | Недели, срывы | 5-7 часов (автоматически) |

| Техническая сложность | Прокси, капча, железо, скрипты | Нет. Работает в браузере |

| Риск обнаружения | Высокий (шаблонность) | Низкий (нейросетевые модели) |

- Полная автоматизация цикла: от идеи до публикации.

- Интеграция с CMS для мгновенного размещения.

- Глубокая LSI-оптимизация без переспама.

- Автоматический подбор и вставка анкоров.

- Масштабирование до десятков тысяч страниц.

Как устроен процесс генерации под Tier-1?

Система работает на принципах Programmatic SEO. Не создаём статьи – создаём шаблоны для тысяч страниц. Берём дроп-домен по тематике, парсим семантическое ядро из топовых конкурентов. На основе данных формируем структуры для масс-пейдж.

Ключ: используем новейшие языковые модели. Они анализируют топовые документы Яндекса, генерируют текст с естественным вхождением ключей, синонимов, тематических цепочек. Это не рерайт – это создание нового контента с нуля.

Где брать семантику для тысяч страниц?

Не покупайте устаревшие базы. Используйте парсеры, которые собирают лонгтейл из «Поиска подсказок» и «Вопросов» Яндекса. Одна широкочастотная фраза даёт сотни хвостов. Система автоматически распределяет их по кластерам, создавая тематические группы для статей.

Пример кейса: PBN-сеть из 500 сайтов по ремонту техники. Собрано 45 000 вопросов. Система сгенерировала 4500 уникальных текстов (по 9 вариаций на тему). Индекс – 94%. Бюджет на контент: 22 500 ₽ вместо 450 000 ₽ при ручной работе.

Оптимизация под SEO закладывается в шаблон. Задаётся плотность ключей, структура H2-H4, правила вставки LSI-слов. Система сама формирует мета-теги, заголовки, описания. Вебмастерам остаётся проверить и запустить публикацию.

Риск: бездумная генерация по одному шаблону. Все тексты получатся одинаковыми. Решение: используйте ротацию синонимичных конструкций, меняйте структуру абзацев, добавляйте уникальные факты из парсинга.

Ссылки и анкоры вставляются по заданной схеме. Можно настроить привязку к конкретным запросам, использовать безанкорные упоминания, варьировать ключи. Система сама соблюдает лимиты, избегая переоптимизации.

VIP-доступ даёт приоритет в очереди генерации, доступ к экспериментальным моделям для максимальной естественности текста и лимит в 10 000 статей в сутки. Для сетей от 1000 сайтов.

Итог: масштабирование PBN – это математика. Считаем ROI, убираем ручной труд, автоматизируем. Контент перестаёт быть узким местом.

Вопрос-ответ:

Какие основные требования к текстам для PBN сайтов, чтобы они выглядели естественно для поисковых систем?

Тексты должны быть, в первую очередь, полезными для человека. Поисковые системы анализируют поведенческие факторы, и если пользователь сразу покидает страницу, это сигнал о низком качестве. Контент обязан решать задачу читателя: отвечать на вопрос, давать инструкцию, предоставлять обзор. Важно избегать переоптимизации — равномерно распределять ключевые фразы, использовать синонимы. Текст должен быть уникальным, грамотным и логично структурированным, с заголовками и абзацами. Стиль письма — как у обычного информационного сайта, без навязчивой рекламы и избыточного количества ссылок на один ресурс.

Можно ли использовать готовый контент из бирж статей или рерайт новостей для наполнения PBN?

Это рискованный подход. Многие биржи наполнены шаблонными текстами, которые могут быть уже использованы на других проектах. Низкокачественный рерайт новостей также легко выявляется. Поисковые системы оценивают экспертность и оригинальность. Лучше создавать собственные материалы или заказывать тексты у авторов на конкретную тему, даже если это требует больше ресурсов. Уникальный взгляд, анализ или небольшие исследования сделают сайт сетки более авторитетным. Копирование или поверхностная переделка чужих материалов могут привести к санкциям для всей сети.

Как часто нужно публиковать новые материалы на сайтах PBN?

Регулярность важна, но она не должна вредить качеству. Для большинства тематик достаточно публикации 1-2 раз в месяц. Главное — поддерживать сайт «живым», показывать его активность. Резкие всплески публикаций (например, 30 статей за неделю) после долгого простоя выглядят неестественно. Лучше установить реалистичный график, который вы сможете соблюдать длительное время. Постоянное редкое обновление лучше, чем массовая загрузка контента с последующим забвением проекта на полгода.

Есть ли способы получить контент для PBN с минимальными затратами?

Да, некоторые методы существуют. Можно использовать интервью со специалистами в вашем кругу — это даст уникальный материал. Перевод качественных иностранных статей по теме (с адаптацией, а не дословный) — еще один вариант. Можно писать короткие, но информативные заметки-комментарии к отраслевым событиям или новостям. Однако стоит понимать, что полностью бесплатный контент часто требует значительных временных затрат. Оптимальный баланс — комбинирование собственных усилий (написание основного ядра статей) с привлечением недорогих, но ответственных копирайтеров на периферийные темы.

Что важнее для PBN: объем текста или его качество и соответствие тематике сайта?

Безусловно, качество и соответствие тематике. Объем — вторичный параметр. Текст на 500 слов, который полностью раскрывает конкретный вопрос и удерживает внимание читателя, намного лучше бессмысленной «простыни» на 5000 символов. Тематическое соответствие критически важно: сайт о ремонте автомобилей должен содержать статьи о запчастях, обслуживании, обзорах моделей. Размещение на нем текста о вязании разрушит его семантическое ядро и вызовет подозрения. Качественный, релевантный контент формирует реальную ценность сайта, даже если он создан для ссылочной массы.

Какие есть способы получить тексты для сайтов PBN-сети, если нет возможности писать их самостоятельно?

Есть несколько основных путей. Первый — заказ текстов у копирайтеров на биржах или в агентствах. Важно давать четкое техническое задание и требовать уникальность. Второй способ — покупка готового контента на текстовых биржах, где можно купить статьи из «библиотек». Третий вариант — использование перевода качественных иностранных статей с глубокой переработкой, а не поверхностным машинным переводом. Четвертый, более рискованный метод — синонимизация (рерайт) чужих текстов с помощью специальных программ, но результат часто имеет низкое качество и может навредить сайту.

На что обращать внимание при подготовке контента для ссылочного сайта, чтобы он не выглядел искусственно?

Главная задача — сделать сайт правдоподобным. Контент должен быть логично сгруппирован по тематическим разделам, а не представлять собой набор случайных статей. Пишите или заказывайте статьи разного формата: не только обзоры и списки, но и инструкции, новости по теме, ответы на вопросы. Добавляйте мультимедиа — свои или уникальные изображения, простые инфографики. Важно соблюдать регулярность публикаций, даже если это одна статья в месяц. Следите за стилем: он должен быть единообразным в пределах одного сайта. Избегайте чрезмерной коммерческой направленности в каждой статье; часть материалов должна носить информационный характер без навязчивых призывов к действию.

Хочешь купить статьи дешево для сайта и блога? Перейти в магазин статей

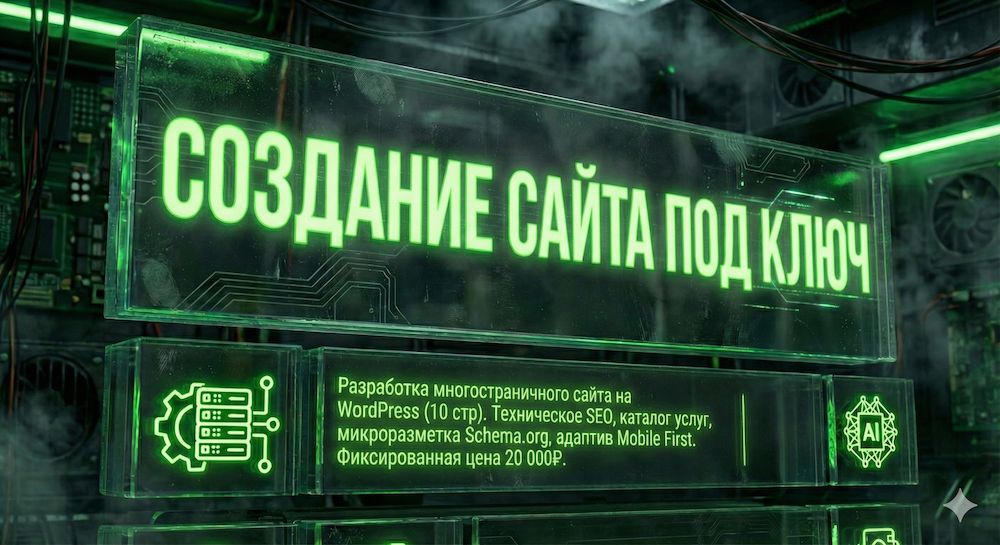

Нужен современный сайт или лендинг? Заказать создание сайта

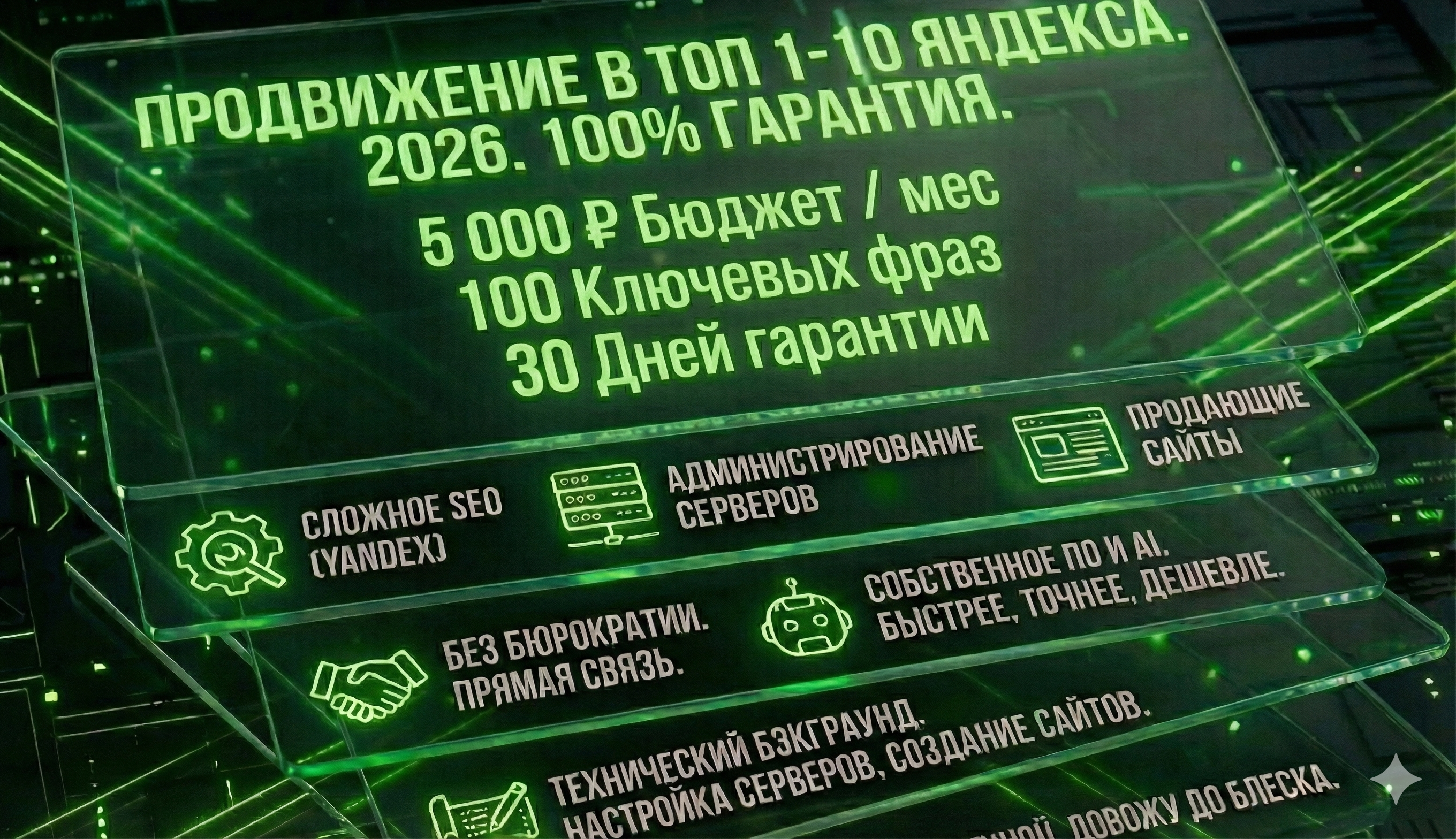

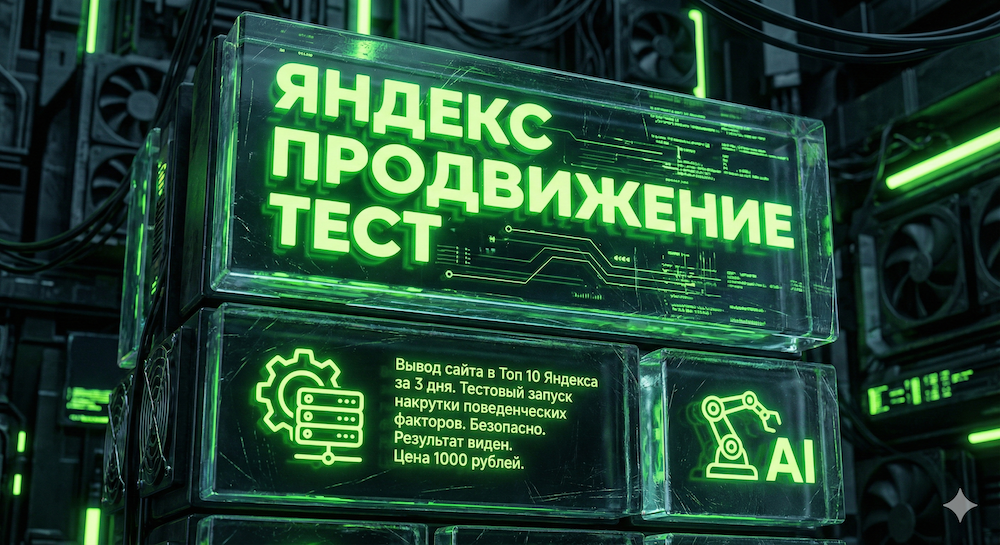

Сайт не видно в поиске? Продвинуть сайт в ТОП Яндекс