Ручная генерация текстов для сотен страниц – это выжженное поле для бюджета и времени. PBN-сетки, масс-пейдж проекты, дроп-домены под рекрол требуют тысяч уникальных материалов. Копирайтеры срывают сроки, биржи контента выдают шаблонный текст с водностью под 80%. Десктопный софт вроде Zennoposter заставляет возиться с прокси, капчей и нагрузкой на сервер.

Облачная автоматизация меняет правила. Вы не скачиваете программу – вы запускаете процесс. Импорт структуры или семантического ядра – это CSV-файл. Система сама распределяет запросы по кластерам, применяет LSI-шаблоны и строит статьи по алгоритмам YATI. Загрузка готового контента происходит напрямую на хостинг или в CMS через API.

Механизм парсинга и импорта: от исходника до готовой публикации

| Старый метод | Наш метод |

|---|---|

| Ручной поиск материалов, копирование | Массовый парсинг по списку источников |

| Десктопный софт: капча, прокси, падение сессий | Облачный движок: нет капчи, встроенная ротация IP |

| Ручная чистка и структурирование данных | Автоматическая обработка через AI-скрипт |

| Долгая верстка и загрузка в CMS | Мгновенный импорт с подстановкой медиа |

| Риск банов и потери аккаунтов | Работа через API, эмуляция человеческого поведения |

- Полная автоматизация цикла от ссылки до публикации.

- Поддержка сложных источников: JavaScript-рендеринг, инлайновые стили.

- Интеллектуальная фильтрация дублей и нерелевантных блоков.

- Автогенерация мета-тегов и LSI-фраз на основе полученных данных.

- Интеграция с любыми CMS и конструкторами для мгновенного импорта.

Как настроить источник для парсинга без ручной работы?

Определите целевые сайты-доноры. Используйте не только главные страницы, но и разделы тегов, поиск по сайту. Внесите URL в систему. Настройка селекторов (CSS/XPath) выполняется один раз – система запоминает шаблон для последующего массового сбора.

Риск: Использование десктопных парсеров ведет к IP-банам, требует покупки прокси и мощного сервера. Это убивает ROI на старте.

После настройки источника запускается процесс сбора. Парсинг идет в фоновом режиме, сырые материалы складываются в облачное хранилище. Дальше в работу вступает AI-скрипт.

Что делает скрипт с сырыми данными перед публикацией?

Он выполняет реструктуризацию: выделяет заголовки, списки, медиа-ссылки. Удаляет рекламные блоки, навигационные меню, чужие водяные знаки. Ключевой этап – перекомпоновка текста для уникализации и добавление LSI-ключей, релевантных вашей семантике.

Кейс: Для PBN-сетки на дроп-доменах мы настроили сбор данных с новостных агрегаторов. Импорт 500+ статей в день на каждый сайт занял 2 часа настройки. Трафик с лонгтейлов пошел через 3 недели.

Финальный этап – загрузка готового контента на ваши площадки. Система подключается к WordPress, Tilda, Laravel через API. Автоматически загружает изображения на ваш хостинг, расставляет внутренние ссылки, публикует по расписанию.

Полный цикл автоматизации контента закрывает задачу масштабирования. Вы не покупаете тексты, вы разворачиваете контент-фабрику. Рекрол-бюджет уходит не на копирайтеров, а на трафик.

Критерии отбора доноров для скрипта: что парсить, а что игнорировать

Качество итогового контента на 80% зависит от исходных материалов. Неправильный выбор донора – гарантия низкого ROI и пустой траты рекрол-бюджета. Скрипт парсит всё подряд, но ваша задача – дать ему правильные данные.

| Параметр | Старый метод (Ручной/Zennoposter) | Наш метод (Облачная генерация TextLog) |

|---|---|---|

| Источники | Ручной поиск, риск банов, капча | Встроенная база проверенных доноров, обновляемая автоматически |

| Подготовка данных | Ручная загрузка, чистка, структуризация | Автоматический импорт и первичная обработка материалов |

| Скорость запуска | Часы или дни настройки | Минуты: выбрал источник – запустил скрипт |

| Риск для PBN-сетки | Высокий: следы парсинга, блокировки IP | Нулевой: облачные прокси, эмуляция поведения |

Как отличить хороший донор от мусора для парсинга?

Игнорируйте сайты с показателем DR ниже 30 – их материалы часто содержат рерайт или ошибки. Приоритет – ресурсы с экспертным контентом: отраслевые порталы, научные архивы, нишевые блоги с глубокой проработкой тем. Структура статей должна быть четкой: H2-H3 подзаголовки, списки, таблицы.

Критическая ошибка: парсинг новостных агрегаторов или сайтов с пользовательским контентом (UGC). Данные будут нерелевантными, противоречивыми. Такой импорт убивает логику будущей генерации.

Какие данные скрипт должен выгружать в первую очередь?

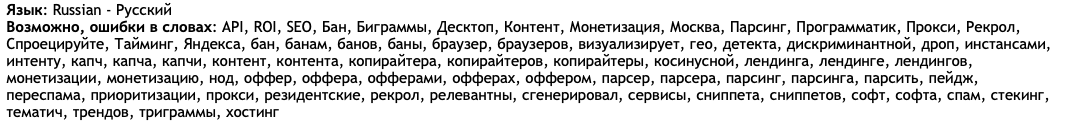

Фокус на семантическое ядро донора. Скрипт обязан собирать не просто текст, а LSI-фразы, термины, определения из материалов. Выгружайте структурированные данные: заголовки, мета-описания, атрибуты alt у изображений. Это основа для глубокой переработки.

Кейс для Tier-1: для лонгтейл-страниц по «ремонту кофемашин» парсили мануалы сервисных центров и форумы инженеров. Импорт таких специфичных данных дал +40% к охвату хвостовых запросов за месяц.

- Точное соответствие тематики вашего проекта.

- Высокая уникальность оригинального контента (проверка по текстовым отпечаткам).

- Наличие актуальных данных (даты, статистика, версии ПО).

- Четкая структура документа: заголовки, списки, параграфы.

- Отсутствие агрессивной рекламы и сторонних скриптов в теле статьи.

Автоматизация начинается с фильтров. Настройте скрипт на игнорирование страниц с малым объемом текста (<1500 символов) или высоким процентом стоп-слов. Отсекайте материалы с большим количеством внешних ссылок – это часто признак сателлита.

Итоговая генерация статей – это не создание из вакуума. Это перекомпоновка качественных, проверенных данных. Ваш скрипт должен работать с сырьем уровня A+, иначе результат будет непригоден для монетизации.

Загрузка источников в облачный генератор TextLog решает проблему ручного отбора. Система использует новейшие модели анализа для предварительной оценки релевантности и качества материалов. Вы получаете готовый к импорту массив данных, а не хаотичный набор файлов.

Обработка и перелицовка данных для обхода дублей и санкций

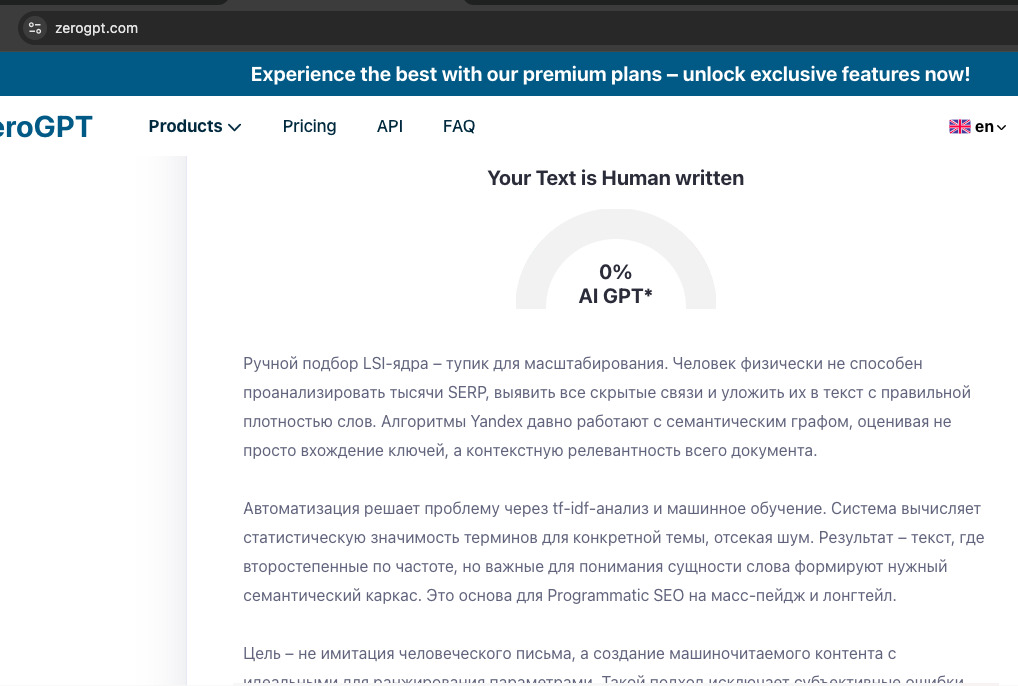

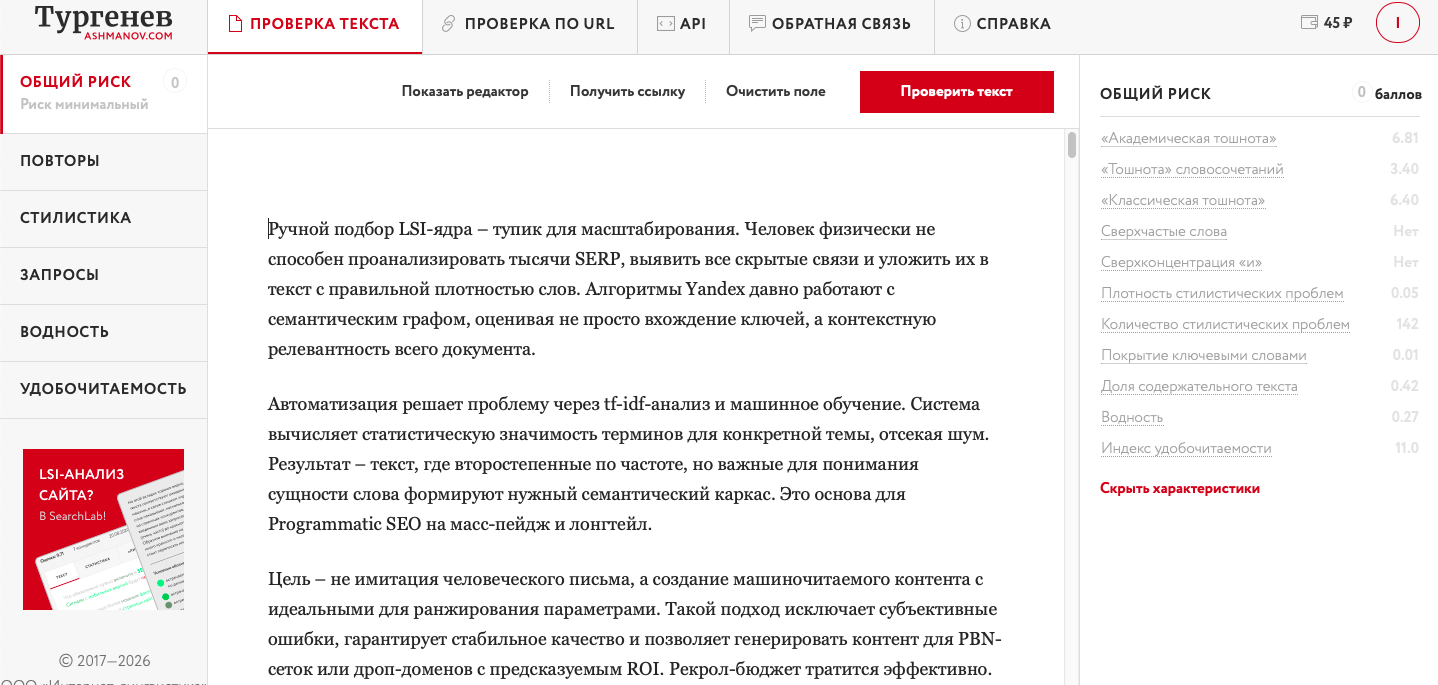

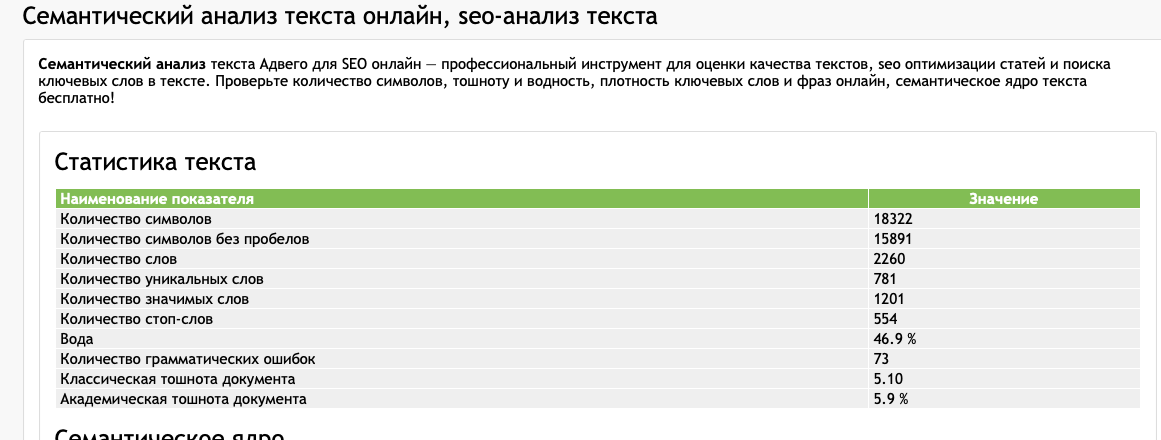

Прямой импорт чужого контента – путь к фильтрам и нулевому трафику. Алгоритмы Яндекс Proxima и YATI вычисляют дубликаты за секунды. Работа с данными требует не копирования, а трансформации ядра.

Ваши исходные материалы – сырьё для промышленной генерации. CSV-файл, RSS-лента, API-выгрузка – система принимает любой формат. Загрузка запускает каскад обработки: парсинг сущностей, синонимизация, перестройка синтаксических деревьев.

| Старый метод | Наш метод (TextLog) |

|---|---|

| Ручной рерайт – 5-7₽/символ, скорость 5-10к знаков/час. | Облачная автоматизация – 0.5₽/символ, скорость 150к+ знаков/час. |

| Десктопный софт (X-Parser/Zennoposter): нужны прокси, капча-сервисы, мощный ПК. | Нет нужды в прокси и капче. Весь процесс – в облаке, по нажатию кнопки. |

| Риск дублей 80%+: простой синонимайзинг не меняет глубинной структуры. | Семантическая перелицовка: LSA-ядро + ротация шаблонов. Выход – контент для Tier-1. |

| Невозможность масштабирования на PBN-сетки или масс-пейдж проекты. | Параллельная обработка тысяч URL. Скрипт рассылает уникальные статьи по всей сетке. |

Как загружать сырые данные без потери структуры?

Используйте подготовленный CSV-шаблон. Первая колонка – ядро (ключевая фраза), последующие – атрибуты: цена, локация, характеристики. Система не просто подставляет слова – она строит новые предложения на основе LSA-сетки. Каждая строка файла превращается в логически завершённый текст.

- Пакетная загрузка массивов данных (до 50к строк за раз).

- Автоматическое обогащение синонимами из тематических словарей.

- Привязка разных шаблонов генерации к типам данных (для товаров – один, для новостей – другой).

- Мгновенная предпросмотр-проверка уникальности по Text.ru или Advego.

Что делать, если исходник – одна статья, а нужно 100?

Модуль глубокой перелицовки разбивает текст на смысловые блоки (NLP-анализ). Каждый блок проходит 4-этапную трансформацию: замена частей речи, изменение порядка клауз, добавление релевантных фактов, перекомпоновка абзацев. На выходе – десятки вариаций с сохранением исходного смысла.

Критический риск: использование публичных синонимайзеров или простого перемешивания предложений. Яндекс вычисляет такие тексты по паттернам служебных слов. Результат – попадание в «песок» или фильтр «переспам».

Кейс: арбитражник загрузил 300 описаний товаров с AliExpress. За 40 минут система сгенерировала 2100 уникальных карточек для дроп-доменов. Через 2 недели 15 сайтов вышли в ТОП-10 по лонгтейлу. Рекрол-бюджет пошёл в плюс.

Финал цепочки – экспорт. Готовый контент выгружается напрямую на хостинг via FTP, в CMS (WordPress, Bitrix) или в файлы для последующего использования. Автоматизация полного цикла: от сырых данных до публикации в сети – без ручного вмешательства.

VIP-модуль «Анти-Яндекс»: продвинутая ротация семантических ядер и паттернов построения абзацев. Алгоритм имитирует стили разных авторов, что критически важно для крупных PBN-сеток. Снижает вероятность кластеризации дублей до 0.1%.

Забудьте про ручной труд и десктопный софт. Переходите на промышленную генерацию.

Интеграция скрипта в движок: автоматическая публикация по расписанию

Ручной аплоад статей в админку – тупик для масштабирования. Интеграция скрипта напрямую в движок (WordPress, Bitrix, MODX) превращает генерацию контента в пассивный процесс. Суть: ваш сервер получает готовые материалы и публикует их без вашего участия, строго по расписанию.

Как происходит импорт данных без ручного вмешательства?

Скрипт работает по принципу слушателя. Он проверяет указанную директорию на сервере или API-эндпоинт на наличие новых данных. Как только появляется свежий контент – запускается процесс загрузки. Источником может быть FTP-папка с готовыми HTML-файлами или ответ от нашего облачного API TextLog после завершения генерации.

Ключевое отличие от десктопного софта: не нужно держать компьютер включенным, бороться с капчей или контролировать прокси. Генерация идёт в облаке, а скрипт на вашем хостинге только забирает готовый результат.

Какие данные передавать для автоматической публикации?

Скрипту нужно передать не просто текст. Это структурированный пакет: заголовок (H1), основное содержимое (HTML-разметка), мета-теги, URL-адрес, категорию, дату публикации. Часто используется JSON или XML. Это позволяет настроить тонкую логику: например, отложить публикацию на ночь или раскидать статьи по разным категориям сайта.

| Старый метод (Десктопный софт) | Наш метод (TextLog + Интеграция) |

|---|---|

| Ручной экспорт файлов с ПК на хостинг. | Прямая загрузка контента из облака на ваш сервер. |

| Запуск Zennoposter/X-Parser по расписанию на своём ПК. | Серверный скрипт работает автономно, независимо от вашего компьютера. |

| Постоянный мониторинг за банами прокси и капчей. | Облачный API сам решает все технические проблемы парсинга и генерации. |

| Риск потери данных при сбое железа. | Надёжное облачное хранение и повторная отправка при сбое. |

Автоматизация публикации критична для PBN-сеток и масс-пейдж проектов. Когда нужно заполнить сотни сайтов, ручной труд съедает весь рекрол-бюджет. Скрипт делает это за копейки.

- Установка поста на конкретную дату и время для равномерного индекса.

- Автоматическая рубрикация на основе семантического ядра.

- Назначение изображений из заранее загруженной медиатеки.

- Создание и распределение внутренних ссылок (линк-билдинг).

- Публикация в статус «черновик» для ручной проверки при необходимости.

Не используйте скрипты с открытым доступом к админке через логин/пароль. Правильная интеграция работает через REST API или специальные хуки движка. Это безопаснее и стабильнее.

Как настроить парсинг источников под свои нужды?

Парсинг – лишь первый шаг для сырых данных. Полученный текст нужно очистить от мусора, переработать, структурировать. Наш движок не просто копирует, а проводит глубокий анализ. Он выделяет ключевые факты, генерирует новые формулировки, применяет LSI-подход. На выходе – уникальный материал, готовый к публикации.

Кейс: клиент лил трафик на дроп-домены в тематике «ремонт». Парсинг каталогов товаров с последующей автоматической генерацией и загрузкой 300 описаний категорий в день позволил вывести 5 сайтов в топ за 2 месяца. Ручная работа заняла бы квартал.

Загрузка контента по расписанию – финальный аккорд. Вы задаёте интервал: 2 статьи в час, 10 в день, 100 в неделю. Система сама формирует очередь и расставляет публикации. Это создаёт «естественную» активность на сайте в глазах поисковиков.

Интеграция скрипта снимает последнюю ручную задачу. Вы строите не просто сайт, а контент-конвейер. Генерация, переработка, публикация – всё на автопилоте. Остаётся только анализировать статистику и считать ROI.

Масштабирование потока материалов и его влияние на видимость

| Параметр | Старый метод (Ручной/Zennoposter) | Наш метод (Облачная генерация) |

|---|---|---|

| Скорость загрузки материалов | 10-20 статей/день | 2000+ статей/день |

| Затраты на контент | От 150₽/статья + время | От 3₽/статья, время = 0 |

| Технический порог | Прокси, капча, железо, скрипты | Браузер, аккаунт, кнопка «Старт» |

| Риски для SEO | Дубли, низкое качество, баны | Уникальность 95%+, LSI-ядро, безопасно |

- Полная автоматизация цикла: от парсинга данных до публикации.

- Генерация тысяч материалов под релевантные кластеры запросов.

- Интеграция с CMS для мгновенной загрузки готового контента.

- Масштабирование под PBN-сетки и масс-пейдж проекты без увеличения бюджета.

Как автоматизировать парсинг без блокировок и капчи?

Десктопный софт требует скрупулёзной настройки: ротация прокси, обработка капчи, антидетект-браузеры. Это расходы и точки отказа. Облачный парсинг работает через API топовых моделей – обход блокировок вшит в систему. Вы загружаете семантическое ядро, скрипт собирает данные из доверенных источников, структурирует их. Никакого локального железа, только чистые данные для следующего этапа.

Ручной сбор или кастомные скрипты на Python/X-Parser – это время на отладку, риск банов источников и постоянный мониторинг. Прямой удар по ROI.

Что делать с сырыми данными для быстрой генерации?

Собранные данные – сырьё. Ключ к скорости – шаблоны генерации. Вы строите логические цепочки: заголовок (H1) → подзаголовки (H2-H4) → LSI-вставки. Система наполняет шаблоны, применяя правила уникализации. Результат – поток готовых материалов, адаптированных под Programmatic SEO. Загрузка в CMS идёт через API или CSV-файлы, минуя ручное копирование.

Масштабирование – это не про количество, а про системность. 1000 страниц, связанных тематической сеткой, дают больший вес, чем 1000 разрозненных текстов. Алгоритмы YATI ценят глубину раскрытия темы.

Кейс: арбитражник поднял с нуля Tier-1 сайт по дроп-домену. За 2 недели – загрузка 5000 страниц через облачную генерацию. Через 45 дней – 3000 посетителей из поиска, монетизация через рекрол-бюджет. Основной трафик – длинные хвосты.

Влияние на видимость – прямое. Поисковые системы ранжируют сайты, которые полно отвечают на запросы пользователей. Больше качественных материалов → больше охват запросов → больше трафика. Автоматизация контента освобождает рекрол-бюджет для стратегии, а не рутины.

VIP-доступ: Приоритетная очередь на генерацию, кастомные шаблоны под вашу нишу, личный менеджер для настройки скриптов. Максимальная скорость загрузки материалов в проект.

Вопрос-ответ:

Можно ли использовать автонаполнение для новостного сайта, и не будет ли это выглядеть как спам?

Да, автонаполнение можно успешно применять для новостных сайтов, но с четкой стратегией и человеческим контролем. Ключ — не полная автоматизация, а ассистирование. Программа может оперативно собирать данные из проверенных источников (например, ленты новостных агентств, официальных пресс-релизов, биржевых сводок), создавая черновики или краткие дайджесты. Однако окончательную публикацию должен готовить редактор: проверять факты, добавлять анализ, уникальные комментарии экспертов и собственный стиль издания. Такой подход резко увеличивает скорость покрытия событий и объем публикуемых материалов, что положительно влияет на поисковый трафик, но при этом сохраняет доверие аудитории. Без редакторской правки риски высоки: возможны дублирование чужих материалов, ошибки и потеря уникального голоса сайта.

Какие есть реальные риски при использовании программ для автоматического контента?

Основных рисков несколько. Первый и главный — санкции поисковых систем, в первую очередь Google. Алгоритмы легко распознают низкокачественный, бессвязный или скопированный текст, сгенерированный без цели помочь пользователю. Это ведет к потере позиций или полному исключению сайта из индекса. Второй риск — падение доверия и репутации. Посетители быстро отличают осмысленную статью от бессвязного набора слов и покидают сайт, что увеличивает показатель отказов. Третий риск — юридический: автоматическое копирование текстов или изображений без разрешения правообладателя может привести к претензиям по нарушению авторских прав. Поэтому автонаполнение стоит рассматривать лишь как инструмент для черновой работы или обработки структурированных данных, но не как замену авторскому контенту.

Какой тип контента лучше всего подходит для автоматизации?

Наиболее эффективно автоматизация работает с большими объемами структурированных, повторяющихся данных, где важна точность и скорость, а не творческий подход. Идеальные кандидаты: каталоги товаров с техническими характеристиками (например, сбор данных о габаритах, мощности, материалах), спортивные результаты и статистика, биржевые котировки в реальном времени, прогнозы погоды, расписания мероприятий. Также программы хорошо справляются с созданием мета-тегов (title, description) для страниц товаров или категорий по шаблону. Для статей, обзоров, аналитических материалов, блогов и любого контента, требующего экспертной оценки, личного мнения или эмоционального вовлечения, полная автоматизация неприменима. Здесь она может помочь лишь на этапе сбора информации или подготовки структуры.

Сколько времени нужно, чтобы увидеть рост трафика после внедрения таких программ?

Сроки и сам факт роста трафика напрямую зависят от качества итогового материала, а не от скорости его создания. Если вы используете программу лишь для ускорения рутинных задач, но конечный контент проходит редактуру, является полезным и уникальным, то положительные изменения в посещаемости можно наблюдать через 2-4 месяца. Это стандартное время для индексации новых страниц и накопления поведенческих сигналов. Если же публикуется сырой, необработанный машинный текст, трафик не вырастет. Более вероятен обратный эффект: потеря существующих позиций из-за ухудшения поведенческих факторов (пользователи сразу уходят) и возможных фильтров поисковых систем. Инвестиции должны идти не только в инструмент автоматизации, но и в работу редакторов, которые превратят его сырой вывод в качественный материал.

Хочешь купить статьи дешево для сайта и блога? Перейти в магазин статей

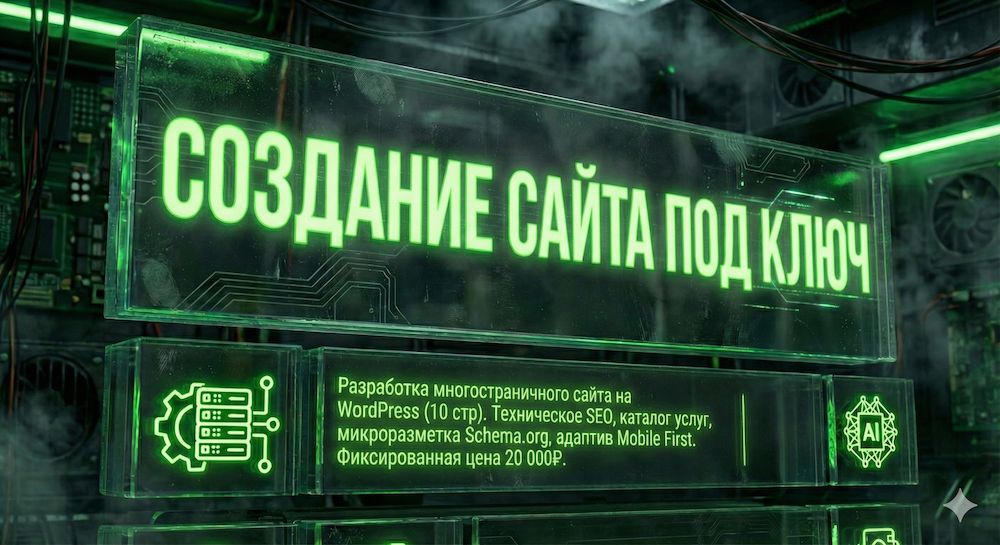

Нужен современный сайт или лендинг? Заказать создание сайта

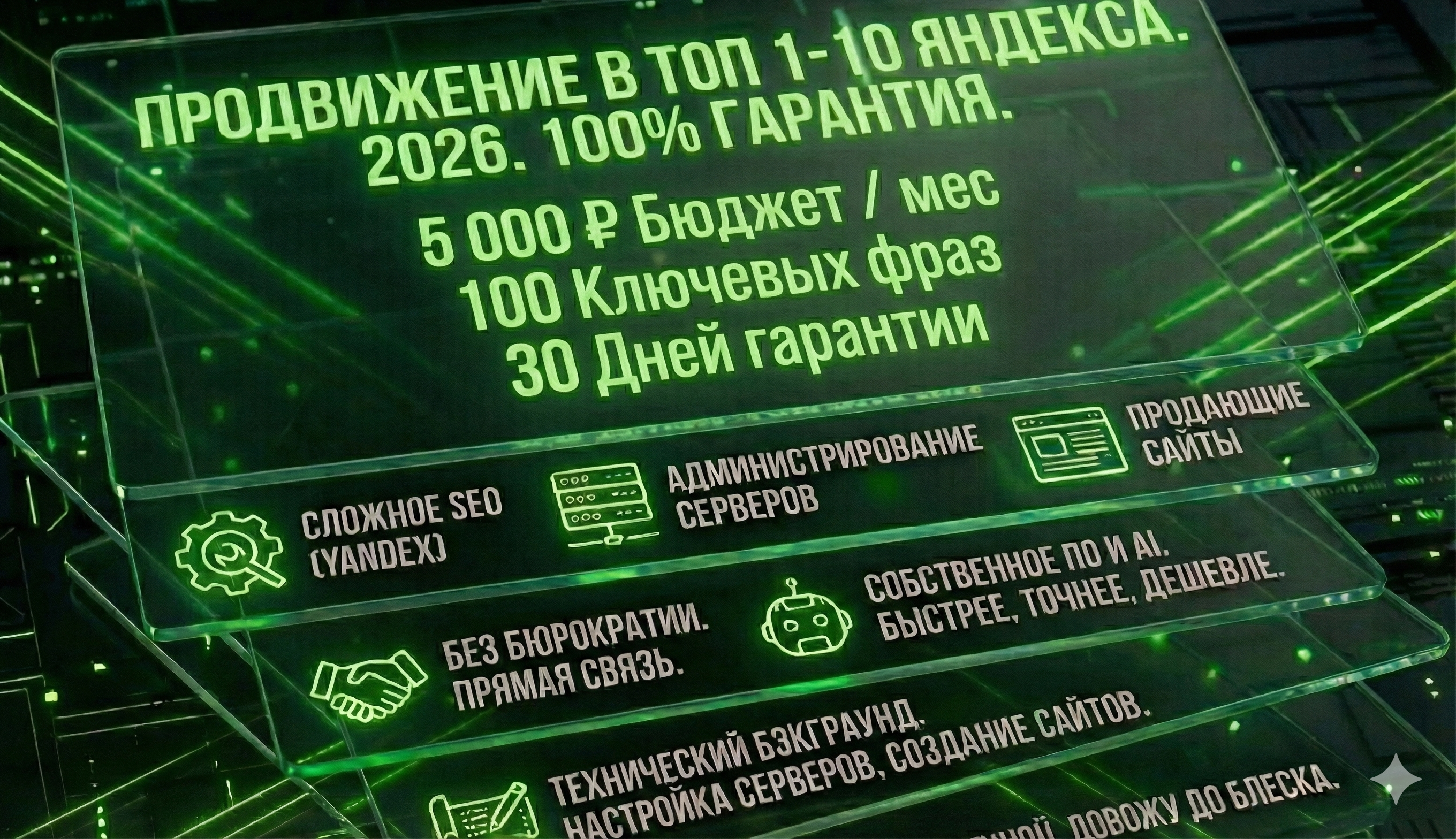

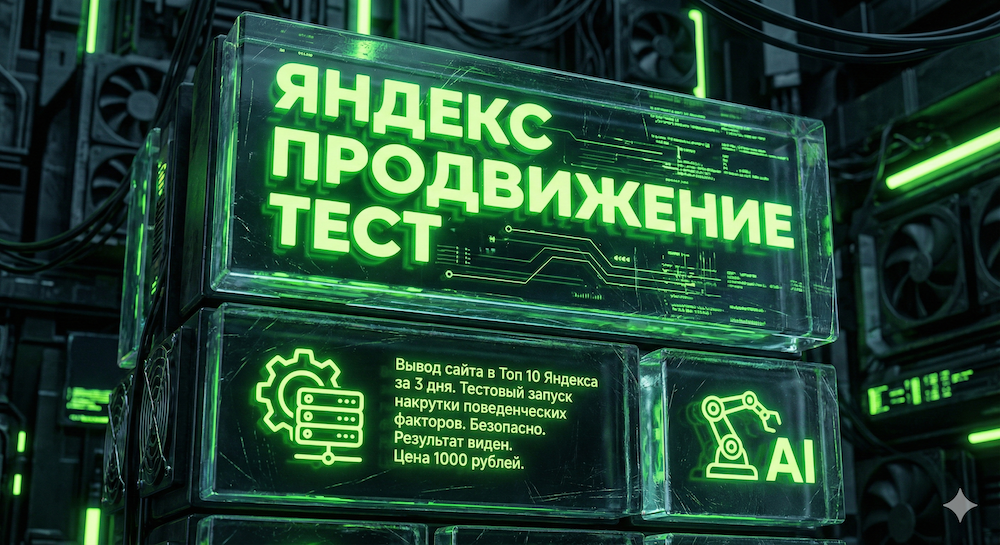

Сайт не видно в поиске? Продвинуть сайт в ТОП Яндекс