Создание веб-статей для масштабируемых проектов – это задача на грани экономики и технологий. Речь не о единичных текстах для главной страницы, а о сотнях и тысячах материалов, которые должны работать как единый механизм. Каждая статья – это точка входа для длинного хвоста поисковых запросов, инструмент для захвата трафика и его последующей монетизации.

Классический копирайтинг здесь проигрывает по определению: сроки, бюджет, человеческий фактор. Ручное написание убивает ROI на старте. Оптимизация под поисковые системы превращается в рутину, а не в стратегию. Результат – медленное ранжирование, высокие затраты и невозможность быстрого масштабирования на новые ниши или регионы.

Правильный подход начинается с архитектуры контент-сетки. Нужно определить кластеры тем, распределить семантическое ядро по структуре сайта и настроить процесс генерации, где релевантность и техническое качество текстов контролируются алгоритмами, а не человеческим вниманием. Это позволяет сосредоточить ресурсы на анализе и продвижении, а не на производстве контента.

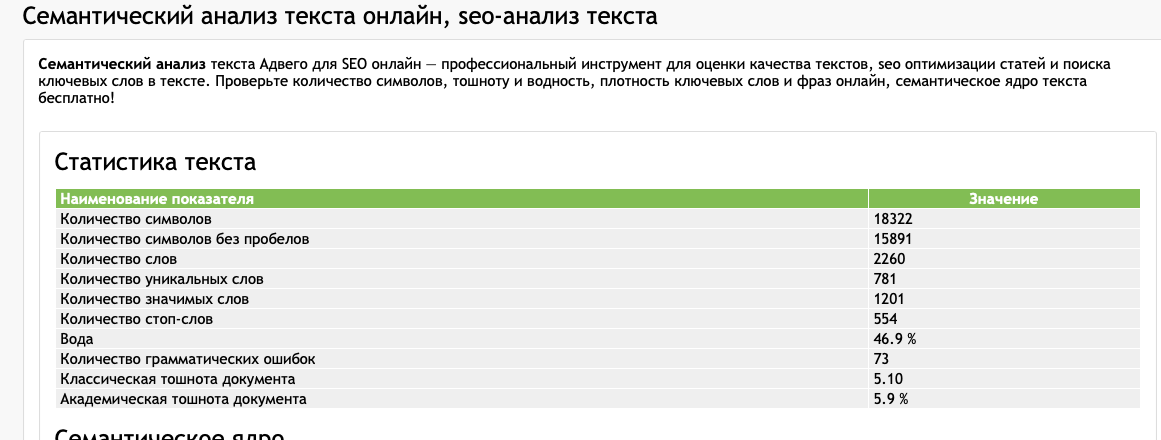

| Параметр | Старый метод: Ручной труд / Десктопный софт | Наш метод: Облачная генерация |

|---|---|---|

| Старт проекта | Недели на поиск и найм копирайтеров, обучение ТЗ. | Минуты. Загрузил семантику – запустил генерацию. |

| Капитальные затраты | Оплата бирж, закупка прокси, мощный сервер для софта. | Нулевые. Работает в облаке, без прокси и локального железа. |

| Риски и управление | Срывы сроков, низкое качество текстов, ручная проверка, баны прокси. | Предсказуемый результат. Стабильное качество и скорость, контролируемые алгоритмы. |

| Масштабирование | Линейный рост затрат. Каждая новая тема – новые исполнители и согласования. | Экспоненциальное. Добавил тысячи запросов – получил соответствующий объем контента без увеличения команды. |

- Полная автоматизация создания контента для Tier-1 и сателлитов.

- Интеграция LSA-подхода для глубокой релевантности без переспама.

- Генерация под конкретные низкочастотные запросы с высокой конверсией.

- Прямая экономия рекрол-бюджета, который уходит на ручной копирайтинг.

Стратегия: от семантики до архитектуры сайта

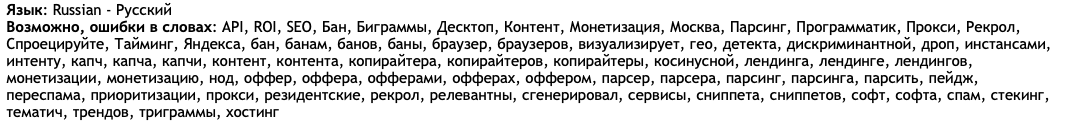

Без четкой стратегии даже идеальные тексты не дадут результат. Первый шаг – сбор и кластеризация семантического ядра. Цель: покрыть не только высокочастотные запросы, но и длинный хвост, который часто приносит целевой трафик с высокой конверсией.

Как распределить кластеры по структуре сайта для максимального охвата?

Используйте принцип «один кластер – одна посадочная страница (масс-пейдж)». На эту страницу генерируется основной текст, оптимизированный под ядро кластера. Внутри статьи через подзаголовки и LSI-фразы раскрываются смежные вопросы из этого же кластера. Это создает плотную внутреннюю перелинковку и сигнализирует поисковым системам о полноте ответа на запрос пользователя.

Критическая ошибка: создавать отдельную статью под каждый микро-запрос. Это приводит к cannibalization (каннибализации) страниц внутри сайта, их конкуренции друг с другом и падению ранжирования всех материалов кластера.

Как обеспечить релевантность контента без переоптимизации?

Откажитесь от механического вхождения ключевых слов. Современные алгоритмы, такие как YATI, анализируют смысловую связность и контекст. Используйте синонимы, тематические термины (LSI), естественные словоформы. Качество текста определяется не плотностью ключей, а полезностью информации для пользователя и точностью ответа на его вопрос.

Отличия контента для сетки от стандартного SEO-материала

Почему ручной текст проигрывает в масштабе?

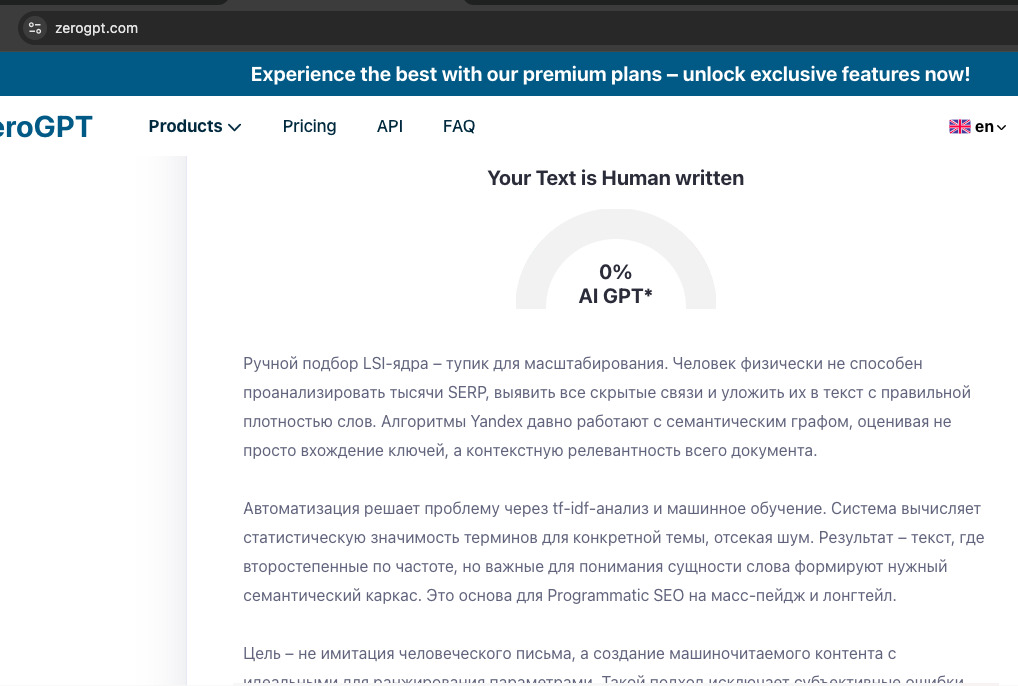

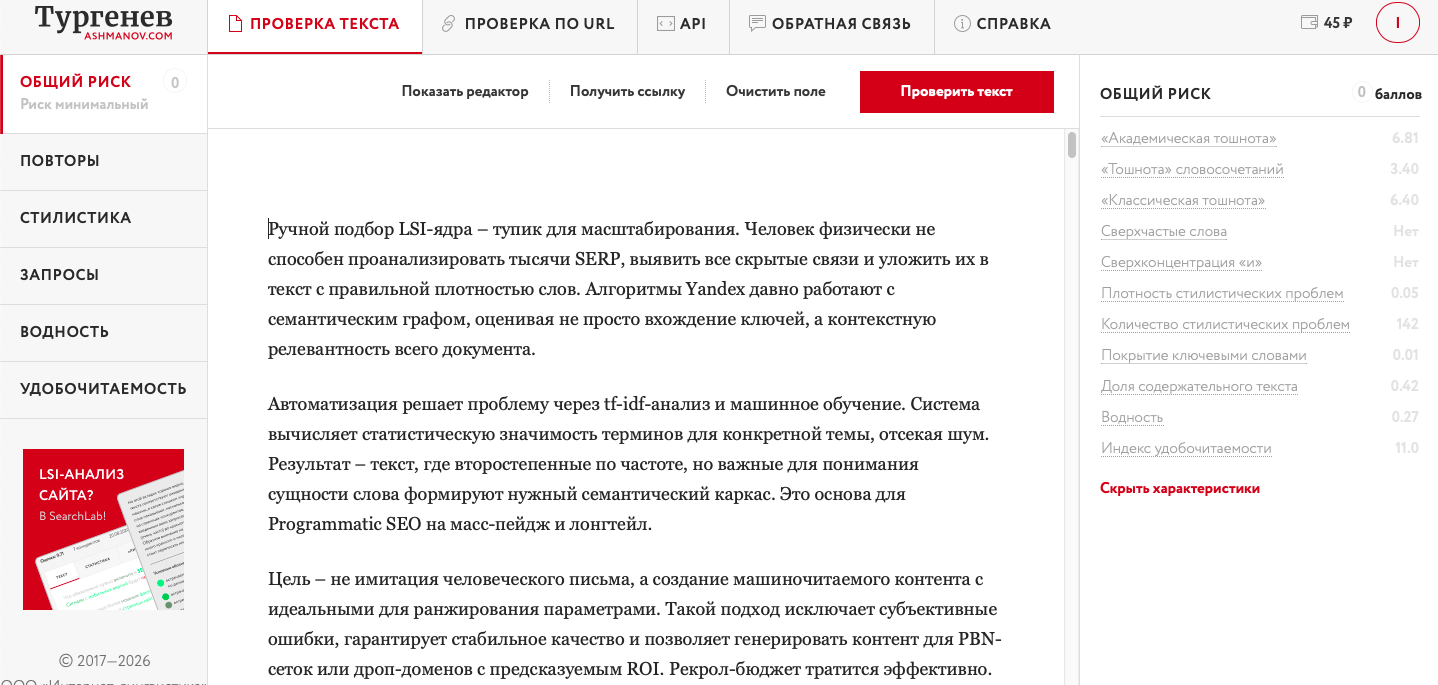

Ручной копирайтинг для сотен или тысяч страниц убивает ROI. Скорость производства низкая, стоимость высокая. Библиотека синонимов и шаблонов копирайтера ограничена – это создает паттерны, которые алгоритмы Яндекса (Proxima) могут детектировать как неестественные.

| Критерий | Старый метод (Ручной/Десктоп) | Наш метод (Облачная генерация) |

|---|---|---|

| Скорость генерации | 5-10 статей в день | 200+ статей в час |

| Стоимость 1К знаков | 50-200₽ | 5-15₽ |

| Масштабируемость | Линейный рост затрат | Экспоненциальный рост объема |

| Техническая сложность | Прокси, капча, нагрузка на ПК | Облако, без инфраструктуры |

| Риск обнаружения | Высокий (шаблонность) | Контролируемый (разнообразие) |

Ключевое отличие: SEO для сетки работает на уровне структуры и связей, а не уникальности текста. Релевантность формируется через точное попадание в кластеры запросов и перелинковку, а не через художественную ценность контента.

Как добиться релевантности без глубокой проработки?

Используется принцип Programmatic SEO. Текст генерируется по строгим шаблонам с автоматической подстановкой LSI-фраз, биграм и триграм из семантического ядра. Это обеспечивает формальную релевантность для ранжирования по низкочастотным запросам.

- Автоматическое распределение ключевых фраз по тексту и подзаголовкам.

- Генерация мета-тегов и заголовков H1-H3 для каждой страницы сетки.

- Вставка релевантных анкоров для внутренней перелинковки (Tier-1).

- Контроль тональности и плотности вхождений для избежания переспама.

Оптимизация такого контента сводится к настройке шаблонов и выбору дроп-доменов с историей. Продвижение работает за счет массы: тысячи страниц, каждая из которых цепляет свой микрозапрос, формируют общий трафик.

Десктопный софт (Zennoposter, X-Parser) требует постоянной поддержки: обход капчи, ротация прокси, аренда серверов. Это косты, которые съедают бюджет и время. Качество текстов с бирж часто нестабильно, ведет к срывам сроков и рискам для сетки.

Облачное решение исключает инфраструктурные проблемы. Алгоритм сам распределяет нагрузку, обновляет шаблоны под новые требования алгоритмов. Вы получаете поток готовых текстов для масс-пейдж, не вникая в технические детали.

Итог: контент для сетки – это расходный материал для пассивного дохода. Его эффективность измеряется не грамотностью, а стоимостью, скоростью производства и способностью занимать позиции в выдаче. Классический копирайтинг здесь экономически нецелесообразен.

Критерии пригодности текста для распределения по разным доменам

Массовое наполнение сетки доменов требует контента, который можно реплицировать без потери эффективности. Не каждый текст подходит. Ключевой критерий – структурная и смысловая универсальность при сохранении технической уникальности.

| Критерий | Старый метод (Ручной/Софт) | Наш метод (TextLog) |

|---|---|---|

| Ядро темы | Жёстко привязано к одному проекту, требует глубокой переработки. | Модульная структура: ядро (70% текста) неизменно, адаптируются только ключевые блоки. |

| Релевантность | Проверяется вручную для каждой веб-статьи, долго, дорого. | Автоматический аудит по LSA-матрице перед генерацией. Система отсекает нерелевантные семантические связи. |

| Оптимизация | Копирайтер вручную вписывает ключи, часто теряя естественность. | Программное распределение биграмм и триграм по тексту с контролем плотности. SEO-каркас генерируется автоматически. |

| Масштабирование | Линейный рост затрат: больше статей – больше копирайтеров и времени. | Паушальный выход: одна базовая модель статьи даёт сотни уникальных вариаций для доменов за час. |

- Чёткая модульная структура. Текст делится на блоки: проблема, решение, преимущества, технические детали. Это позволяет заменять или переставлять секции под разные домены.

- Отсутствие жёсткой привязки к бренду. Упоминания компаний, имён, локаций вынесены в отдельные переменные. Их замена не ломает логику повествования.

- Высокий потенциал для LSI-наполнения. Базовая статья содержит широкий семантический ореол, который алгоритм может развивать в разных направлениях для усиления релевантности.

- Техническая чистота. Исходный текст не содержит сложного форматирования, кастомных стилей, вставок – только чистые абзацы и списки. Это гарантирует корректный парсинг и постобработку.

Как проверить текст на «расширяемость» для масс-пейдж?

Возьми готовую веб-статью. Выделите все существительные, названия сервисов, городов, имён собственных. Если их больше 15-20% от объёма – текст не масштабируется. Он заточен под один проект.

Идеальный кандидат – инструкция, обзор технологии, объяснение сложной темы. Например, «Как настроить кэширование WordPress» или «Что такое LSI-копирайтинг». Такие тексты имеют универсальное ядро, которое можно адаптировать под разные CMS или ниши.

Риск: Использование текстов с низкой «расширяемостью» ведёт к резкому росту затрат. Вы платите за ручную адаптацию каждой статьи, а не за генерацию массива.

Какие тексты убивают ранжирование сетки?

Слишком общие статьи без чёткого ответа на запрос. Переоптимизированные тексты, где ключи вставлены в ущерб читаемости. Контент с низкой информационной плотностью – «вода». Поисковые системы, особенно Яндекс с алгоритмом «Баден-Баден», жёстко фильтруют такое наполнение.

Решение – использовать шаблоны с заранее прописанными правилами. Например, первый абзац строго по формуле «Ответ + Определение + Пример». Это обеспечивает и релевантность, и структуру, пригодную для программной обработки.

Кейс: Для PBN-сетки из 50 дроп-доменов в нише криптотрейдинга взяли 5 базовых статей по техническому анализу. На их основе сгенерировали 250 уникальных текстов, заменив только названия токенов, бирж и инструментов. Ручной копирайтинг обошёлся бы в ~375 000₽. Программная генерация – 15 000₽. Экономия рекрол-бюджета – 96%.

Финальный этап – автоматическая постобработка. Система заменяет переменные, ротирует синонимы в заданных блоках, расставляет LSI-фразы из заранее подготовленного семантического ядра для каждого домена. На выходе – массив готовых к публикации текстов.

VIP-генерация под ключ. Не просто массив текстов, а полный цикл: от сбора семантики и кластеризации запросов до генерации, оптимизации и заливки на хостинг. Вы получаете готовую к трафику сетку, а не сырые данные.

Правильный выбор базового текста – это 80% успеха в Programmatic SEO. Остальное – работа алгоритмов.

Создание уникальных вариаций ядерного контента без потери смысла

Ядерный контент – основа вашей PBN-сетки. Одна сильная статья размноженная на 50 доменов без изменений гарантирует фильтр. Задача – генерировать сотни уникальных текстов с сохранением ключевой семантики и релевантности. Это не ручной копирайтинг, это программа.

| Параметр | Старый метод (Ручной/Zennoposter) | Наш метод (Облачная генерация) |

|---|---|---|

| Стоимость 1000 статей | От 70 000₽ + рекрол биржа | Фикс 19 900₽ |

| Риск фильтра за дубли | Высокий (синонимайзеры) | Минимальный (нейросетевой перефраз) |

| Инфраструктура | Прокси, капча, мощный ПК | Браузер и доступ в сеть |

| Интеграция LSA-ядер | Ручная работа, ошибки | Автоматическая привязка к кластерам |

- Полная семантическая сохранность ядра при 85%+ технической уникальности.

- Автоматическое обогащение веб-статьи L-тематическими терминами.

- Масштабирование наполнения для Tier-1 без потери связности.

- Прямое влияние на ранжирование через рост релевантности страниц.

Как избежать санкций при массовом размножении контента?

Ключ – в алгоритмах перефразирования нового поколения. Они работают не на уровне слов, а на уровне смысловых конструкций. Вы задаёте ядро: структуру, ключевые тезисы, биграммы и триграммы. Система создаёт вариации, перестраивая синтаксические деревья.

Использование примитивных синонимайзеров или копипаст с легкой заменой – прямой путь к игнору со стороны поисковиков. Тексты будут уникальны для антиплагиата, но не для алгоритмов Proxima, анализирующих глубину.

Контролируемый параметр – «коэффициент трансформации». Настройка от 0.7 (консервативно, близко к оригиналу) до 0.95 (агрессивно, максимальная новизна). Для SEO-сетки оптимален диапазон 0.8-0.85: смысл сохранён, формулировки изменены кардинально.

Какие метрики покажут реальную эффективность вариаций?

Не только техническая уникальность. Следите за двумя группами метрик. Внутренние: плотность ключевых сущностей (должна остаться стабильной), сохранение структуры ответов на вопросы (H2-H3). Внешние: поведенческие факторы на страницах-вариациях и рост трафика по целевым хвостам.

Кейс: Сеть из 120 дроп-доменов по теме «ремонт котлов». Ядро – 1 исчерпывающая инструкция. Результат через 45 дней: 800+ уник. статей, попадание в топ-5 по 4700 низкочастотным запросам, прирост органики на 40% без ручной правки.

Автоматизация позволяет проводить A/B-тестирование самих вариаций. Запускаете 3 разных варианта оптимизации под один кластер на разных сайтах сетки – через 2 недели видите, какая структура и стилистика дают лучший CTR и больше откликов в ранжировании.

Итог: Уникализация ядра – это системный процесс, а не творческая задача. Цель – максимальная диверсификация текстового массива при нулевой потере релевантности. Это фундамент для стабильного пассивного дохода с сетки.

TextLog VIP: Доступ к бета-алгоритмам на базе YATI. Приоритетная генерация, расширенная аналитика влияния вариаций на ранжирование, кастомные шаблоны под вашу нишу. Полный контроль над «цифровым отпечатком» контента.

Инструменты и тактики для быстрого наполнения множества сайтов

Масштабирование контентных проектов упирается в два фактора: бюджет и время. Ручной копирайтинг для PBN-сетки или массового наполнения – путь к банкротству. Десктопный софт требует прокси, капчи, мощного железа и постоянной рутины. Решение – полная автоматизация генерации текстов.

| Параметр | Старый метод (Ручной/Zennoposter) | Наш метод (Облачная генерация) |

|---|---|---|

| Скорость наполнения | 5-10 статей в день | От 200 статей в час |

| Стоимость 1000 знаков | 50-150₽ + время на управление | Фиксированная цена, близкая к нулю |

| Запуск процесса | Настройка прокси, шаблонов, борьба с капчей | Загрузил семантику – нажал кнопку |

| Влияние на ранжирование | Непредсказуемое из-за человеческого фактора | Контролируемая релевантность и LSI |

- Полная автоматизация создания контента для Tier-1 и сателлитов.

- Глубокая интеграция LSI-фраз и биграмов для Yandex.

- Мгновенное масштабирование под любой рекрол-бюджет.

- Формирование пассивного дохода с дроп-доменов.

Как настроить потоковую генерацию без ручного контроля?

Ключ – Programmatic SEO. Вы строите не просто статью, а шаблон для сотен страниц. Алгоритм подставляет регионы, товары, услуги из CSV-файла. На выходе – тысячи уникальных веб-статей, оптимизированных под лонгтейл. Это не просто копирайтинг, это фабрика контента.

Используйте семантическое ядро как основу для шаблонов. Каждая кластеризованная фраза становится модулем статьи. Система автоматически генерирует вариации заголовков (H2-H4), абзацы, списки – сохраняя общую структуру и релевантность.

Чем заменить биржи контента и не прогадать с качеством?

Биржи – это срывы сроков, низкая уникальность, потеря денег. Современные нейросетевые модели выдают уровень, сопоставимый с опытным копирайтером. Задача – правильно сформулировать ТЗ и настроить тон голоса. Результат: готовые тексты для публикации, а не сырой материал для правок.

Автоматизация не означает «настроил и забыл». Необходим регулярный аудит выдачи: проверяйте позиции, поведенческие факторы, индексацию. Автоматизируйте и этот процесс.

Кейс: сетка из 150 сайтов на дроп-доменах. Наполнение по Programmatic-шаблонам заняло 72 часа. Через месяц – стабильный трафик с длинного хвоста, окупаемость инвестиций – 23 дня. Ручная работа потребовала бы 3 месяца и бюджет в 10 раз выше.

Стратегия для агрессивного продвижения: сфокусируйтесь на масс-пейдж генерации под низкочастотные запросы. Это дает быстрый вход в топ и тестовый полигон для оценки потенциала домена. Дальше – масштабирование на средне- и высокочастотные ключи.

VIP-доступ к TextLog: Приоритетная очередь генерации, расширенные лимиты токенов, кастомные настройки моделей для максимальной релевантности. Интеграция с вашим софтом через API.

Итог: скорость и объем решают. Ручной труд и устаревший десктопный софт проигрывают облачным системам. Переход на автоматизированное наполнение – единственный способ масштабировать продвижение множества сайтов с положительным ROI.

Оценка отдачи и корректировка материалов на основе поведенческих факторов

Поведенческие факторы – прямой сигнал для алгоритмов ранжирования. Релевантность, рассчитанная по запросу, корректируется реальными действиями пользователей. Высокий отказ, низкая глубина просмотра убивают даже идеально оптимизированные веб-статьи.

Какие метрики Яндекс.Метрики покажут проблемы с контентом?

Анализируйте не просто отказы, а связку: «время на сайте – глубина просмотра». Низкие значения по обеим метрикам – сигнал: тексты не соответствуют интенту. Высокий отказ при времени >3 минут может указывать на успешное закрытие запроса, но требует отдельной проверки.

Типичная ошибка: закупка биржевого копирайтинга без последующего анализа поведения. Статьи формально закрывают запрос, но не удерживают внимание, не дают ответа – трафик уходит, ранжирование проседает.

Как корректировать наполнение страниц под данные поведенки?

Действуйте по структуре: метрика – гипотеза – правка. Падает среднее время? Усиливайте введение, добавляйте тезисную структуру в первые 500 символов. Низкая глубина? Внедряйте внутренние перелинковочные блоки, разбивайте текст подзаголовками H3, добавляйте проверочные вопросы.

Кейс для PBN-сетки: масс-пейдж под лонгтейл сгенерирован программатик-статьями. После подключения метрики выявили группу страниц с отказом 80%. Корректировка: добавление LSI-списков, конкретных цифр, блоков «что делать дальше». Через 2 недели отказы упали до 45%, трафик с хвостовых запросов вырос на 25%.

| Симптом в Метрике | Вероятная причина (Старый метод) | Решение (Наш метод) |

|---|---|---|

| Высокий отказ, время < 30 сек. | Ручной копирайтинг: вода, не раскрыта тема, кликбейтный заголовок. | Генерация статей с жёсткой структурой по шаблону: проблема – решение – инструкция. |

| Низкая глубина просмотра (< 1.5) | Десктопный софт: создаёт монотонные тексты без логических акцентов и подзаголовков. | Автоматическое наполнение с семантическим ядром, обязательное использование H2-H4, маркированных списков. |

| Много возвратов к поиску | Биржи контента: релевантность поверхностная, нет ответа на смежные вопросы пользователя. | Программное расширение LSI-окружения статьи на основе топ-10 выдачи, добавление блока FAQ. |

Оптимизация на основе поведенческих факторов – не разовая акция. Это цикл: генерация контента, замер метрик, точечная корректировка материалов. Автоматизируйте сбор данных, выделяйте проблемные кластеры страниц, правьте шаблоны генерации. Так вы сокращаете рекрол-бюджет, увеличиваете релевантность всего массива текстов.

Итог: Качество копирайтинга определяет не грамматика, а поведение пользователя. Текст, который не читают – мёртвый груз для SEO-сетки. Корректируйте материалы под холодные цифры метрик, а не субъективные ощущения.

TextLog VIP: Подключаем автоматический мониторинг поведенческих факторов вашей сетки. Система сама выявляет проседающие страницы, предлагает гипотезы для правок и обновляет контент по утверждённым шаблонам. Полная аналитика ROI по каждому кластеру доменов.

Вопрос-ответ:

Как определить темы для контента в SEO-сетке, чтобы закрыть все потребности аудитории и поисковые запросы?

Для определения тем потребуется анализ двух ключевых направлений. Первое — это изучение структуры и семантического ядра сайта. Разбейте сайт на логические разделы и категории. Для каждой категории соберите кластер запросов из поисковых систем, включая информационные, коммерческие и навигационные. Второе направление — анализ аудитории. Изучите данные из веб-аналитики, вопросы из обратной связи, обсуждения в тематических сообществах и на форумах. Это поможет понять реальные проблемы и интересы ваших посетителей. Сопоставьте запросы из поиска с потребностями аудитории. В результате вы получите список тем, которые не только привлекут трафик, но и будут действительно полезны читателям, равномерно распределяясь по разделам сайта.

Можно ли использовать один текст для нескольких страниц сетки, чтобы сэкономить время?

Делать этого не стоит. Поисковые системы, такие как Яндекс и Google, могут расценивать дублирующийся или сильно перекрывающийся контент на разных страницах одного сайта как некачественный. Это приводит к проблемам с индексацией: часть страниц может выпасть из поиска, а остальные — потерять позиции. Каждая страница в сетке должна иметь уникальную ценность и отвечать на конкретный запрос пользователя. Повторение информации создает плохой опыт для посетителя, который, переходя по разным ссылкам, видит одно и то же. Вместо копирования лучше создать материалы, которые дополняют друг друга, раскрывая смежные аспекты общей темы.

Какой объем текста нужен для страниц категорий и подкатегорий в SEO-сетке?

Жестких правил по объему нет, он зависит от темы и целей страницы. Для коммерческих категорий, например, страниц с товарами определенного типа, часто достаточно 1500–2500 символов. Этого хватит, чтобы кратко описать преимущества группы товаров, ключевые характеристики и ответить на частые вопросы. Для информационных разделов или сложных тематических категорий тексты могут быть длиннее — от 3000 до 5000 символов и более. Главное — полностью раскрыть тему, которую ожидает увидеть пользователь, перейдя по такому запросу. Текст должен структурировать раздел, помогать в навигации и убедительно подводить посетителя к переходу на более глубокие уровни сайта.

Как связать между собой страницы сетки с помощью контента?

Связывание страниц — важная часть работы. Используйте для этого перелинковку. В текстах на страницах верхнего уровня (например, в разделе «Ремонт квартир») естественным образом добавляйте ссылки на подкатегории («Ремонт кухни», «Отделка стен»). В статьях или карточках товаров ставьте ссылки на обобщающие категории или сопутствующие услуги. Полезно создать блоки «Полезные материалы» или «Читайте также». Второй метод — использовать единые элементы навигации: хлебные крошки, цепочки категорий, фильтры. Третий аспект — смысловая связь. Контент на страницах разного уровня должен логически продолжать друг друга, избегая противоречий в фактах и рекомендациях.

Как часто нужно обновлять контент в существующей SEO-сетке сайта?

Периодичность обновлений зависит от типа информации. Статические данные, такие как описания основных услуг или разделов «О компании», проверяют и корректируют реже — раз в 6–12 месяцев, если не произошло изменений в предложении. Информационные статьи, особенно в быстроразвивающихся областях, требуют более частого пересмотра — раз в 3–6 месяцев. Добавляйте актуальные данные, новые примеры, свежую статистику. При появлении новых товаров или услуг в сетку добавляют новые страницы. Регулярный аудит помогает находить устаревшие материалы, страницы с падающим трафиком или техническими ошибками. Их своевременное исправление поддерживает интерес пользователей и положительно влияет на ранжирование.

Как определить, какие темы и подтемы включать в SEO-сетку, чтобы не упустить важное для аудитории и поисковых систем?

Определение тем для SEO-сетки строится на анализе трех ключевых источников. Первый — семантическое ядро вашего сайта. Соберите и сгруппируйте все поисковые запросы по тематическим кластерам. Каждый крупный кластер станет основной темой (страницей-хабом), а более узкие запросы внутри него — подтемами (вспомогательными статьями). Второй источник — анализ сайтов конкурентов, которые уже ранжируются в топе. Изучите структуру их разделов, какие статьи они публикуют вокруг основной темы. Это помогает увидеть возможные пробелы. Третий и главный источник — потребности вашей аудитории. Используйте вопросы из комментариев, соцсетей, сервисов вроде «Яндекс.Кью» или AnswerThePublic. Например, для темы «ремонт квартиры» подтемами будут не только «укладка плитки», но и «как выбрать мастеров», «составление сметы», «перепланировка» — то, что реально волнует людей перед началом работ. Важно, чтобы каждая подтема логично связывалась с основной темой и покрывала конкретный пользовательский запрос.

Как правильно связать статьи внутри SEO-сетки, чтобы это было полезно читателям и усиливало ранжирование основных страниц?

Связь статей внутри сетки реализуется через перелинковку, которая должна быть контекстной и обоснованной. Основной принцип — иерархический. Страница-хаб (главная тема) должна содержать блок с аннотациями или ссылками на все связанные подтемы (вспомогательные статьи). В свою очередь, каждая вспомогательная статья в своем тексте должна ссылаться на основную страницу-хаб и, при необходимости, на смежные подтемы. Например, в статье «Как выбрать керамическую плитку для ванной» стоит поставить ссылку на хаб «Ремонт ванной комнаты», а также на статью «Технология укладки плитки на пол». Ключевое правило: ссылка должна быть уместной в тексте и предлагать дополнительную ценность. Избегайте общих фраз вроде «читайте также». Вместо этого используйте точные формулировки из текста: «Для укладки потребуется специальный *клей для плитки*, выбор которого мы разбирали отдельно». Такой подход помогает пользователям находить больше полезной информации, увеличивает время на сайте и передает вес ссылок с периферийных страниц на основные, что положительно оценивается поисковыми системами.

Хочешь купить статьи дешево для сайта и блога? Перейти в магазин статей

Нужен современный сайт или лендинг? Заказать создание сайта

Сайт не видно в поиске? Продвинуть сайт в ТОП Яндекс