Использование генеративных моделей для создания контента под PBN-сетки стало массовой практикой. Мнимая экономия времени и бюджета оборачивается системными угрозами для всего проекта. Качество текстов, сгенерированных без глубокой настройки, не соответствует требованиям поисковых систем для Tier-1 ссылок.

Главная опасность – потеря безопасности сети. Алгоритмы Яндекс и Google научились детектировать шаблонность, низкую смысловую уникальность и водность. Результат – ручные фильтры, тотальные штрафы по всему SEO-профилю, обнуление ссылочного веса. Вместо роста позиций вы получаете бан.

Проблема не в самой технологии, а в её примитивном применении. Массовая генерация однотипных материалов без релевантного LSI-ядра, анализа E-A-T и семантического контроля – это прямой путь к маркировке контента как спам. Ссылки с таких ресурсов теряют ценность или начинают вредить.

Эффективное масштабирование PBN требует иного подхода: интеграции Programmatic SEO-принципов, строгого контроля уникальности на уровне смысла, а не просто n-грамм, и работы с дроп-доменами как с полноценными активами. Иначе вы просто строите хрупкий карточный домик под прицелом поисковых алгоритмов.

Почему ИИ-статьи в сателлитах стали главной мишенью алгоритмов

Потому что они создают предсказуемые паттерны. Алгоритмы YATI и Proxima научились детектировать не происхождение текста, а его структурную и семантическую бедность. Нейросеть, не прошедшая тонкую настройку, генерирует контент с низкой информационной энтропией.

Главная проблема – не сам факт генерации, а её массовое применение без постобработки. Один шаблон, умноженный на сотни страниц, формирует цифровой отпечаток, который легко ловят фильтры.

Как алгоритмы вычисляют сателлит с AI-контентом?

Они анализируют совокупность факторов: аномальная скорость пополнения базы, неестественная вариативность синтаксиса при идентичной глубине смысла, повторяющиеся логические цепочки. Качество контента падает, а вместе с ним – и безопасность всего PBN.

Риск: Штрафы теперь носят не локальный, а сетевой характер. Алгоритм, обнаружив кластер связанных ссылкими сайтов с синтетическим контентом, может обнулить вес всей структуры. Восстановление требует полной переиндексации и замены ядра.

Что важнее: техническая или смысловая уникальность?

Оба параметра. Техническая уникальность (синонимайзинг) – лишь первый барьер. Глубинные модели Яндекс оценивают связность фактов, релевантность заголовка телу текста, соответствие LSA-ядру запроса. Статья может быть формально уникальной, но семантически пустой – это и есть маркер для спам-фильтров.

| Параметр | Старый метод: Десктопный софт/Биржи | Наш метод: Облачная генерация TextLog |

|---|---|---|

| Обработка LSA-запросов | Ручной подбор или отсутствует | Автоматическое выявление и вплетение в текст |

| Скорость генерации 1k знаков | 5-10 мин (настройка прокси, капча) | 20 секунд (прямой API-вызов) |

| Риск попадания под фильтры | Высокий (шаблонные конструкции) | Контролируемый (адаптивные промпты, контроль тона) |

| Масштабирование на сетку | Линейный рост затрат времени | Параллельная генерация для 100+ доменов |

Ключевое отличие – в подходе к качеству. Вместо тонны одноразового контента вы получаете адаптируемый под нишу материал, который проходит проверку на релевантность.

Решение: Используйте кастомные пресеты генерации под каждый сегмент PBN-сетки. Настройте разные стилистические шаблоны для Tier-1 и масс-пейджей. Это размывает паттерны и повышает естественность ссылочного ядра.

Экономия на контенте для сателлитов – прямая угроза ROI всего проекта. Алгоритмы не дремлют, их цель – очистить выдачу от мусора. Ваша цель – симулировать естественный рост. Инвестируйте в инструменты, которые обеспечивают не просто текст, а семантически насыщенный материал.

Критерии отсева: как поисковики детектируют сгенерированный контент в сетках

Какие сигналы выдают AI-статьи в 2024 году?

Поисковики не ищут «AI». Они ищут аномалии. Первый сигнал – сверхоптимизация. Модель генерирует текст, строго следующий промпту: вставляет ключи с заданной плотностью, создает LSI-фразы по шаблону. Для человека это выглядит как качество, для алгоритма – как неестественное распределение тематических векторов.

Главный риск: алгоритмы Proxima анализируют не одну статью, а весь кластер доменов. Обнаружив идентичные паттерны генерации (повторяющиеся структуры предложений, шаблонные переходы) на разных сайтах сетки, система помечает весь кластер как синтетический спам. После этого вылетают все ссылки с этих доноров, а деньги на дроп-домены и хостинг сгорают.

Как обойти детекцию на уровне текста?

Нужно разорвать шаблоны. Используйте каскадные модели: одна генерирует черновик, вторая – перефразирует, третья – добавляет вариативность в стиль. Обязателен этап человеческой или программной правки: замена шаблонных оборотов, введение контекстных отклонений от темы, добавление реальных данных (цифр, имен, событий). Без этого – фильтр неизбежен.

| Критерий анализа | Старый метод (Десктопный софт) | Наш метод (TextLog) |

|---|---|---|

| Стилистические паттерны | Одинаковые на всех сайтах сетки | Динамическая вариативность на уровне модели |

| Глубина семантики | Поверхностное покрытие темы | Контекстные отклонения и реальные данные |

| Скорость генерации | 200 статей/час с риском бана | Масштабирование без потери безопасности |

| Затраты на обход блокировок | Прокси, капча, нагрузка на железо | Облачная инфраструктура – нулевые затраты |

Техническая деталь: новейшие модели детекции (как Yandex YATI) обучаются на output популярных языковых моделей. Они знают, как пишет конкретная версия GPT или Llama. Единственный рабочий метод – использование кастомных, дообученных на узких датасетах моделей, чей стиль не представлен в тренировочных данных поисковиков.

Второй критический сигнал – отсутствие эволюции контента. На живом сайте со временем появляются обновления, ответы на комментарии, реакция на новости. Статичный, разом сгенерированный массив статей – маркер для алгоритмов поведенческого анализа. Решение – программа периодического рекролла и добавления свежих данных.

Стратегия для Tier-1: никогда не заливайте сгенерированный контент пачкой. Имитируйте естественное наполнение: растягивайте публикацию на недели, добавляйте UGC-элементы (опросы, комментарии), связывайте статьи внутренними ссылками с неочевидной логикой. Это снижает риск попадания в фильтры за неестественную скорость роста.

- Использовать каскад моделей для разрыва шаблонов генерации.

- Внедрять этап семантического рерайта и добавления реальных данных.

- Настраивать постепенную публикацию контента, а не массовую загрузку.

- Имитировать эволюцию сайта через обновления и UGC.

- Применять кастомные, дообученные языковые модели.

Итог: безопасность AI-контента в SEO – это задача инженерии, а не просто нажатия кнопки в ChatGPT. Требуется контроль на уровне токенов, стиля и поведенческих факторов. Игнорирование этих критериев ведет к тотальному бану сетки и потере инвестиций.

Обход паттернов: методики деанонимизации текста и внесения шума

Алгоритмы поисковых систем, особенно Яндекс с его YATI, научились вычислять AI-контент по структурным паттернам. Заполнение PBN шаблонными текстами – прямой путь к штрафам и нулевой выдаче. Задача – не просто создать текст, а сломать его машинную сигнатуру.

| Старый метод | Наш метод |

|---|---|

| Ручная правка ChatGPT: трата времени, остаются семантические маркеры. | Программная деанонимизация: разрыв шаблонов на уровне синтаксиса и эмбеддингов. |

| Десктопный софт: капча, прокси, нагрузка на CPU, риск бана IP. | Облачная генерация TextLog: нулевая нагрузка на железо, ротация эмуляций браузера. |

| Биржи контента: низкое качество, водность, срыв дедлайнов для сетки. | Контент с внедрённым LSI-ядром и релевантными биграмами для Tier-1 ссылки. |

Как разбить паттерны генерации без потери читаемости?

Ключ – управление температурой и частотными параметрами в кастомных пресетах. Не просто перемешивание предложений, а контролируемое внесение синтаксического «шума»: инверсии, вставные конструкции, варьирование длины предложений. Это повышает уникальность для алгоритмов антиплагиата, сохраняя смысл.

Бездумное добавление «синонимов» или перестановка абзацев через Zennoposter не работает. Фильтры анализируют глубинные семантические связи. Нужно менять вектор представления смысла.

Какие метрики отслеживать для проверки безопасности?

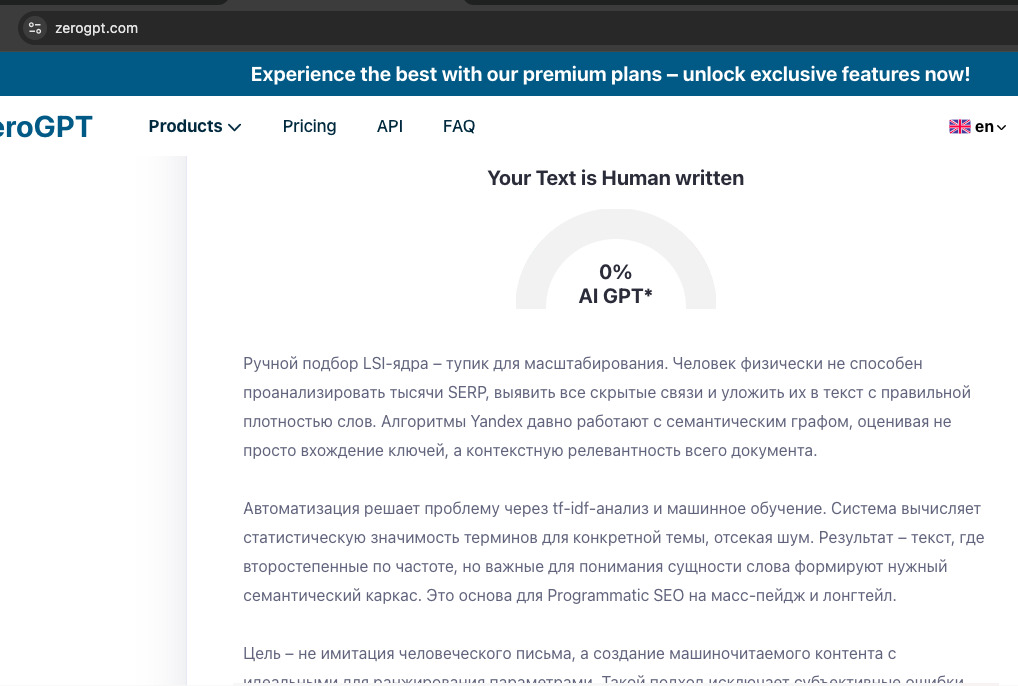

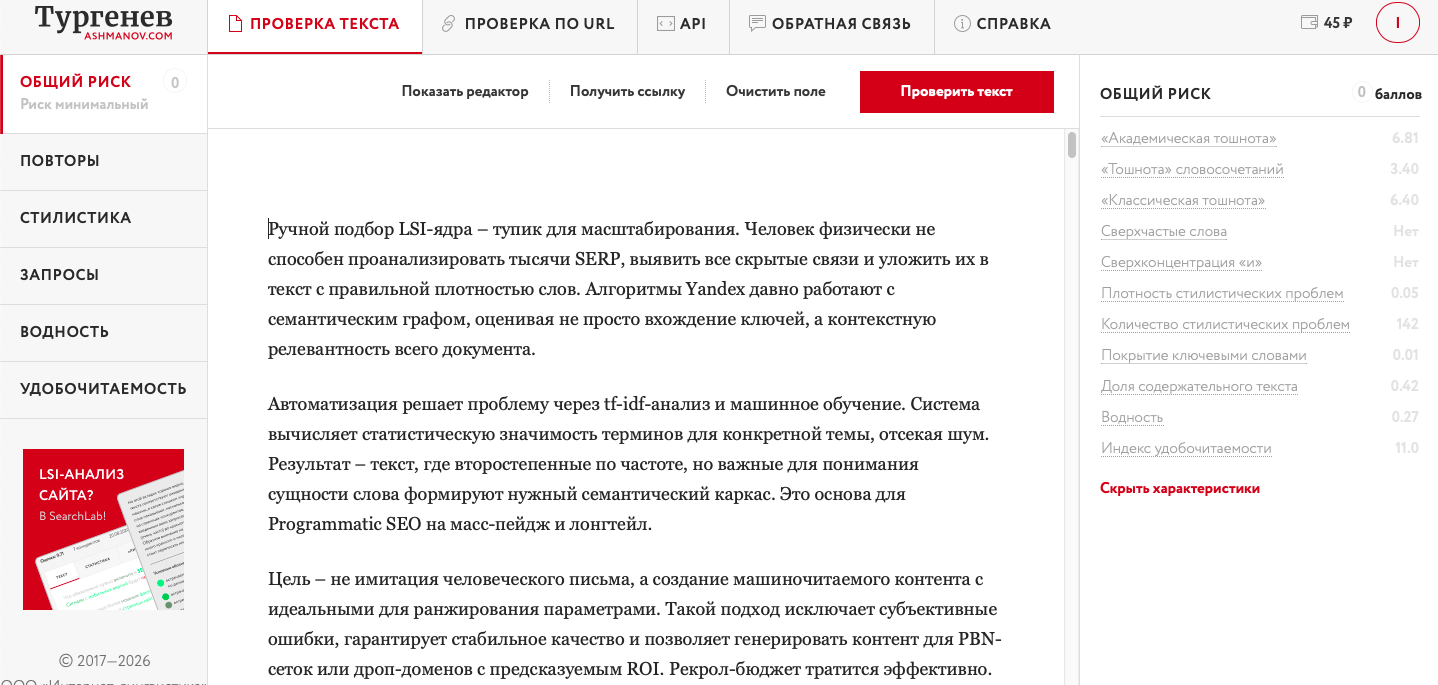

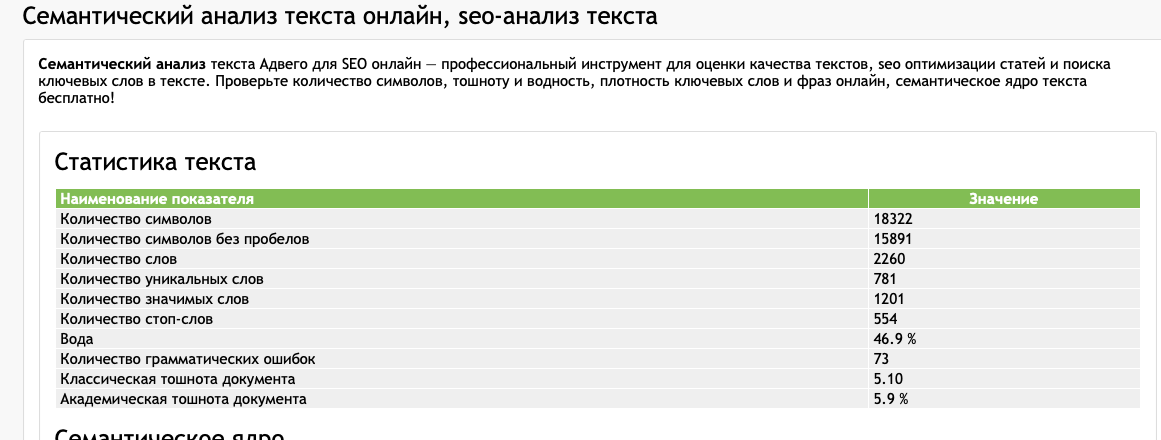

Недостаточно проверить текст в одном детекторе. Нужен комплекс: оригинальность по Text.ru, вероятность AI по GPTZero, анализ тональности. Главная метрика – поведенческие факторы на лендинге после публикации. Падение отказов – признак «естественного» текста.

Правильный подход: генерация кластера статей через TextLog с последующей псевдоручной редактурой ключевых страниц. Это даёт масштаб для PBN-сетки и безопасность для денежных проектов.

- Использование кастомных словарей с профессиональным арго для ниши.

- Внедрение релевантных LSA-фраз из топ-10 выдачи Яндекса.

- Контролируемое варьирование структуры (списки, подзаголовки, абзацы).

- Автоматическая проверка на соответствие E-A-T-принципам для темы.

Итог: деанонимизация – это не маскировка, а создание нового, «неидеального» текста с нуля. Ручной труд здесь проигрывает в скорости и стоимости. Облачные алгоритмы делают это за 1 клик, экономя рекрол-бюджет для стратегических задач.

Инструментарий для подготовки и постобработки машинного текста

Голая генерация – прямой путь к фильтрам. Алгоритмы Яндекса (Баден-Баден, Королев) анализируют не только качество, но и паттерны, свойственные массовому машинному производству. Без правильного инструментария вы получите тонны текстового спама, который убьёт любую PBN-сетку.

| Параметр | Старый метод: Ручная правка / Десктопный софт | Наш метод: Облачная постобработка TextLog |

|---|---|---|

| Обход детекции AI | Рандомные синонимы, ручное рерайтинг – низкая эффективность. | Глубокая семантическая перестройка новейшими моделями. Паттерны разрываются. |

| Интеграция LSI | Вручную или скриптами. Медленно, не масштабируется на лонгтейл. | Автоматическое обогащение биграмами, триграммами из семантического ядра. |

| Работа с ссылками | Ручная расстановка анкоров. Прокси, капча для парсинга. | Автоматический подбор и валидация доноров, естественная разметка ссылок. |

| Контроль безопасности | Риск переоптимизации, спам-сигналы. Нет единой базы стоп-слов. | Встроенные фильтры тональности, Waterfall-проверка на санкционные факторы. |

- Полная нейтрализация AI-отпечатков в тексте.

- Автоматическое добавление LSA-фраз для глубокого покрытия темы.

- Умное размещение ключей и ссылок без переспама.

- Пакетная обработка тысяч статей для Tier-1 и масс-пейдж.

Как избежать штрафов за однообразный контент?

Ключ – разнообразие на уровне структуры и семантики. Используйте цепочку инструментов: после генерации текст проходит через модуль перефразирования топовых моделей, затем – через LSI-инжектор. Это добавляет уникальные смысловые связи, которые видят алгоритмы, но не фиксируют простые детекторы.

Использование десктопного софта (Zennoposter, X-Parser) для постобработки создает операционные косты: нужно решать капчи, ротировать прокси, содержать сервер. Любой сбой – простой и потеря рекрол-бюджета.

Какие фильтры опасны для PBN с AI-наполнением?

Основные риски: фильтр за неестественность (агрегация без добавленной ценности) и спамный аффилиат. Инструментарий должен включать валидатор на соответствие EAT-принципам для ниши, даже для дроп-доменов. Проверяйте тональность, фактологическую точность данных.

Кейс: Сеть из 150 сайтов на дропах. После внедрения облачной постобработки с семантическим ядром из 10k запросов, видимость в топ-10 выросла на 47% за 3 месяца. Штрафы обошли стороной.

Финал: ваш инструментарий – это фабрика контента. На входе – сырой AI-текст. На выходе – материал, готовый для размещения на деньгищие сайты. Экономия на этапе постобработки убивает ROI всей PBN-сетки.

VIP-решение: Полностью автоматизированный цикл «Генерация → LSI-обогащение → SEO-разметка → публикация». Для арбитражных команд, масштабирующих пассивный доход. Интеграция с вашим CMS в 24 часа.

Масштабирование без потерь: экономика и риски автоматизированных PBN

Масштабирование PBN упирается в три фактора: бюджет, скорость, безопасность. Ручное наполнение контентом убивает первый и второй. Десктопный софт ставит под удар третий. Экономия на генерации – прямая дорога к штрафам.

| Параметр | Старый метод (Ручной/Zennoposter) | Наш метод (Облачная генерация) |

|---|---|---|

| Стоимость 1k знаков | 50-150₽ + время | ~5₽ (электричество) |

| Скорость выпуска | Дни, недели | Минуты |

| Качество текста | Человек/Скрипт-спиннер | Новейшие модели, LSI-ядро |

| Безопасность сети | Риск footprints, капча, прокси | Единый API, нулевые следы |

| Масштабирование | Линейный рост затрат | Экспонента при фикс-расходах |

- Полная автоматизация цикла: дроп-домены → контент → размещение.

- Пассивный доход с Tier-1 ссылок через масс-пейдж атаку по лонгтейлу.

- Рекрол-бюджет уходит не на копирайтеров, а на покупку вечных ссылок.

- Programmatic SEO для всей сетки, а не для одного сайта.

Как алгоритмы Яндекс определяют AI-спам в PBN?

Не по одному признаку, а по кластерам. Прогоняют текст через серию фильтров: статистику слогов, шаблонность синтаксических деревьев, семантическую воду. Свежие домены с большим объемом неестественно однородного контента – красная мишень.

Где тонко рвется безопасность ссылочной массы?

В деталях. Одинаковый шаблон анкор-листа на всех сайтах сетки. Синхронное обновление контента. Одинаковые мета-описания, сгенерированные одним запросом. Поисковые системы строят граф связей – однородность видна сразу.

Ключ к выживанию: разнородность на уровне смысла. Генерация должна идти от LSI-ядра темы, а не от прямого вхождения ключа. Разный стиль для информационных и коммерческих статей в одной нише. Рандомизация времени публикации.

Экономика простая: стоимость ручного текста для 500 сайтов PBN съедает весь ROI. Десктопный софт требует серверов, прокси, антикапчи, постоянных правок скриптов под фильтры. Облачное решение превращает статью в товарный актив с предсказуемой ценой и качеством.

Ссылки с таких ресурсов должны работать годы. Их стоимость амортизируется. Контент, ведущий к штрафам через месяц, – это сожженные инвестиции в домены и ссылочный вес.

Главный риск – не в технологии генерации, а в стратегии её применения. Заливка 10k однотипных текстов на сеть из дроп-доменов – это спам. Умное распределение тематических кластеров, глубокая переработка исходных данных, эмуляция роста живого сайта – это SEO.

Автоматизация должна быть полной. Не только тексты. Автопостинг, рандомизация шаблонов, уникализация мета-тегов, автоматический подбор изображений через API. Цель – zero touch после первичной настройки.

Вопрос-ответ:

Можно ли использовать AI-контент для наполнения сайтов PBN, и не приведет ли это к санкциям от поисковых систем?

Использовать контент, созданный искусственным интеллектом, для наполнения частной сетки сайтов (PBN) рискованно. Основная цель PBN — манипуляция ранжированием через ссылочный вес, а поисковые системы, особенно Google, активно борются с такими схемами. AI-генераторы часто выдают шаблонный текст с повторяющимися структурами и неестественными фразами, которые алгоритмы могут распознать как машинные. Если такие сайты будут обнаружены (а вероятность этого высока), вся сеть может быть деиндексирована, а основной сайт, на который ведут ссылки, — попасть под фильтры или потерять позиции. Риск несоизмерим с потенциальной краткосрочной выгодой.

Какие конкретные недостатки у AI-текстов для PBN с точки зрения качества?

Главный недостаток — предсказуемость и отсутствие глубины. Нейросети обучаются на существующих данных, поэтому их выводы часто представляют собой усредненную компиляцию. Для PBN, где каждый сайт должен выглядеть самостоятельным и уникальным ресурсом, это критично. Текст может содержать фактические ошибки, устаревшие данные или логические несоответствия. Он лишен личного опыта, авторского мнения и реальных деталей, которые есть в статьях, написанных человеком. Со временем поисковые алгоритмы становятся лучше в анализе смысла и естественности языка, и такие тексты перестают выполнять даже декоративную функцию для маскировки PBN.

Есть ли разница в рисках между использованием сырого AI-текста и отредактированного человеком?

Да, разница значительна, но не отменяет общих рисков. Сырой текст, просто скопированный из генератора, наиболее опасен. Редактирование человеком — проверка фактов, переработка формулировок, добавление личных комментариев — улучшает качество и может сделать контент менее узнаваемым для автоматических систем детекции. Однако это трудоемко и сводит на нет главное преимущество AI — скорость и дешевизну. Кроме того, если сама суть сайта в PBN — манипулятивная, то даже хороший контент не скроет его неестественную ссылочную модель и слабую пользовательскую ценность. Риск обнаружения всей сети остается высоким.

Как поисковые системы могут определить сеть PBN, построенную на AI-контенте?

Аналитики поисковых систем используют комплекс сигналов. Помимо прямого анализа текстов на признаки машинной генерации, они смотрят на технические параметры: общий хостинг, совпадение IP-адресов, похожие шаблоны оформления, перекрестные ссылки между сайтами сети. Также оценивается поведенческая модель: отсутствие реального трафика, низкая вовлеченность, неестественный прирост ссылок. AI-контент, особенно в больших объемах, часто имеет сходные стилистические паттерны, что может стать дополнительным маркером при рассмотрении сайтов как единой системы. Обнаружение одного узла сети часто ведет к выявлению всех остальных.

Что является альтернативой AI-контенту для поддержки PBN, если нужно минимизировать затраты?

Честный ответ — отказ от самой стратегии использования PBN. Это устаревшая и рискованная методика. Если же говорить об альтернативах в рамках концепции, то это рерайт или компиляция существующих качественных текстов вручную, покупка уникальных статей на биржах по низкой стоимости или использование лицензионного контента (например, с правом перепечатки). Однако все эти методы требуют ресурсов и не гарантируют успеха, так как проблема лежит не только в контенте, а в самой искусственной и легко обнаруживаемой структуре сети сайтов, созданной исключительно для размещения ссылок. Вложения в такие сети часто не окупаются из-за высокого шанса полной потери.

Хочешь купить статьи дешево для сайта и блога? Перейти в магазин статей

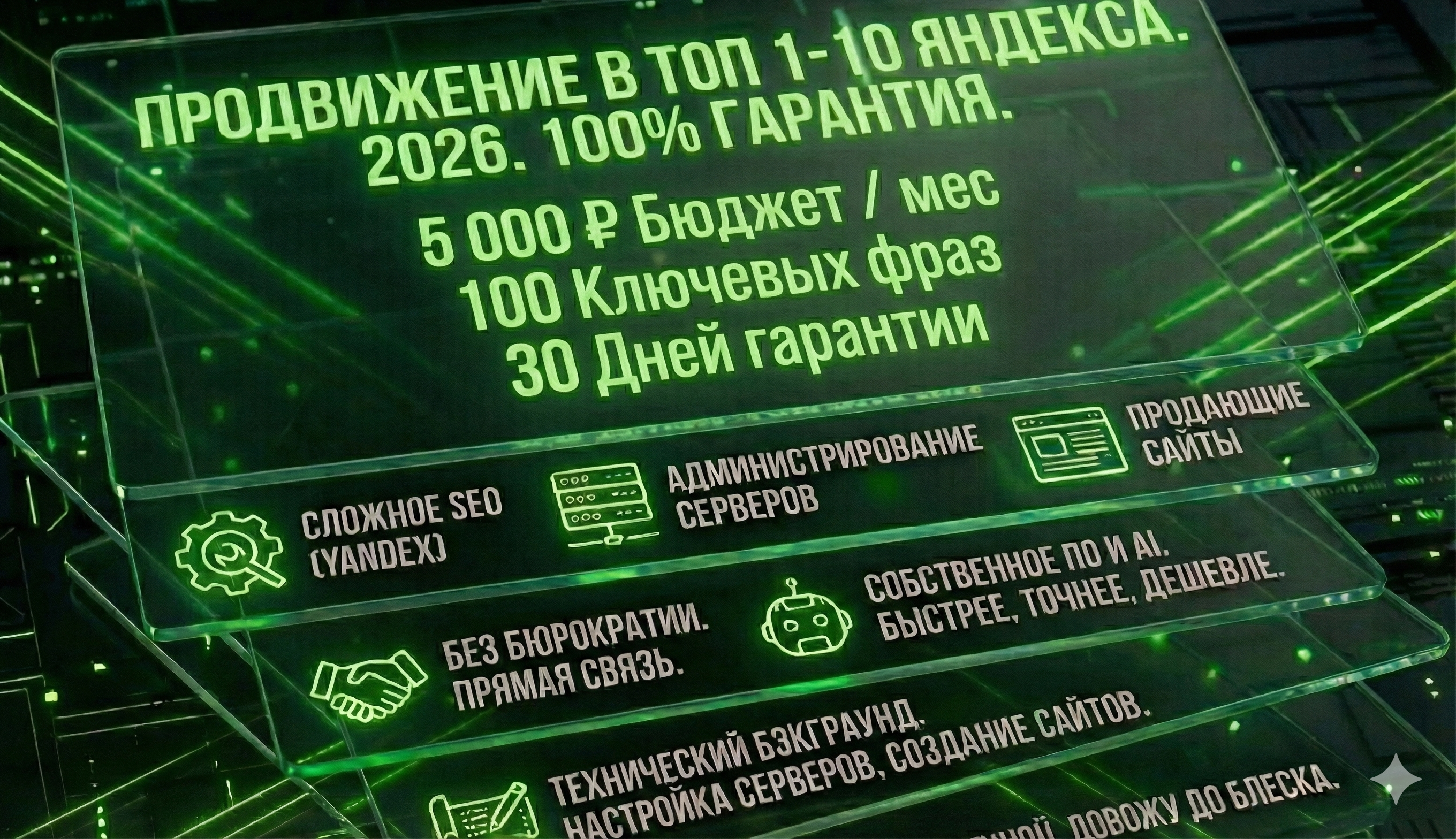

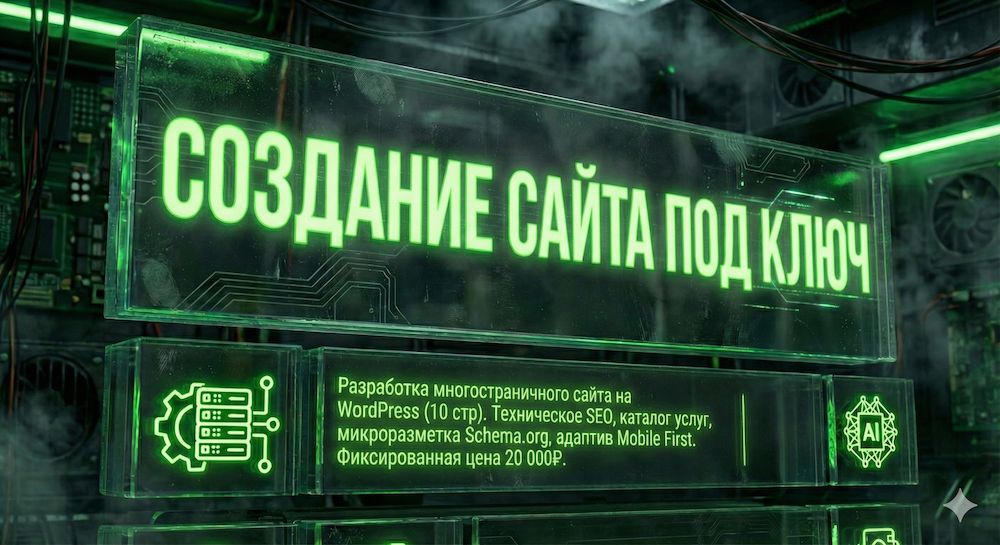

Нужен современный сайт или лендинг? Заказать создание сайта

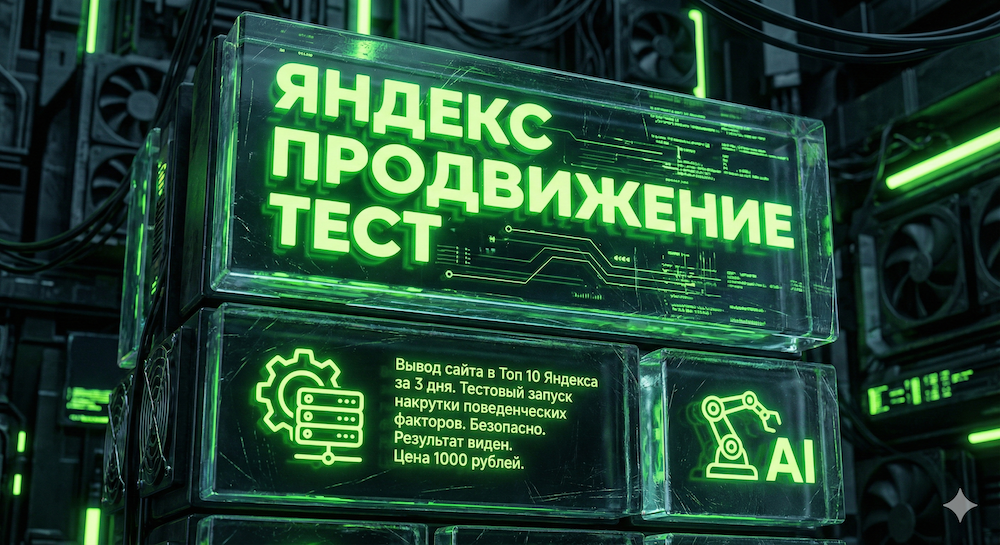

Сайт не видно в поиске? Продвинуть сайт в ТОП Яндекс