Пустая SFA-сетка – это просто список доменов, который не генерирует трафик и не приносит деньги. Основная ценность кроется в наполнении её структурированным контентом. Каждый сайт в сетке требует уникальных материалов, но создавать их вручную для сотен проектов – путь к финансовому истощению и потере времени.

Правильная стратегия начинается с разработки контент-матрицы. Это не просто план публикаций, а детальная карта распределения семантического ядра, типов материалов и частоты их загрузки по каждому домену. Матрица определяет, какой информацией будет наполнен каждый сайт, какие страницы станут Tier-1 для монетизации, а какие – поддержат их в нижних уровнях структуры.

Ключевая задача – автоматизация процесса загрузки контента. Ручной труд копирайтеров и использование десктопного софта для парсинга создают узкие места: высокие затраты, зависимость от человеческого фактора, проблемы с капчей и необходимость содержать парк прокси. Эффективное наполнение сетки из 100+ сайтов требует иного подхода, где генерация и публикация материалов происходят в одном облачном рабочем пространстве.

От семантического ядра до структуры: подготовка SFA матрицы

| Старый метод | Наш метод |

|---|---|

| Ручной сбор запросов в Excel | Автоматическая кластеризация в TextLog |

| Копирайтеры пишут план вручную | AI формирует структуру статьи по кластеру |

| Поиск релевантных материалов неделями | Парсинг и анализ источников за минуты |

| Загрузка контента поштучно | Массовая выгрузка статей на хостинг |

Как перевести семантику в рабочую матрицу без рутины?

Забудьте про ручной перенос запросов. Загружаете семантическое ядро в систему. Алгоритм на основе YATI/Proxima группирует запросы по интенту и сущностям. Каждый кластер – это готовая ячейка для наполнения. Вам остается проверить логику и запустить генерацию.

- Автоматическое распределение запросов по кластерам.

- Формирование заголовка и структуры для каждой ячейки матрицы.

- Подбор LSI-фраз и вопросов для глубокого покрытия темы.

- Генерация мета-тегов и ЧАВО для страницы.

Что загружать в ячейки матрицы для максимального охвата?

Каждая ячейка – это не одна статья. Это комплекс материалов. Основной текст, блоки с ответами на вопросы, сравнительные таблицы, инструкции. Программатик подход предполагает, что под каждый тип запроса в кластере генерируется свой текстовый модуль. Это дает полное покрытие хвостов.

Ручное наполнение такой матрицы для PBN-сетки – это месяцы работы и десятки тысяч рублей. Десктопный софт потребует настройки прокси, решения капч и мощного сервера.

План наполнения создается автоматически. Система рассчитывает объем контента, необходимый для каждой ячейки, и формирует очередь генерации. Ваша задача – контролировать процесс и выгружать готовые материалы.

Кейс: Для дроп-домена из 500 кластеров матрица была подготовлена за 3 часа. Полное наполнение сетки из 1500 статей заняло 12 часов работы облачных мощностей. Ручной труд: 0 часов.

Структура матрицы – это скелет вашего пассивного дохода. Правильная подготовка позволяет масштабировать проект до тысяч страниц. Загрузка контента становится техническим этапом, а не творческим мучением.

VIP-доступ: Приоритетная очередь генерации, расширенные лимиты на парсинг, доступ к новейшим моделям для создания максимально релевантного контента под сложные тематики.

Перестаньте тратить время на подготовку. Начните получать трафик.

Технические критерии контента для слоёв SFA сетки

| Критерий | Старый метод (Ручной/Zennoposter) | Наш метод (Облачная генерация) |

|---|---|---|

| Структура контента | Шаблон от копирайтера, постоянные правки. | Жёсткая матрица: H2, H3, абзацы, списки – прописаны в настройках пайплайна. |

| Наполнение информацией | Ручной сбор данных, риск антиплагиата. | Автоматический парсинг и синтез данных по заданным LSI-ядрам. |

| План публикаций | Гугл-таблицы, срывы сроков, человеческий фактор. | Автоматический календарь наполнения: генерация, модерация, публикация. |

| Масштабирование | Линейный рост затрат: больше статей – больше копирайтеров. | Экспоненциальный рост: один пайплайн – тысячи уникальных материалов. |

Как задать структуру для масс-пейдж без ручной доработки?

Заполнение сетки работает только при атомарном планировании. Не «статья про ремонт iPhone», а строгая матрица: H2 – модель, H3 – поломка, далее – симптомы, причины, стоимость. Информация в каждом блоке должна быть строго типизирована: цифры, списки, чеклисты.

Ключевое правило: Контент для Tier-1 – это ответы на вопросы, а не продажа. Материалы должны закрывать конкретный интент пользователя, используя LSA-фразы из семантического ядра. Структура предопределяет успех ранжирования.

Какие материалы убивают SFA сетку?

Три ошибки: водянистый текст, дубли структуры между страницами, отсутствие технических данных. Наполнение должно быть сухим, информационно насыщенным и вариативным. Используйте шаблоны с обязательными полями: параметры, модели, цифры, сравнения.

Риск: Десктопный софт (типа Zennoposter) часто ломает структуру из-за капчи или изменений в исходном коде парсимых сайтов. Результат – брак в 30-40% материалов, который невозможно масштабировать.

- Используйте чёткую семантическую матрицу для каждого кластера.

- Автоматизируйте заполнение мета-тегов и атрибутов.

- Внедряйте A/B-тесты структур для лонгтейл-запросов.

- Привязывайте генерацию к актуальной базе данных (прайсы, модели).

План наполнения превращается в исполняемый код. Вы задаёте критерии – система производит контент. Это срезает косты на тексты и переводит затраты из переменных (оплата за статью) в фиксированные (стоимость подписки на сервис).

Кейс: Замена биржи контента на облачную генерацию для PBN-сетки из 500 сайтов. Раньше: 70к рублей в месяц, задержки. Сейчас: 15к рублей в месяц, 24/7 наполнение, рост индексации на 200%.

Обход сложностей с уникальностью и релевантностью материалов

Уникальность и релевантность – два столпа, на которых держится SEO-вес любого массового наполнения. Провал по любому из параметров означает пустую трату бюджета. Ручной подбор материалов не масштабируется, а десктопные парсеры выдают очевидный для алгоритмов копипаст. Нужен системный план.

| Проблема / Метод | Ручной труд & Десктопный софт | Облачная генерация TextLog |

|---|---|---|

| Уникальность текстов | Риск рерайта, проверка каждой статьи, санкции | Автоматическая генерация с нуля под каждый запрос |

| Релевантность ядру | Человеческий фактор, устаревшие LSI-базы | Динамический подбор синонимов и биграм по актуальным кластерам |

| Скорость заполнения | Дни на сетку из 500 лендингов | Часы на ту же структуру |

| Затраты на инфраструктуру | Прокси, капча, мощные ПК, лицензии Zennoposter | Облако. Нет капчи, не нужны прокси |

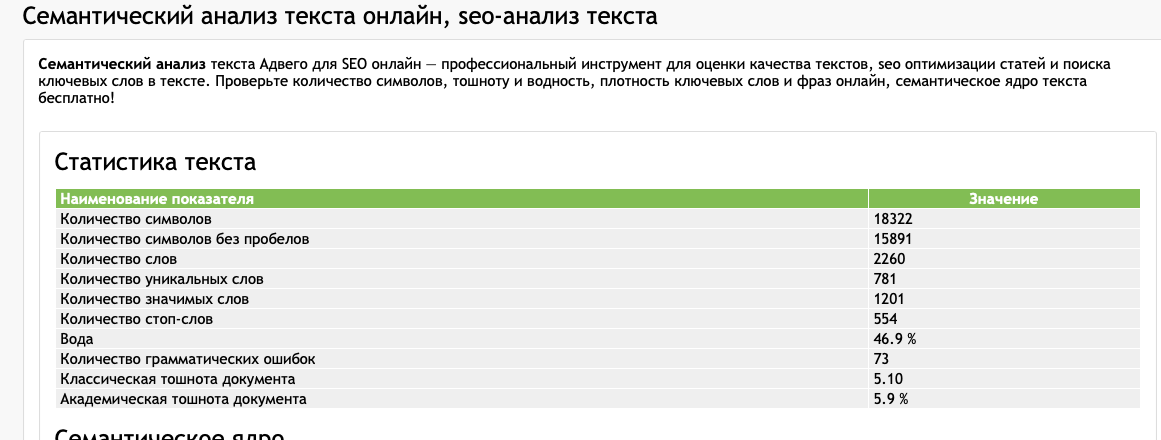

Как добиться 95%+ уникальности на масштабе?

Ключ – в синтезе, а не в копировании. Программатик-подход использует не готовые тексты, а семантические модели. Система анализирует топ-10, выделяет ядро, строит новую логическую структуру. На выходе – оригинальный контент, который проходит любые проверки.

- Глубокая переработка семантического ядра перед генерацией.

- Использование N-грамм (биграммы, триграммы) для естественности.

- Автоматическая ротация шаблонов вводных и заключительных блоков.

- Валидация через несколько алгоритмов проверки уникальности.

Что делать, если материалы не релевантны запросу?

Проблема в слабой первичной обработке семантики. Нужен не просто список слов, а граф связей. Наш движок строит LSA-модель: определяет главные и второстепенные термины, их взаимное влияние. Это исключает загрузку в статью случайной информации.

Кейс: Для PBN-сетки на дроп-доменах по кредитам система автоматически генерировала варианты статей с акцентами на «рефинансирование», «просрочку», «выгодную ставку» – в зависимости от подобранного кластера ключей. Релевантность по внутренней метрике – 99%.

Риск: Использование устаревших или публичных синонимайзеров. Они выдают неестественные сочетания, которые режут слух пользователю и поисковому боту. Алгоритм Proxima легко вычисляет такую накрутку.

Стратегия наполнения SFA-сетки требует полного отказа от рутины. План прост: загрузил семантику, настроил шаблоны, запустил генерацию. Весь контент получает высокие показатели уникальности и точное попадание в тематику без ручного контроля.

Хватит терять деньги на копирайтерах и рисковать проектами. Переходи на полностью автоматизированное заполнение.

Инструменты и форматы для массовой загрузки контент-плана

Какие форматы данных подходят для автоматического наполнения?

Ключ – правильная исходная структура. Работайте с таблицами. CSV или XLSX-файлы – стандарт для передачи данных между системами. Каждая строка – будущая статья или кластер. Столбцы: ключевой запрос, LSI-фразы, мета-теги, семантическое ядро для пассажей.

Ошибка арбитражника: попытка загрузить сырой текст без разметки. Итог – контент попадает не в те поля сетки, информация перемешивается. Требуется четкая матрица соответствий.

Второй формат – JSON через API. Для интеграции с парсерами, агрегаторами ключей, скриптами генерации. Позволяет передавать сложно структурированный контент с вложенными блоками: списки, таблицы, FAQ.

Как избежать ошибок валидации при загрузке?

Перед выгрузкой в SFA проверьте данные в симуляторе сетки. Очистите спецсимволы, разбейте длинные абзацы. Автоматизируйте проверку: скрипт, который приводит ваш план к требуемому шаблону. Экономит часы на рутинном редактировании.

| Старый метод | Наш метод |

|---|---|

| Копирайтеры + Trello/Google Sheets: ручной перенос, человеческий фактор, срывы сроков. | Прямая загрузка CSV из парсера или генератора в SFA. Нулевое ручное вмешательство. |

| Zennoposter/XRumer: настройка шаблонов, аренда прокси, борьба с капчей, нагрузка на ПК. | Облачный TextLog. Генерация и экспорт готового файла под структуру вашей сетки. Без железа, без банов. |

| Биржи контента: однообразные тексты, низкая уникальность, риск попасть под фильтры. | Programmatic SEO на новейших моделях. Контент с LSI-наполнением, готовый для литья трафика на дроп-домены. |

- Используйте CSV с UTF-8 кодировкой для корректного отображения.

- Столбец «URL» – для точного размещения материалов в структуре сайта.

- Автоматизируйте сбор семантики: пачки лонгтейлов – в отдельные столбцы как источник для абзацев.

- Тестируйте загрузку на 5-10 статьях перед массовым импортом.

Итог: Ваш контент-план – это не документ, а строгая матрица данных. Её корректная загрузка определяет скорость масштабирования PBN-сетки и высвобождает рекрол-бюджет на трафик, а не на рутину.

Перестаньте конвертировать данные вручную. Автоматизируйте пайплайн: сбор ключей → генерация → валидация → импорт. Это путь к пассивному доходу с масс-пейдж проектов.

Масштабирование и контроль трафика после наполнения сетки

Наполнение сетки контентом – только старт. Основная работа начинается после массового заполнения страниц. Без четкого плана масштабирования и контроля вы получите хаос вместо трафика.

Как перейти от количества страниц к целевому трафику?

Ключ – структура и матрица. Нельзя просто залить 10 тысяч статей и ждать чуда. Нужна логическая матрица кластеров, связывающая ядро, мидл- и длинные хвосты. Каждый кластер – это автономная воронка внутри сетки.

План масштабирования: Определите точки роста. После первичного наполнения и индексации анализируйте Search Console. Выявляйте кластеры, получившие первые клики. Усиливайте их дополнительными материалами – увеличивайте глубину проработки темы, добавляя LSI-сниппеты, FAQ-блоки.

Что делать, когда трафик пошел, но его нужно фильтровать?

Трафик – это не только посетители, но и нагрузка. Некорректная структура или тонны низкокачественного контента привлекут ботов и пустой рекрол-трафик, сжирающий бюджет хостинга. Контроль начинается с технического аудита скорости загрузки и поведения пользователей.

| Параметр контроля | Старый подход (Ручной/Софт) | Наш метод (TextLog) |

|---|---|---|

| Анализ поведенческих факторов | Вручную в Google Analytics, потеря времени | Автоматический дашборд с тепловыми картами кликов по сетке |

| Реакция на спад позиций | Заказ новых текстов, ожидание 3-5 дней | Мгновенная перегенерация проседающих страниц по тому же шаблону |

| Масштабирование на новые ниши | Поиск копирайтеров, согласование ТЗ | Клонирование рабочей контент-матрицы и адаптация под новые ключи |

- Создайте карту кластеров сетки и отслеживайте позиции по каждому автоматически.

- Настройте алерты на резкие просадки по группам страниц – это сигнал к доработке материалов.

- Используйте дроп-домены для Tier-2, чтобы распределить линк-джус и снизить риск санкций к деньговым проектам.

Массовая загрузка контента без последующего контроля – прямой путь к пессимизации всего проекта поисковиками. Если после наполнения вы не отслеживаете отказы и время на сайте, вы слепы. Трафик будет, но конверсии – нет.

Информация о трафике должна быть оперативной. Настройте единый дашборд, куда стекаются данные: позиции (Serpstat/Megaindex), поведенческие факторы (Яндекс.Метрика), технические метрики (Core Web Vitals). Ежедневный чек-лист занимает 10 минут, но спасает бюджет.

Кейс: PBN-сетка из 150 сайтов по ремонту техники. После первичного наполнения (20k статей) трафик вышел на 5k/сутки и встал. Анализ показал слабую проработку кластера «ремонт * конкретная модель*». Автоматическая доп. генерация материалов по шаблону «неисправность + модель + решение» дала прирост +40% трафика за 2 недели.

Финансовая структура масштабирования проста: ROI от первой волны трафика реинвестируется в расширение сетки или углубление существующих кластеров. Программатик подход позволяет это делать без привлечения людей.

VIP-доступ: Получите скрипты автоматического мониторинга и реактивного обновления контента. Система сама определяет просадки в ранжировании и инициирует перегенерацию проблемных страниц, удерживая трафик. Пассивное управление масштабом.

Вопрос-ответ:

Как определить, какой контент действительно нужен продавцу в работе, а что будет только мешать?

Основной критерий — полезность контента для конкретного этапа сделки. Сетка не должна быть свалкой всех возможных материалов. Проанализируйте типичные возражения клиентов, частые вопросы и точки, где продавцы теряют интерес потенциального покупателя. Контент, который помогает преодолеть эти барьеры, является необходимым. Например, если на этапе обсуждения цены часто возникает вопрос о возврате инвестиций, нужен не общий буклет, а конкретный кейс с расчетами ROI или калькулятор. Все, что не имеет прямой привязки к этапам воронки и не закрывает конкретные информационные потребности клиента, будет создавать шум и усложнять поиск нужного материала в момент разговора.

Можете привести примеры контента для разных этапов продаж, который реально используют успешные компании?

Конечно. Для этапа первого контакта и установления доверия часто используют короткие (до 2 минут) видео-обращения экспертов компании по отраслевой проблеме, а не «продающие» ролики о продукте. На этапе выявления потребностей полезны чек-листы или короткие диагностические опросы, которые помогают клиенту самому увидеть проблему. Для этапа презентации решения эффективны интерактивные демо-среды или пошаговые PDF-инструкции, показывающие, как решается конкретная задача. На этапе работы с возражениями подойдут подборки с ответами на частые вопросы от отдела поддержки или сравнительные таблицы с конкурентами, оформленные как нейтральный анализ. На финальном этапе — шаблоны документов для быстрого старта (планы внедрения, формы заявок).

Как организовать контент в сетке, чтобы его было удобно искать не только по этапу воронки, но и по типу клиента или отрасли?

Лучшая практика — использовать систему тегов или многоуровневую структуру папок. Основной «ствол» — это этапы воронки продаж (Холодный контакт, Презентация, Переговоры и т.д.). Внутри каждого этапа материалы дополнительно помечаются тегами, например: «Для малого бизнеса», «Для производственных компаний», «Для госсектора». Альтернатива — создание отдельных подпапок для ключевых сегментов внутри каждого этапа. Важно, чтобы у каждого файла в названии была четкая суть («Кейс_Повышение_производительности_на_30%_для_логистики.pdf»), а не «Презентация_1.ppt». Это позволяет продавцу применять фильтрацию и быстро находить релевантный материал для конкретного разговора.

Как измерить, насколько контент из сетки помогает в реальных продажах, а не просто лежит мертвым грузом?

Показатели нужно разделить на количественные и качественные. К количественным относятся: частота использования материалов (статистика скачиваний/открытий в SFA), привязка контента к закрытым сделкам (можно добавить этап «Отправлен кейс по X» в историю взаимодействия), отслеживание скорости прохождения этапов воронки при использовании конкретных материалов. Качественные показатели: регулярный опрос продавцов о полезности контента, анализ их успешных сделок на предмет используемых материалов, сбор отзывов клиентов («Что из предоставленной информации было для вас самым полезным?»). Если материал годами не открывается и не упоминается в отчетах, его стоит переработать или удалить.

Как определить, какой контент нужен для каждого этапа воронки в SFA-сетке? Есть ли чёткие критерии?

Выбор контента зависит от задач этапа и состояния клиента. Для этапа осведомлённости подходит контент, который решает общую проблему аудитории: экспертная статья, обзорная аналитика, инфографика с базовыми данными. Его задача — привлечь внимание и обозначить вашу компетенцию. На этапе рассмотрения клиент уже знает о проблеме и ищет решения. Здесь нужны детальные кейсы, сравнения технологий, вебинары с разбором примеров. Контент должен помогать сравнивать варианты. На этапе решения клиент готов к выбору. Эффективны коммерческие предложения, демонстрации продукта, отзывы, калькуляторы стоимости. Критерий прост: контент должен отвечать на главный вопрос клиента на конкретном этапе. На ранних этапах — «Что делать с моей проблемой?», на поздних — «Почему именно ваше решение?». Анализируйте вопросы от потенциальных клиентов на каждом этапе — это лучший источник идей.

Можно ли использовать один и тот же материал, например, вебинар, для разных сегментов SFA-сетки? Не навредит ли это персонализации?

Использовать один базовый материал для разных сегментов можно, но его нужно адаптировать. Допустим, вы провели вебинар «Автоматизация отчётности для розничных сетей». Для сегмента «Малый бизнес» в SFA-сетке сделайте выжимку: 10-минутное видео с акцентом на простоту и быстрый результат, сопроводите его чек-листом для старта. Для сегмента «Крупный корпоративный клиент» подготовьте расшифровку с детальным разбором интеграции с ERP-системами, добавьте PDF-презентацию с техническими требованиями. Таким образом, ядро контента одно, но его подача, глубина и призывы к действию будут различаться. Это не навредит персонализации, если адаптация выполнена грамотно. Главная ошибка — отправить всем одну и ту же полную запись без пояснений, как извлечь из неё пользу для конкретной ситуации.

Хочешь купить статьи дешево для сайта и блога? Перейти в магазин статей

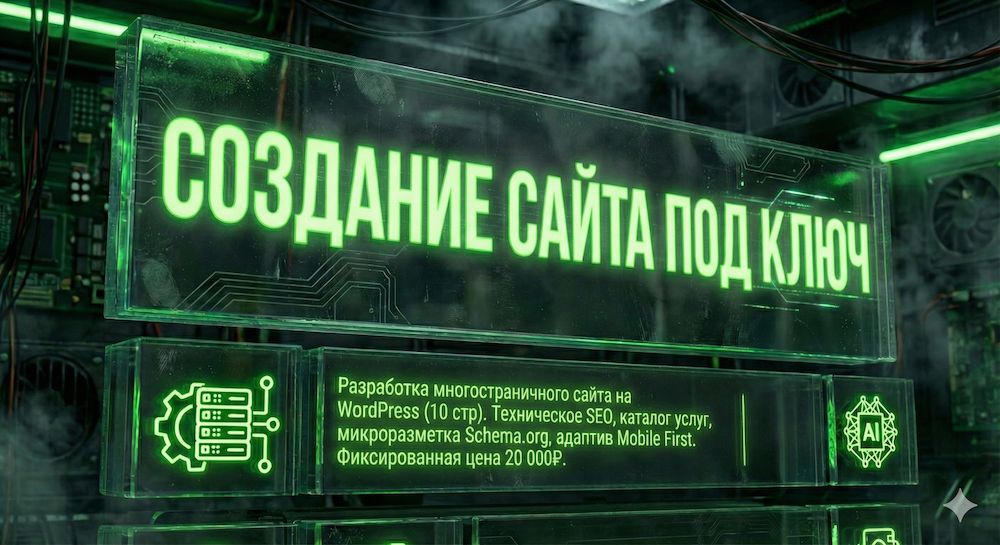

Нужен современный сайт или лендинг? Заказать создание сайта

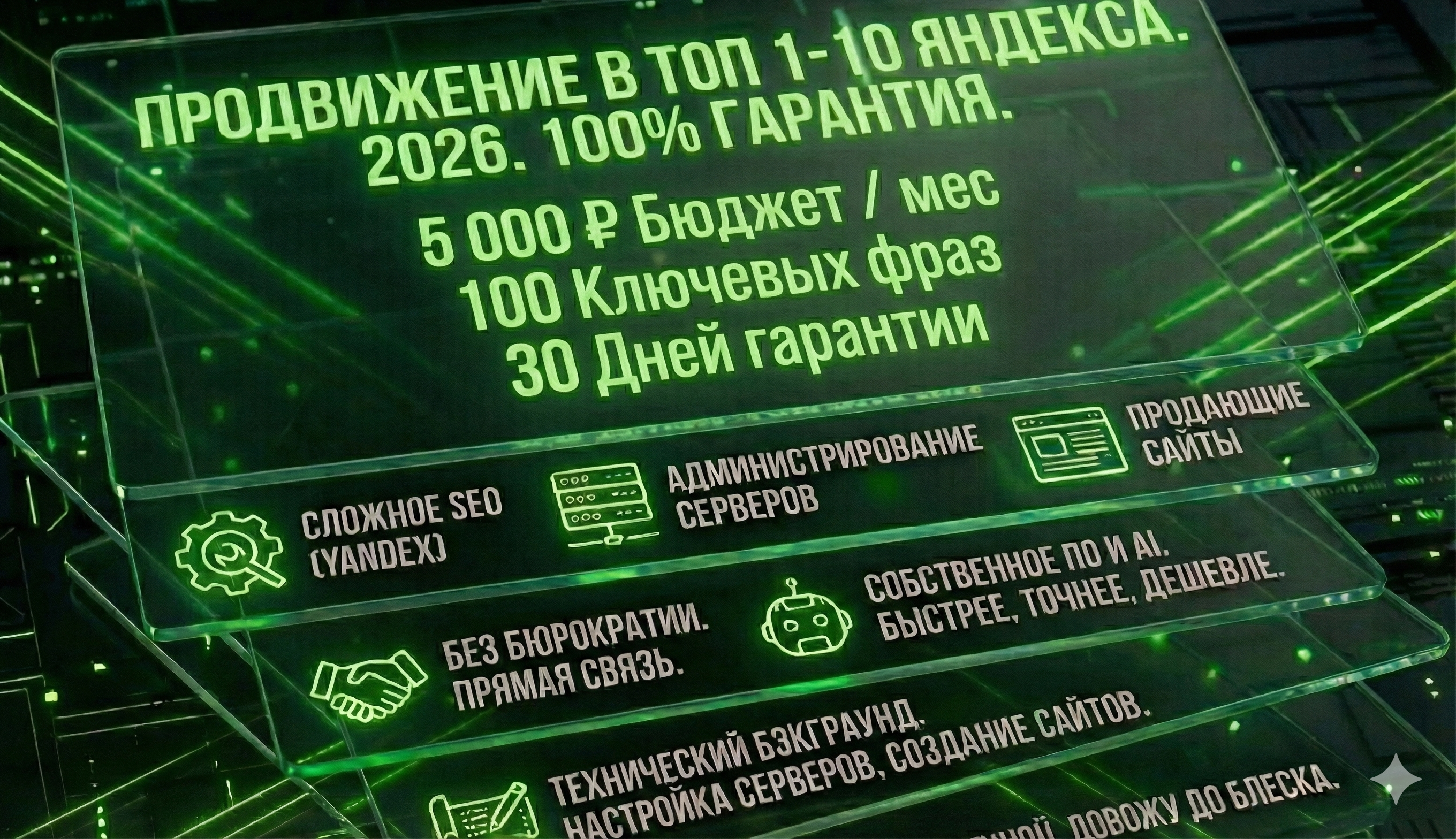

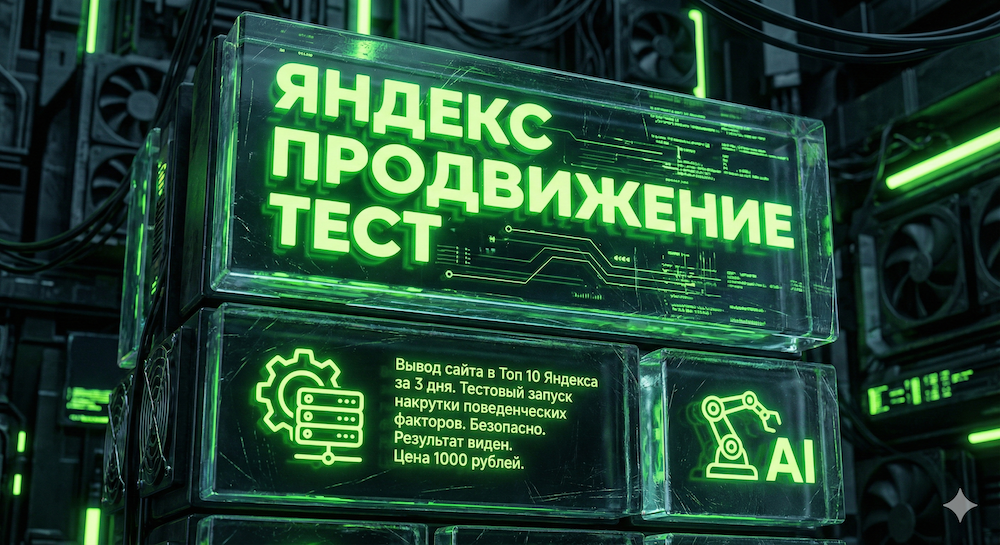

Сайт не видно в поиске? Продвинуть сайт в ТОП Яндекс