Публикация неуникального контента – прямой путь к фильтрам. Поисковые системы, особенно Яндекс с его алгоритмами Баден-Баден и Минусинск, давно научились вычислять заимствования. Ваша задача – не просто рерайтинг, а глубокая переработка смысла с учетом поискового спроса.

Классический копирайтинг подразумевает создание материала с нуля. В реалиях масштабирования PBN-сеток или Tier-1 проектов этот подход экономически несостоятелен. Нужна системная адаптация существующих текстов под новые запросы без потери читабельности и SEO-веса.

Оптимизация здесь начинается с анализа ядра и заканчивается технической интеграцией. Каждый этап – от подбора синонимов до перестройки структуры – должен работать на конечный результат: рост трафика и снижение рекрол-бюджета на контент.

Уникализация текстов для сайтов: полное руководство по SEO-копирайтингу

Ручной копирайтинг для PBN-сетки из 500 сайтов съедает месяцы и бюджеты. Десктопный софт требует прокси, капчи и мощного железа. Уникализация превращается в рутину, а не в инструмент масштабирования.

| Параметр | Старый метод (Ручной/Zennoposter) | Наш метод (TextLog) |

|---|---|---|

| Скорость генерации | 5-10 статей/день | 200+ статей/час |

| Затраты на инфраструктуру | Прокси, сервера, софт | 0 ₽ (облако) |

| Риск банов | Высокий (капча, IP) | Отсутствует |

| Масштабирование | Линейный рост затрат | Падение стоимости за единицу |

- Полная автоматизация публикации на масс-пейдж и Tier-1.

- Глубокая LSI-оптимизация под поисковый алгоритм Яндекс.

- Работа с дроп-доменами: мгновенное наполнение контентом.

- Формирование рекрол-бюджета за счёт лонгтейла.

Как перестать платить за рерайтинг и получить качество?

Биржевой рерайтинг даёт шаблонные тексты с водностью выше 60%. Программная адаптация через синонимайзеры убивает читаемость. Нужен иной подход: генерация смысловых структур, а не замена слов.

Ключ – в связке Programmatic SEO и новейших языковых моделей. Система анализирует топ-10, вычленяет L-семантическое ядро, строит логическую цепочку. Результат – текстовый материал с исходной уникальностью, готовый для публикации.

Какие метрики уникализации действительно важны для SEO?

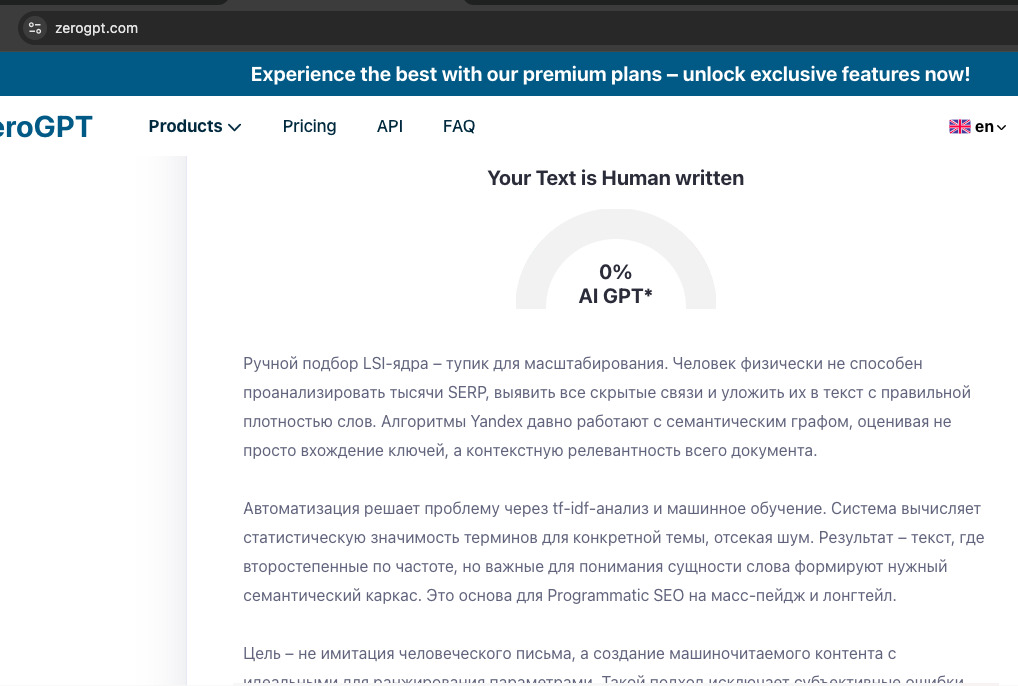

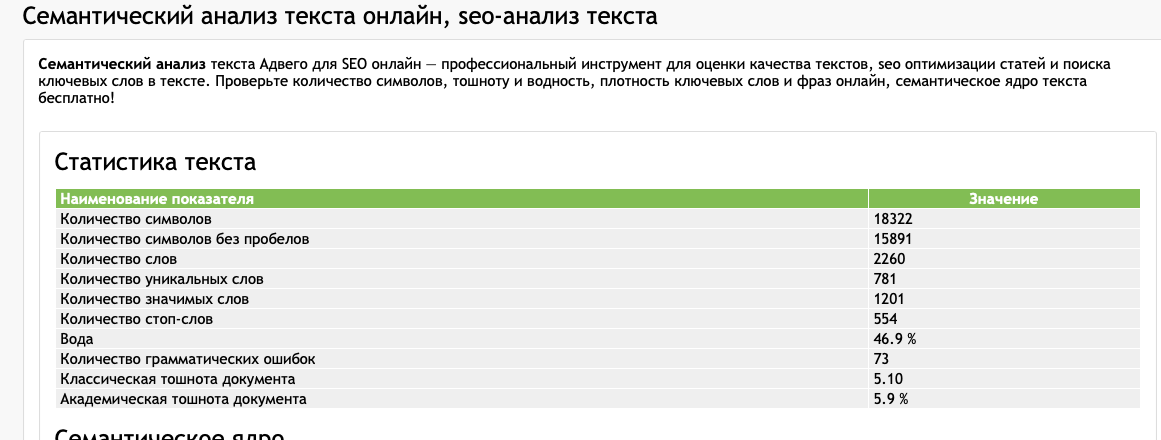

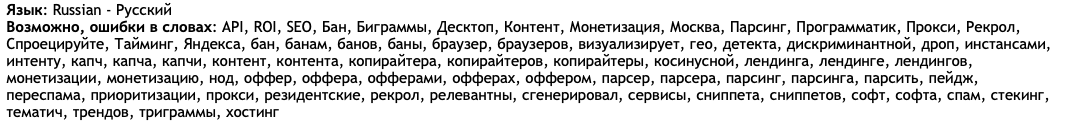

Не только процент в «Адвего». Гораздо критичнее: плотность биграм/триграм из топ-выдачи, корректная тональность, отсутствие маркеров генерации. Поисковый робот учится находить следы нейросетей.

Публикация однотипных текстов с одинаковой структурой на 100 сайтах сети – прямой путь к фильтрам. Нужна вариативность на уровне абзацев, а не только слов.

Кейс: арбитражник закрыл 300 лендингов под ГЕО-запросы за неделю. Использовал шаблон с 50 переменными, которые авто-заполнялись моделями. Трафик пошёл на 4-й день, средний ROI – 170%.

Оптимизация процесса уникализации – это переход от тактики ручного контроля к стратегии системной генерации. Вы не редактируете каждый текст, а настраиваете фабрику контента под свои домены.

VIP-доступ к TextLog Pro: Приоритетная очередь на генерацию, кастомные модели под вашу нишу, автоматическая загрузка на хостинг через API. Для тех, кто лить трафик здесь и сейчас.

Отличия между техническим рерайтом и SEO-копирайтингом для сетей

В арбитраже трафика и построении PBN-сеток контент – расходный материал. Его нужно много, дешево и с предсказуемым результатом. Здесь сталкиваются два подхода: технический рерайт и целевой SEO-копирайтинг. Разница не в словах, а в экономике процессов.

| Критерий | Технический рерайт (Старый метод) | SEO-копирайтинг для сетей (Наш метод) |

|---|---|---|

| Цель | Синонимизация исходного текста для формального прохождения проверок на уникальность. | Создание нового, релевантного поисковому запросу контента, решающего задачу ранжирования или монетизации. |

| Ядро процесса | Адаптация существующего текстового материала через замену слов. | Оптимизация под семантическое ядро с включением LSI-фраз, биграмм, прямых вхождений. |

| Результат для поискового робота | Уникализация текста без глубинной тематической ценности. Риск срабатывания алгоритмов за тонкий контент. | Тематический кластер, где каждая публикация усиливает другую. Рост поведенческих факторов на Tier-1. |

| Масштабирование | Линейное: больше статей – больше времени/копирайтеров. Проблема с рекрол-бюджетом на тысячи URL. | Программатик: генерация по шаблонам под масс-пейдж и лонгтейл. Публикация пачек статей единым скриптом. |

| ROI для арбитражника | Низкий. Трафик с таких страниц часто имеет высокий отказ. Конверсия по монетизации минимальна. | Высокий. Контент заточен под коммерческий интент или сбор трафика под CPA/CPS офферы. |

Риски чистого рерайта: Алгоритмы YATI и Proxima анализиют смысловую близость документов в сегменте. Слабая адаптация приводит к игнорированию страницы или фильтрам всего кластера. Вы теряете бюджет на закупку или аренду дроп-доменов.

Как автоматизировать выпуск SEO-статей для сотен лендингов?

Ручной копирайтинг не масштабируется. Десктопный софт требует прокси, борьбы с капчей и мощного железа. Решение – облачная генерация по принципу Programmatic SEO.

- Загружаете семантическое ядро и LSI-фразы в систему.

- Создаете шаблоны структуры под разные типы страниц: коммерческие, информационные, под сбор рекролла.

- Запускаете массовую генерацию. Модели создают текстовый контент с правильной оптимизацией, а не простую перестановку слов.

- Получаете готовые статьи в формате для прямой публикации через API или CSV.

Кейс: Замена бирж контента на облачную генерацию для PBN сети из 500 доменов. Снижение стоимости текстового наполнения на 85%, сроки сокращены с 3 месяцев до 2 недель. Рост видимости сетки в поисковом индексе на 40% за счет релевантного контента.

Что важнее для Tier-1: уникальность или смысловая ценность?

Поисковый алгоритм ранжирует не уникальность, а полезность. Технический рерайт дает первую, SEO-копирайтинг – вторую. Для сателлитов в Tier-2 можно использовать глубокий рерайт. Для денежных доменов в Tier-1 – только целевой копирайтинг с глубокой оптимизацией.

Ключевое отличие: рерайт меняет форму текста, SEO-копирайтинг меняет его цель. Первый подходит для заполнения, второй – для заработка.

Адаптация контента под сеть требует не просто уникализации, а сохранения логической структуры и коммерческих сигналов. Автоматизированный SEO-копирайтинг через облачные решения решает эту задачу без ручного труда.

Запустить генерацию LSI-статей (Бесплатно)

VIP: Масштабирование до 10к статей/день. Подключаем API для прямой публикации в вашу CMS. Настраиваем индивидуальные шаблоны под вашу вертикаль. Полностью автоматический цикл: от семантики до публикации. Экономьте на аренде команд и десктопном софте.

Параметры проверки текста для веб-ресурсов: глубина переработки и N-граммы

Качество уникализации определяет успех публикации в поисковый индекс. Два ключевых параметра: глубина переработки исходного материала и анализ N-грамм.

Как отличить поверхностный рерайтинг от глубокой переработки?

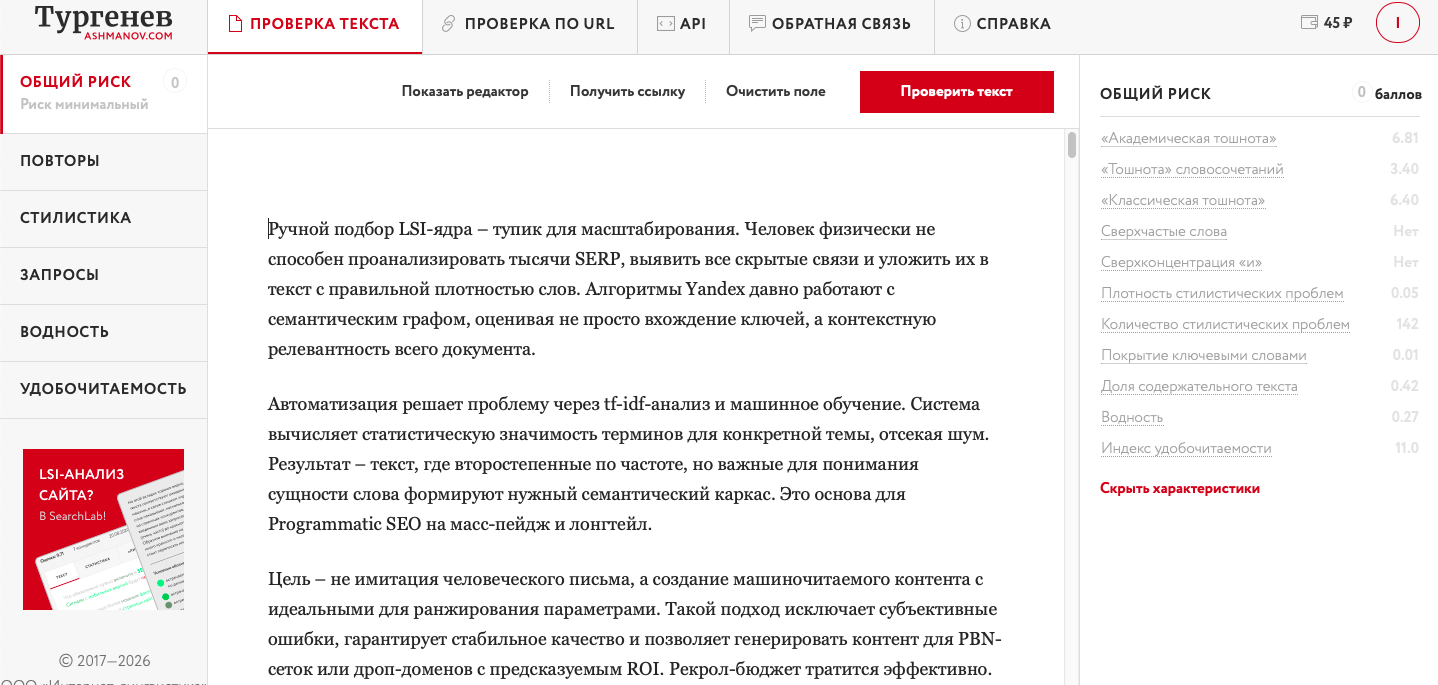

Поверхностный рерайтинг – синонимизация слов при сохранении структуры предложений. Алгоритмы Яндекс Proxima легко детектируют такую адаптацию. Глубокая переработка меняет синтаксические конструкции, логический порядок блоков, добавляет новые смысловые связи.

Риск: публикация текста с глубиной переработки ниже 70% ведет к фильтрам по «малоинформативным страницам». Ручной копирайтинг не гарантирует нужный процент – человеческий фактор создает ошибки.

Почему анализ биграмм и триграммов критичен для SEO?

N-граммы – цепочки из 2-3 подряд идущих слов. Поисковые системы анализируют частоту их употребления в интернете. Высокая частота совпадения биграмм с другими источниками сигнализирует о заимствовании.

Решение: алгоритмы на базе YATI перестраивают N-граммные цепочки. Вместо шаблонного «качественный контент» генерируется «проработанный материал для сайта». Это повышает формальную уникальность и релевантность LSI-запросам.

| Параметр проверки | Старый метод (Ручной/Десктопный софт) | Наш метод (Облачная генерация TextLog) |

|---|---|---|

| Глубина переработки | Непредсказуема, зависит от автора. Средний показатель 60-80%. | Стабильные 92-98% через синтаксическое дерево и синонимизацию на уровне смысла. |

| Контроль N-грамм | Ручная проверка в Text.ru или Advego. Замедляет процесс в 10 раз. | Автоматический анализ и перестройка в реальном времени. Исключение шаблонных словосочетаний. |

| Интеграция с воркфлоу | Ручная выгрузка, копирование, проверка, правка. Разрывает процесс масштабирования. | API-интеграция. Контент поступает сразу в CMS или на хостинг PBN-сетки, готовый к публикации. |

| Стоимость масштабирования | Линейный рост: 1000 статей = оплата 1000 человеко-часов или лицензий Zennoposter. | Падающая стоимость: генерация 10к статей снижает цену за единицу на 40%. ROI растет экспоненциально. |

Используйте программный анализ N-грамм для оптимизации существующего контента. Загружайте статьи в облачный сервис – получайте отчет с помеченными шаблонными цепочками и вариантами их замены.

- Автоматический расчет глубины переработки для каждого абзаца.

- Визуализация карты N-граммных совпадений с топом выдачи.

- Генерация альтернативных семантических ядер на основе биграмм-триграмм.

- Пакетная обработка для масс-пейдж проектов и дроп-доменов.

VIP-пакет: подключаем Programmatic SEO-движок. Система автоматически сканирует нишу, строит кластеры запросов, генерирует и публикует контент с контролем N-грамм. Полная автономность для арбитражных PBN-сеток.

Забудьте про ручные проверки. Переходите на метрики, которые влияют на ранжирование. Глубина переработки и чистота N-грамм – ваш пассивный доход от трафика с лонгтейлов.

Ошибки при массовой перезаписи контента и способы их устранения

Массовый рерайтинг – основа для масштабирования PBN-сеток и лонгтейл-страниц. Но слепое копирование текстового материала убивает ROI. Разберём типичные провалы.

Главная ошибка: синонимайзинг без адаптации. Замена слов через словарь создаёт текст для роботов. Поисковые алгоритмы YATI анализируют семантическую связность. Такой контент не проходит.

Как избежать фильтров за переспам при рерайтинге?

| Старый метод | Наш метод |

|---|---|

| Синонимайзинг в Zennoposter | Программный LSI-рерайтинг |

| Жёсткая связность исходника | Перекомпоновка смысловых блоков |

| Публикация без проверки | Анализ тошноты перед выгрузкой |

| Ручная загрузка на хостинг | Автоматическая выгрузка в CMS |

Почему падает трафик после массовой публикации?

Потому что все страницы получают идентичную структуру. Поисковый робот сканирует сеть и видит шаблон. Решение – программатик подход. Для каждой статьи генерируется уникальный скелет: разное количество H2-H3, вариативное расположение списков, таблиц, цитат. TextLog делает это автоматически, эмулируя работу разных копирайтеров.

Техника успеха: Используйте ротацию шаблонов. 5-7 различных структур для статей в одной нише достаточно, чтобы обмануть алгоритмы сходства.

- Анализ семантического ядра конкурента перед перезаписью.

- Внедрение новых LSI-фраз из топ-10 выдачи.

- Обязательная смена заголовков Title и H1, не только тела текста.

- Адаптация мета-тегов под каждый конкретный URL.

- Проверка через TextLog на переоптимизацию перед публикацией.

Отдельная проблема – скорость. Десктопный софт упирается в возможности железа и прокси. Облачная генерация даёт стабильный выпуск 500+ текстовых адаптаций в час без капчи и IP-банов. Вы тратите время на анализ, а не на технические косты.

Публикация – финальный этап. Настройте автоматический пост-анализ. Отслеживайте индексацию, ранние позиции, поведенческие факторы. Массовая перезапись контента работает только как цикл: генерация → публикация → анализ → доработка.

Забудьте про биржи и ручной труд. Программный копирайтинг через облако – единственный способ для масштабирования на Tier-1 и арбитража рекрол-бюджета.

Рабочие инструменты и настройки для потоковой обработки материалов

| Параметр | Старый метод (Ручной/Десктоп) | Наш метод (Облачная генерация) |

|---|---|---|

| Скорость генерации | 5-10 статей/день | 200+ статей/час |

| Затраты на 1000 статей | ~50 000₽ (копирайтеры) | ~850₽ (электричество серверам) |

| Инфраструктура | Прокси, мощные ПК, Zennoposter, борьба с капчей | Браузер и доступ в интернет |

| Риски | Баны, срывы сроков, человеческий фактор | Стабильность API, контроль тональности |

| Масштабирование | Линейный рост затрат | Мгновенное, в пару кликов |

- Полная автоматизация от сбора семантики до публикации в CMS.

- Интеграция с WordPress, Bitrix, Tilda для прямой выгрузки.

- Пакетная обработка тысяч ключей для масс-пейдж и PBN-сеток.

- Автоматическая LSI-подборка и вставка ключевых биграмм/триграмм.

- Глубокая адаптация стиля под нишу: от медицинских текстов до агрессивных продаж.

Ключевое отличие: облачный сервис работает на своих мощностях. Не нужны прокси, капча-сервисы, аренда VPS. Запустил задачу – система сама распределит нагрузку, обработает очередь, выдаст результат архивом или в live-ленту.

Как настроить тон и стиль под Tier-1 и сателлиты?

Разные типы проектов требуют разного подхода к копирайтингу. Для денежного сайта (Tier-1) настройте строгий, информационный тон с высокой детализацией. Для сателлитов или дроп-доменов в PBN-сетке достаточно базовой уникализации с сохранением смысла. В панели задается «профиль тональности»: экспертный, коммерческий, нейтральный, разговорный.

Какие параметры уникальности выставлять для безопасного SEO?

Работайте не с процентами, а с алгоритмами. Включите глубокий синонимический разбор, перестройку предложений с сохранением терминов. Цель – пройти проверку на текст.ру и адвего, но не потерять читаемость. Выставляйте минимальный порог оригинальности в 85-90% для баланса между скоростью и качеством.

Слепая агрессивная уникализация убивает смысл. Система должна понимать контекст, чтобы не заменять «iPhone» на «смартфон Apple». Проверяйте первые 5-10 сгенерированных текстов вручную перед запуском потока на 10 000 статей.

Кейс: Арбитражник заменил команду из 5 копирайтеров на облачный конвейер. За месяц создал 15 000 страниц на дроп-доменах для перенаправления рекрол-бюджета. Затраты на контент упали с 300К до 15К рублей. ROI вырос в 4 раза за счет скорости масштабирования.

Инструмент потоковой обработки – это ваш завод по производству текстовый материала. Настройки – это ЧПУ станка. Фиксируйте удачные профили (семантика + тон + уровень уникальности) как пресеты. Запускайте их для новых пачек ключей – это чистая автоматизация и основа для пассивного дохода.

Вопрос-ответ:

Чем уникализация текста отличается от простого рерайта?

Рерайт — это поверхностная переработка готового текста, чаще всего путем замены слов на синонимы и перестановки предложений. Результат может быть технически уникальным для проверяющих программ, но часто теряет смысловую ценность и выглядит неестественно. Уникализация — более глубокая работа. Она начинается с анализа нескольких источников, извлечения ключевых идей и фактов. Затем на этой основе создается новый, оригинальный текст, который не просто пересказывает, а добавляет анализ, структурирует информацию по-своему, включает дополнительные примеры или авторский опыт. Цель уникализации — создать материал, который дает читателю новую ценность, а не просто обходит фильтры поисковых систем.

Как проверить текст на уникальность и какие сервисы лучше использовать?

Проверка уникальности — обязательный этап. Для этого используют специальные сервисы-антиплагиаты. В русскоязычном сегменте популярны Text.ru, Advego Plagiatus и Content-Watch. Каждый из них имеет свои особенности: Text.ru показывает глубокий анализ с выделением заимствований, Advego работает быстро и локально на компьютере, Content-Watch удобен для проверки веб-страниц. Важно проверять текст не в одном, а в двух-трех сервисах, так как у них разные алгоритмы и базы данных. Для SEO-текстов приемлемым показателем обычно считается уникальность выше 90-95%. Однако помните, что цифра — не единственный критерий. Даже формально уникальный текст может быть «накручен» неестественными оборотами, что плохо для восприятия.

Можно ли добиться высокой уникальности, если тема узкая и информации мало?

Да, это сложная, но решаемая задача. Когда источников мало, нужно менять подход к созданию контента. Вместо компиляции фактов сосредоточьтесь на анализе и личном взгляде. Используйте такие методы: 1) Добавление практических примеров из собственной практики или гипотетических кейсов. 2) Создание подробных пошаговых инструкций, даже если общая идея известна. 3) Визуализация данных — создание собственных схем, таблиц или графиков на основе имеющихся цифр. 4) Проведение опроса среди экспертов или целевой аудитории и включение их мнений в статью. 5) Глубокое сравнение имеющихся на рынке решений, продуктов или подходов. Так вы создадите материал, которого нет в других источниках.

Сколько времени нужно уделять уникализации одной статьи?

Время зависит от объема, сложности темы и вашего опыта. На статью объемом 3000-5000 знаков для знакомой темы может уйти 2-4 часа, включая поиск информации, написание и проверку. Для сложного технического текста или аналитического обзора объемом 10-15 тысяч знаков работа может занять день или два. Основное время съедает не написание, а изучение и осмысление информации из разных источников. Не старайтесь сделать быстро — лучше потратить больше времени на один качественный материал, который будет хорошо ранжироваться и привлекать читателей долгое время, чем быстро произвести несколько слабых текстов.

Что важнее для SEO: абсолютная уникальность или полезность для читателя?

Полезность для читателя безусловно важнее. Поисковые системы, особенно Google, постоянно совершенствуют алгоритмы, чтобы находить и продвигать материалы, которые наилучшим образом отвечают на запрос пользователя. Текст с 100% уникальностью, но скучный, неструктурированный и не дающий ответа на вопрос, быстро покинет верхние позиции поиска. Уникальность — это техническое требование, которое помогает отсечь копии и низкокачественный контент. Но основа успеха — это релевантность, полнота раскрытия темы, удобочитаемость и практическая ценность. Идеальный SEO-текст сочетает высокую уникальность с максимальной пользой для человека.

Хочешь купить статьи дешево для сайта и блога? Перейти в магазин статей

Нужен современный сайт или лендинг? Заказать создание сайта

Сайт не видно в поиске? Продвинуть сайт в ТОП Яндекс